1.超级详细的语法教程

参考:https://plantuml.com/zh/class-diagram

2.修改线条/箭头颜色

箭头中间添加颜色即可

@startuml

Bob -[#red]> Alice : hello

Alice -[#0000FF]->Bob : ok

@enduml

3.输出多行日志

note left

输出日志

1.startAnimation(): Notify animation start:

2.Starting remote animation

3.container:(…) Target:

end note

4.修改字体颜色和线条

例如:A -> B : color:#blue字体颜色

<b>内容:加粗文本

<u> 或 <u:#AAAAAA> 或 <u:colorName> 用来加下划线

<i> 斜体

<s> 或 <s:#AAAAAA> 或 <s:colorName> 用来加删除线

<w> 或 <w:#AAAAAA> 或 <w:colorName> 用来加波浪线

<color:#AAAAAA> 或 <color:colorName> 用来设置文本颜色

<back:#AAAAAA> 或 <back:colorName> 用来设置背景色

<size:nn> 设置字体大小

5.添加图片

<img src="file"> 或 <img:file> 用来添加图片,图片文件必须 是可以访问得到才行。

<img src="http://url"> 或 <img:http://url> 用来添加一个互 联网图片,同样的图片地址必须是可用的才行。

6.定义可访问性

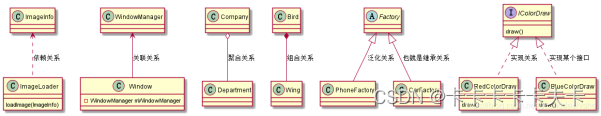

7.类图关系

参考:UML类图中六大关系理解 以及 PlantUML类图表示

https://sykent.github.io/2019/01/12/2019/plantuml/class-plantuml/

依赖关系:A类的某个方法里通过传参用到了B类。 B<…A

关联关系:A类里面作为属性引用了另一个B类。 B<–A

聚合关系:表示整体和部分,一个类属性使用列表保存很多个另一个类对象。 Bo–A

组合关系:相比聚合更加紧密的关系,生死与共,互相引用不能单独存在。 B*–A

泛化/继承关系:用来表示类之间的继承关系,A继承于B。 B<|-- A

实现关系:用来表示一个类实现另一个类的接口,A implements B。 B<|… A

内部类:表示B是A的一个内部类。A ±- B

994

994

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?