训练模型时,在众多训练好的模型中会有几个较好的模型,我们希望储存这些模型对应的参数值,避免后续难以训练出更好的结果,同时也方便我们复现这些模型,用于之后的研究。PyTorch提供了模型的保存与重载模块,包括torch.save()和torch.load(),以及pytorchtools中的EarlyStopping,这个模块就是用来解决上述的模型保存与重载问题

一、保存与重载模块

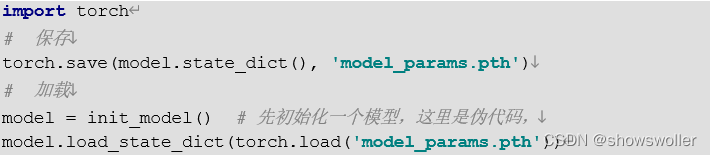

若希望保存/加载模型model的参数,而不保存/加载模型的结构,可以通过如下代码

其中state_dict是torch中的一个字典对象,将每一层与该层的对应参数张量建立映射关系

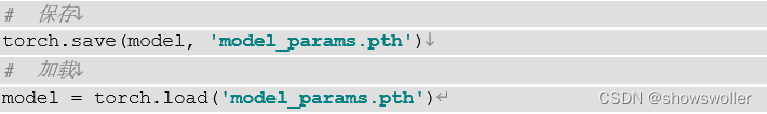

若希望同时保存/加载模型model的参数以及模型结构,而不保存/加载模型的结构,可以通过如下代码

为了获取性能良好的神经网络,训练网络的过程中需要进行许多对于模型各部分的设置,也就是超参数的调整。超参数之一就是训练周期(epoch),训练周期如果取值过小可能会导致欠拟合,取值过大可能会导致过拟合。为了避免训练周期设置不合适影响模型效果,EarlyStopping应运而生。EarlyStopping解决epoch需要手动设定的问题,也可以认为是一种避免网络发生过拟合的正则化方法

EarlyStopping的原理可

文章介绍了在PyTorch中如何使用torch.save()和torch.load()保存和加载模型参数,以及如何利用EarlyStopping来优化训练过程,防止过拟合。此外,还讨论了Tensorboard在模型训练过程中的可视化作用,包括损失函数、网络结构和数据流图的展示,帮助开发者监控和理解模型的训练状态。

文章介绍了在PyTorch中如何使用torch.save()和torch.load()保存和加载模型参数,以及如何利用EarlyStopping来优化训练过程,防止过拟合。此外,还讨论了Tensorboard在模型训练过程中的可视化作用,包括损失函数、网络结构和数据流图的展示,帮助开发者监控和理解模型的训练状态。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?