ELK日志分析系统

- Elasticsearch

- Logstash

- Kibana

日志处理步骤

- 将日志进行集中化管理

- 将日志格式化(Logstash)并输出到Elasticsearch

- Elasticsearch对格式化的数据进行索引与存储

- 在web界面进行展示Kibana

Elasticsearch的概述

提供了一个分布式多用户能力的全文搜索引擎

核心概念

- 接近实时

- 集群

- 节点

- 索引

- 索引-类型-文档

- 分片和副本

Logstash介绍

- 一款强大的数据处理工具

- 可实现数据传输,格式处理,格式化输出

- 数据输入,数据加工(如过滤,改写)以及数据输出

Logstash组件

- Shipper:日志收集者。负责监控本地日志文件的变化,及时收集最新的日志文件内容。

- 通常远程代理端(agent)只需要运行这个组件即可。

- Indexer:日志存储者。负责接收日志并写入到本地文件。

- Broker:日志 Hub。负责连接多个Shipper 和多个 Indexer。

- Search and Storage:允许对事件进行搜索和存储。

- Web Interface:基于 Web 的展示界面。

Kibana介绍

- 一个针对Elasticsearch的开源分析及可视化平台

- 搜索,查看存储在Elasticsearch索引中的数据

- 通过各种图标进行高级数据分析及展示

Kibana主要功能

- Elasticsearch无缝之集成

- 整合数据,负载数据分析

- 让更多团队成员受益

- 接口灵活,分享更容易

- 配置简单,可视化多数据源

- 简单数据导出

部署ELK日志分析系统

资源列表

|

操作系统 |

IP |

主机名 |

|

Centos7 |

192.168.10.51 |

node1 |

|

Centos7 |

192.168.10.52 |

node2 |

|

Centos7 |

192.168.10.53 |

apache |

时间同步

chronyc sources -v

- 关闭防火墙

systemctl stop firewalld

systemctl disable firewalld

- 关闭内核安全机制

setenforce 0

sed -i "s/^SELINUX=.*/SELINUX=disabled/g" /etc/selinux/config

添加hosts解析

cat >> /etc/hosts << EOF

192.168.10.51 node1

192.168.10.52 node2

192.168.10.53 apache

EOF

部署Elasticsearch(在node1和node2节点)

#下载地址

https://www.elastic.co/downloads/past-releases#elasticsearch

#上传elasticsearch-5.5.0.rpm软件包

安装java环境

yum -y install java-1.8.0-openjdk

rpm -ivh elasticsearch-5.5.0.rpm

在node1节点修改配置文件

vim /etc/elasticsearch/elasticsearch.yml

----------17行-------------

cluster.name: my-application #去掉井号,集群名字

----------23行-------------

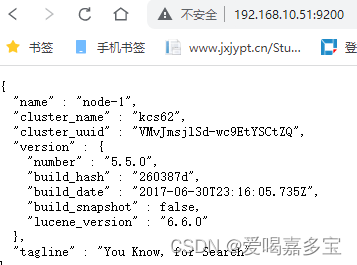

node.name: node-1 #去掉井号,集群姓名

----------33行-------------

path.data: /data/elk_data #去掉井号,数据存储路径

----------37行-------------

path.logs: /var/log/elasticsearch #去掉井号,日志存储路径

----------43行-------------

bootstrap.memory_lock: false #去掉井号,并修改为false,不锁定内存,用多少给多少

----------55行-------------

network.host: 0.0.0.0 #去掉井号,服务监听网络的接口地址

----------59行-------------

http.port: 9200 #去掉井号,监听端口

----------68行-------------

discovery.zen.ping.unicast.hosts: ["node1", "node2"] #去掉井号,用于发现其他节点

创建数据存储目录(在node1,node2上操作)

mkdir -p /data/elk_data

chown elasticsearch:elasticsearch -R /data/

#开启elasticsearch服务

systemctl start elasticsearch.service

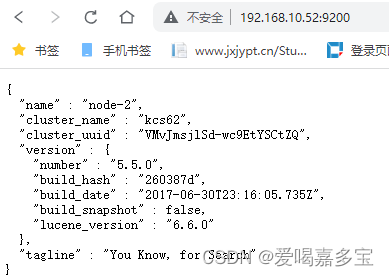

可以访问node1和node2的IP加9200端口进行访问

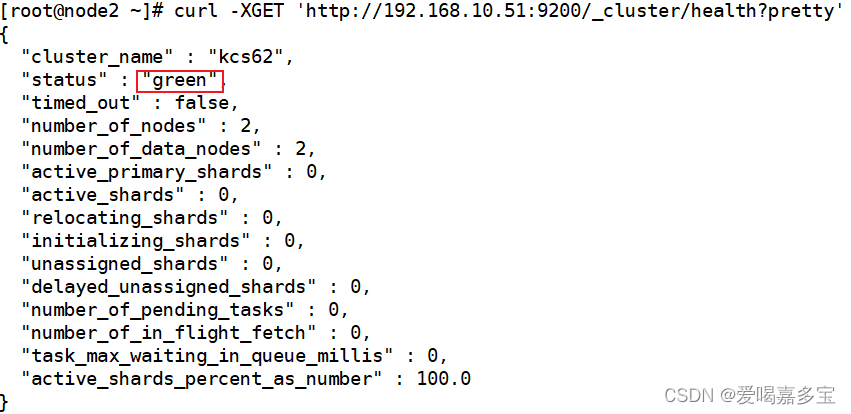

查看集群的的状态

curl -XGET 'http://192.168.10.51:9200/_cluster/health?pretty'

部署logstash(在apache节点)

#上传logstash-5.5.1.rpm软件包

yum -y install java-1.8.0-openjdk

rpm -ivh logstash-5.5.1.rpm

systemctl start logstash

ln -s /usr/share/logstash/bin/logstash /usr/local/bin/

采集系统索引

vim /etc/logstash/conf.d/system.conf

input {

file{

path =>"/var/log/messages"

type =>"system"

start_position =>"beginning"

}

}

output {

elasticsearch {

hosts => ["192.168.10.51:9200"]

index =>"system-%{+YYYY.MM.dd}"

}

}

chmod +r /var/log/messages

systemctl restart logstash

查询索引

[root@apache ~]# curl 192.168.10.51:9200/_cat/indices

green open system-2024.05.23 J7iK8_oIREe389Cum4ye4A 5 1 7000 0 5.2mb 2.6mb

"green":表示该索引的状态是打开的。

"open":表示该索引的状态是打开的。

"logstash-2023.10.07":这是索引的名称。

"JyiDRPHkSWetazfcr9Vusg":这是索引的UUID,用于唯一标识一个索引。

"5":这是该索引的副本数量。

"1":这是该索引的主分片数量。

"1":这是该索引的副本分片数量。

"0":这是该索引的优化分片数量。

"9.7kb":这是该索引的大小。

"4.8kb":这是该索引的压缩大小。

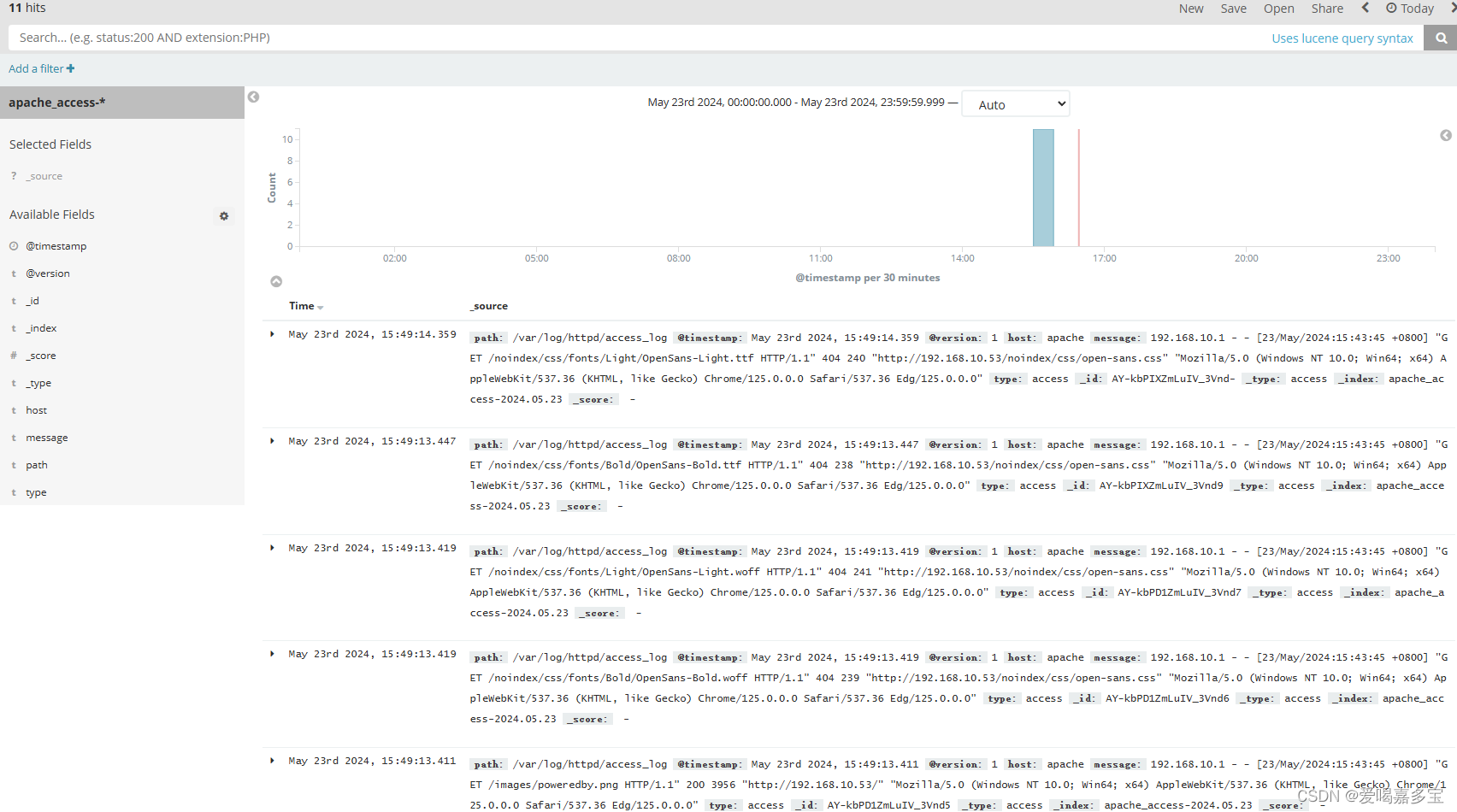

采集apache索引

yum -y install httpd

systemctl start httpd

编写配置文件

vi /etc/logstash/conf.d/apache_log.conf

input {

file{

path =>"/var/log/httpd/access_log"

type =>"access"

start_position =>"beginning"

}

file {

path =>"/var/log/httpd/error_log"

type =>"error"

start_position =>"beginning"

}

}

output {

if [type] == "access" {

elasticsearch {

hosts => ["192.168.10.51:9200"]

index =>"apache_access-%{+YYYY.MM.dd}"

}

}

if [type] == "error" {

elasticsearch {

hosts => ["192.168.10.51:9200"]

index =>"apache_error-%{+YYYY.MM.dd}"

}

}

}

chmod -R 777 /var/log/httpd

systemctl restart logstash

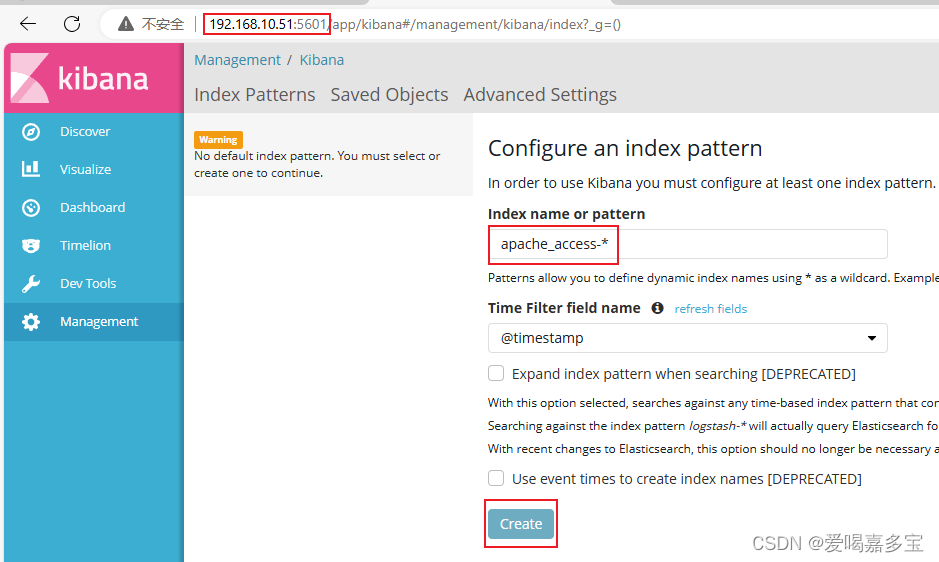

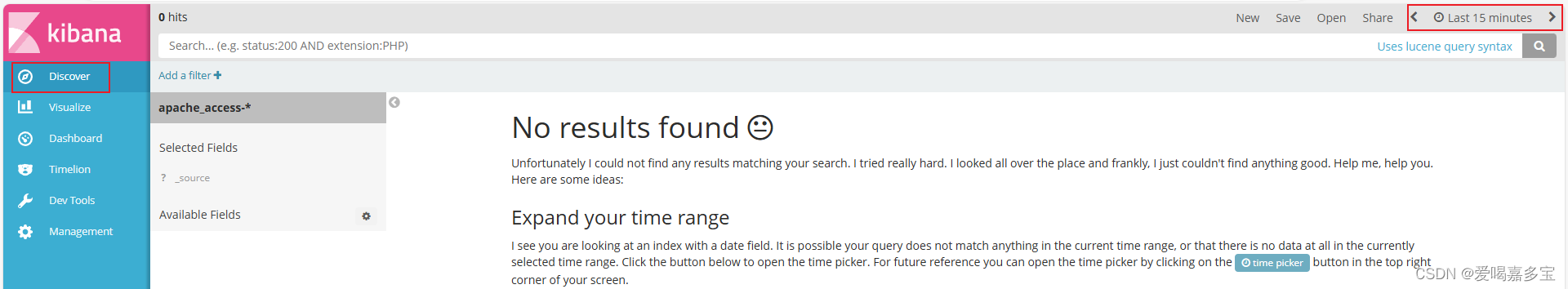

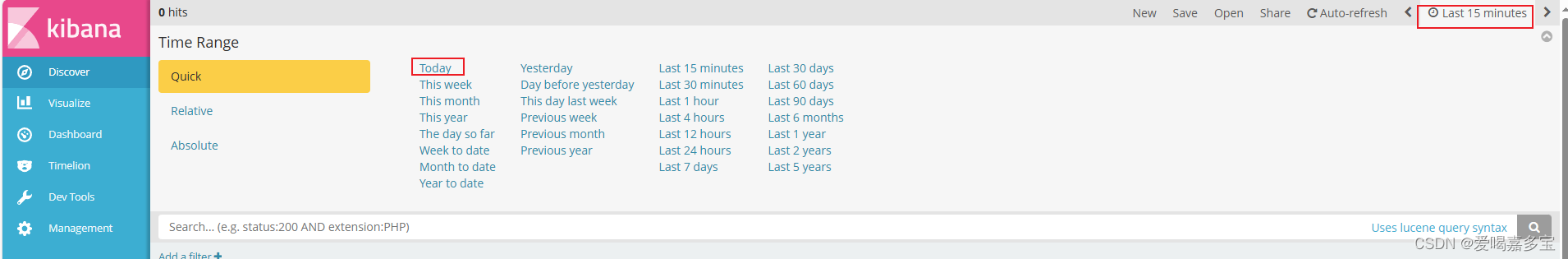

在node1节点部署kibana

#上传kibana-5.5.1-x86_64.rpm

rpm -ivh kibana-5.5.1-x86_64.rpm

systemctl enable kibana.service

编辑配置文件

vim /etc/kibana/kibana.yml

-------------2行-------------

server.port: 5601 #去掉井号

-------------7行-------------

server.host: "0.0.0.0" #去掉井号,并修改为0.0.0.0

-------------21行-------------

elasticsearch.url: "http://192.168.10.51:9200" #去掉井号并修改IP

-------------30行-------------

kibana.index: ".kibana" #去掉井号

systemctl start kibana.service

在浏览器访问

1506

1506

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?