生成checkpoint数据

设置checkpoint目录

需要缓存的rdd调用checkpoint方法

sc.setCheckpointDir("/data/checkpoint")

rdd.checkpoint()加载checkpoint数据

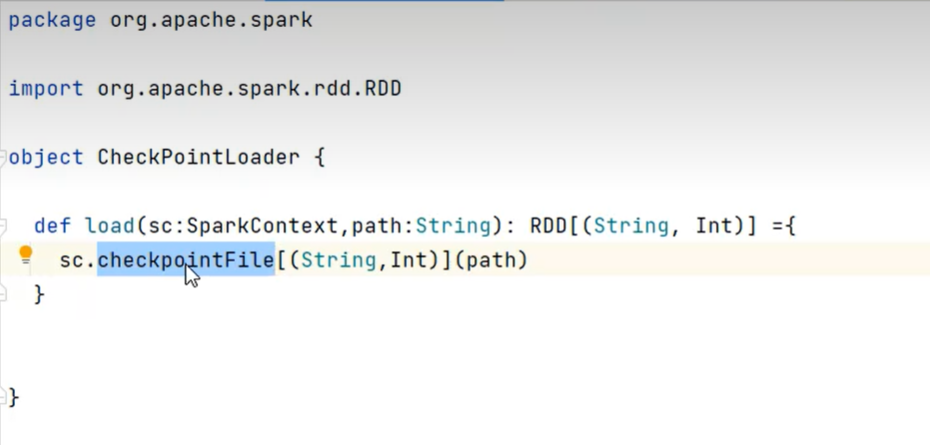

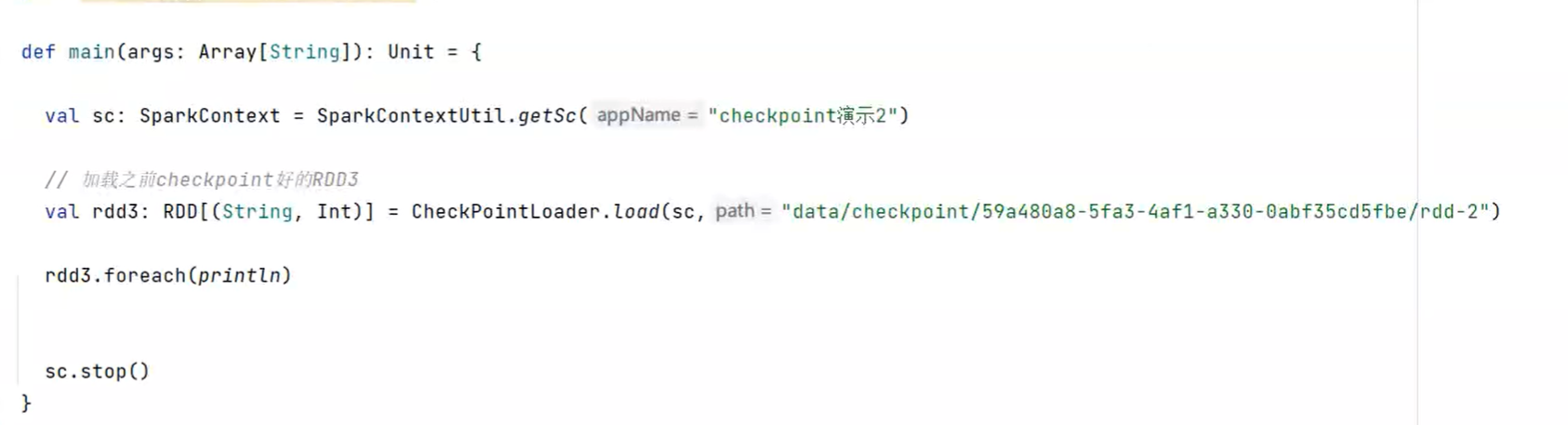

sparkContext通过checkpointFile方法指定ck目录,实现加载上次的数据,但是不对外开放。

sparkContext中checkpointFile方法是私有的,我们可以在org.apache.spark包下创建一个一个类,调用checkpointFile方法即可

文章介绍了如何在Spark中使用checkpoint功能来持久化和加载RDD数据。首先,设置checkpoint目录,如`sc.setCheckpointDir(/data/checkpoint)`,然后调用rdd.checkpoint()方法来标记需要缓存的RDD。虽然`sparkContext.checkpointFile()`用于加载checkpoint数据,但该方法是私有的。为了访问,建议在org.apache.spark包下创建自定义类来调用这个方法。

文章介绍了如何在Spark中使用checkpoint功能来持久化和加载RDD数据。首先,设置checkpoint目录,如`sc.setCheckpointDir(/data/checkpoint)`,然后调用rdd.checkpoint()方法来标记需要缓存的RDD。虽然`sparkContext.checkpointFile()`用于加载checkpoint数据,但该方法是私有的。为了访问,建议在org.apache.spark包下创建自定义类来调用这个方法。

494

494

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?