随着chatgpt爆火之后,越来越多的人开始关注人工智能,人工智能相关的其他应用如AI绘画,也再次得到人们的关注。AI绘画的确很上头,最近几天小编也研究一下,这里把研究的过程以及中间遇到的问题整理一下,我这里遇到的问题,相信新入门的小白也会遇到,希望本文对你能有一定的帮助。

目前常用的AI绘画工具主要有两种:stablediffusion 和 midjourney 。 两者都是根据使用者输入绘画描述,进行图片生成,背后都是采用机器学习算法工作,对于两者的具体技术实现细节,这里不错过多描述,毕竟这方面小编也不擅长,哈哈哈。

从绘图效果来看,两者差别不大,对于日常绘图需求,两者都可以完全满足,这里我主要站在使用者的角度来对比一下两者的差异:

midjourney:是一个国外的商业化产品,操作简单,使用方便,出图效果完全取决于提示词。

使用门槛:

1.需要科学上网

2.需要付费,费用还挺高

这里是 midjourney的官网:https://www.midjourney.com/app/

stable diffusion 是一个免费的开源工具包,可以在本地安装,直接使用本地计算资源就可以进行绘画创作,同时stable

diffusion提供了很多可以扩展的插件,可以根据场景需要,进行自定义功能扩展。

使用门槛:

对电脑配置有一定的要求,当然配置低的电脑可以可以玩,只不过出图效率比较低而已。

小编的电脑配置:

Mac os 12.5 M1

内存:16GB

CPU和GPU都是苹果芯片

输出512*512的图片大概15s左右。

前期为了学习和研究,满足一下自己的好奇心,这些都不是最重要。最重要的是先搞出一张图,把整个流程跑通。

作为一个程序员,小编比较喜欢自己折腾一些东西,这里我使用 本地安装stable diffusion的方式。

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)stable

diffusion安装

stable diffusion的安装直接参考官网提供的安装指南即可:https://github.com/AUTOMATIC1111/stable-

diffusion-webui/wiki

这里有各种芯片组使用的安装方式,我的电脑是 apple芯片,安装方式使用的是:

https://github.com/AUTOMATIC1111/stable-diffusion-webui/wiki/Installation-on-

Apple-Silicon

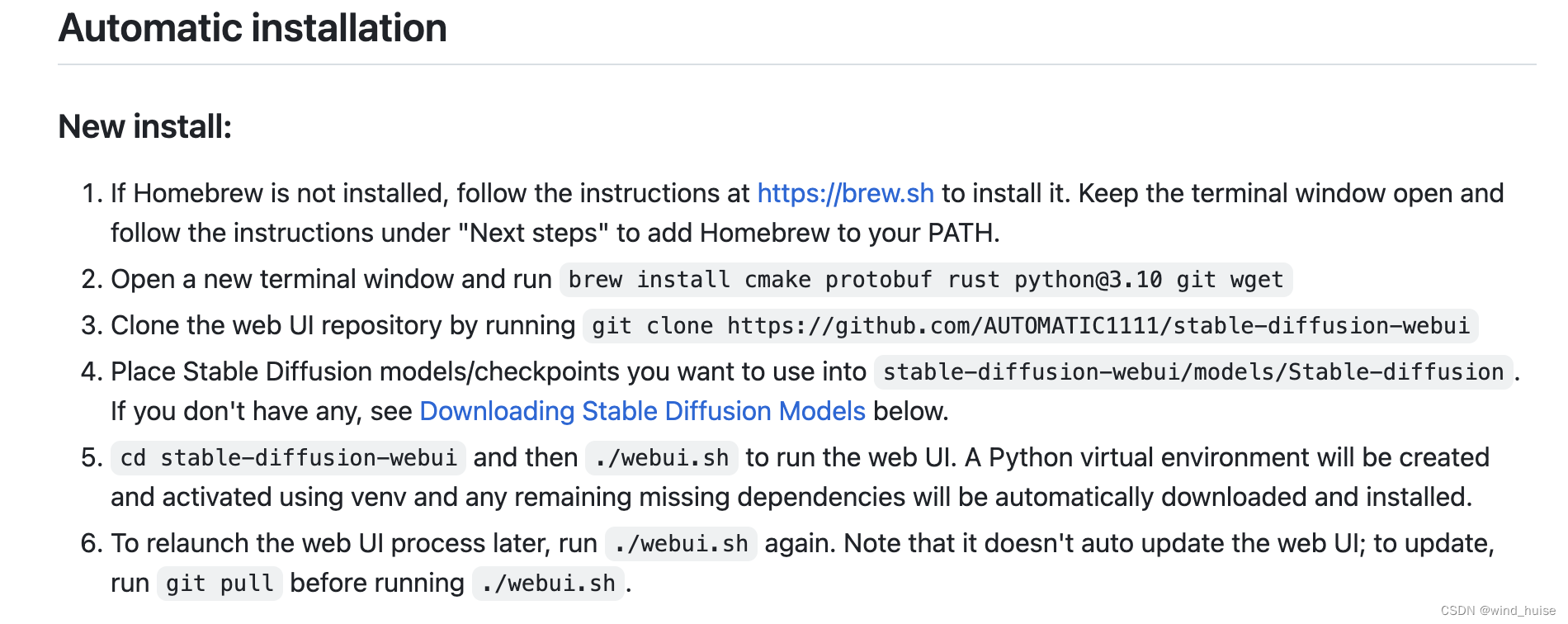

安装过程主要分为如下5步,如下图:

注意:这里使用了Home Brew完成对需要依赖的安装,Home

brew的安装需要科学上网,如果没有条件的话,也可以使用国内镜像安装,操作方式可以参考:https://zhuanlan.zhihu.com/p/111014448/

按照上述步骤,经过10-20分钟后,可以完成安装。

安装完成后,在 stable-diffusion-webui 目录下执行./web-

ui.sh,第一次执行会比较慢,会下载一些基础模型和依赖,大概等待5-10分钟后,在控制台会看到如下图输出,说明启动成功。

此时在浏览器访问地址:http://localhost:7860 即可。

此时你会看到如下图所示的页面:

可能有的老铁看到的页面和上图有些差异:

1.你的主题是黑色的,我的怎么是白的?

2.你的是汉化的,我的怎么全是英文?

是的,我的页面是经过调整配置的,具体怎么配置,我后面会详细说明。

在上图中,一种有7个重点区域

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)1.模型选择区

模型对于画图至关重要,它直接决定了你要出图的风格,对于初学者直接使用其他人提供的模型就行,模型的下载后面会详细说。

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)2.功能区

stable diffusion支持多种绘图能力:

文生图 :根据提示词描述完成图片生成

图生图 :使用提供的图片作为参考,完成新图片的生成

高清化 :将已有图片进行高清化处理

图片信息 :如果一个图片是stable diffusion生成的,那么使用图片信息功能,可以输出生成这张图片使用的模型、提示词等信息

模型合并 :是一种高阶使用方式,可以将多个模型合并生成一个全新的模型

训练 :使用者可以根据自己的一些图片数据进行训练,生成一个全新的模型

setting :是对stable diffusion进行配置的控制面板,具体控制项,读者可以自行查看

扩展 :可以实现对stable diffusion进行插件功能扩展,来实现对stable diffusion进行功能增强,扩展功能下面会进行具体演示

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)3.正向提示词

正向提示词是你与模型对话的输出框,告诉模型你想要什么,告诉模型你要绘画的内容,如人物特征,形象,背景,图片质量等。

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)4.反向提示词

和正向提示词作用相反,就是告诉模型,你不想要什么,通常模型在输出的图形的上会有一些瑕疵,如怪异的手指,眼睛等一些细节,你可以在这里输入这些你不想要的内容。

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)5.图片输出参数区

这些参数主要是控制输出图片的一些控制参数。

宽度、高度:这两个参数直接控制输出图片的尺寸大小,当如输出图片尺寸越大,生成图片耗时越长

采样步数(Sampling

steps):决定了模型输出图片迭代的次数,迭代次数越多,耗时越长,但是效果却不是越好的,这个迭代次数,通常20-30直接,当然也取决于具体的模型,可以在生成图片的时候,可根据具体情况调整

生成次数和每次数量:决定了一次生成任务可以生成多个张图片,生成图片越多,耗时也就越长

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)6.图片生成

点击生成按钮,模型就开始根据你设置的参数来执行图片生成了动作了,可以根据进度条查看图片生成的进度。

可能有的老铁,经过前面几步的参数配置后,点击图片生成按钮,并没有生成图片,反而命令控制台有报错输出

如下图:

报错关键信息:

RuntimeError: "upsample_nearest2d_channels_last" not implemented for 'Half

* 1

* 2

报错的原因是现有的芯片组不支持Half参数,对于这个问题,可以在启动命令添加如下参数:./webui.sh --no-half 进行重新启动就可。

等待大概15s左右,就会在图片展示区看到你的第一张AI绘画了。

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)模型下载

上面介绍模型选择区的时候说过,模型对于stable

diffusion来说至关重要,他决定了绘画的风格,比如你想要画一副二次元风格的图片,那么就尽量选择一个二次元画风的模型,模型的选择要比你输入多少提示词都要好使。

对于新手小白来说,可以使用别人训练好的模型直接使用,模型的选择和下载可以到下面这个两个网站:

https://huggingface.co/models

https://civitai.com/ (C站)

模型主要分为两种:大模型(checkpoint)和微调模型(lora)。

checkpoint大模型

下面我以C站为例演示一下如何下载模型。

1.进入C站后,可以浏览自己需要的大模型,也可以有目标的搜索自己需要的模型

2.选中自己需要的模型,点击下载按钮,就会进行模型的下载,通常大模型会比较大

3.点击演示图片右下方的 “i”,可以查看演示图片的配置信息:正方向提示词,使用的模型等,使用演示图片的配置信息进行模型的验证。

4.模型下载完毕后,需要将模型文件放到/stable diffusion/stable-diffusion-webui/models/Stable- diffusion目录下,重启 stable diffusion,在模型选择区就可以看到自己需要的模型了。

在stabel

diffusion的模型中,还有一种对生成图片画风影响比较大的模型,它就是Lora,虽然他是一种微调模型,但是对于生成图片的影响也比较明显,会影响生成图片的一些细节和图片的背景。

Lora模型的下载和checkpoint大模型下载方式是一样,也可以在C站中下载,Lora模型通常会比较小。下载后的Lora模型放到如下目录:

/stable diffusion/stable-diffusion-webui/models/Lora 。

lora模型如何使用呢?

lora模型会作为一个正向提示词,出现在正向提示词输入框中,使用形式如下:

<lora:LORA_CNCG_arts:1>

* 1

* 2

LORA_CNCG_arts:表示lora模型名称

1:表示模型权重,在一个正向提示词输入框中可以使用多个lora模型,但是多个模型的权重之和不能超过1

这里可能有些老铁会有这样的疑问:

下载下来的模型都是一个文件,文件名称描述性也不高,有没有一个缩略图,可以直观的看出这个模型画出的图大概长什么样子?

其实是可以的,点击在如下图所示的按钮,可以查看你的stable diffusion已经安装了哪些模型。

在下载模型的时候,在模型所在的文件夹中,放入一张和模型名称相同的图片,那么这个图片成了模型的预览图了,而且,当你选中某个模型时,stable

diffusion就会直接使用这个模型。效果如下:

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)主题和汉化

到这里,你的stable diffusion就安装的差不多了,可以尝试的完成AI绘画了。

接下来,小编回答一下上面的的两个问题:操作控制台汉化和主题切换,同时演示一下 stable diffusion插件扩展功能。

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)主题切换成dark模式

切换方式很简单,只需要在访问地址后面拼接 “?__theme=dark” 即可,

完整地址如下:

http://localhost:7860/?__theme=dark

* 1

* 2

如果要切换成白色系,可以使用如下地址:

http://localhost:7860/?__theme=day

* 1

* 2

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)操作控制台汉化

操作控制台汉化其实是使用了一种中文插件完成的,

具体操作步骤如下:

1.打开stable diffusion webui,进入"Extensions"选项卡

2.点击"Install from URL",注意"URL for extension’s git repository"下方的输入框

3.粘贴或输入本Git仓库地址https://github.com/VinsonLaro/stable-diffusion-webui-chinese

4.点击下方的黄色按钮"Install"即可完成安装。

5.点击重启UI。

6.点击"Settings",左侧点击"User interface"界面,在界面里最下方的"Localization (requires

restart)“,选择"Chinese-All"或者"Chinese-English”

7.点击界面最上方的黄色按钮"Apply settings",再点击右侧的"Reload UI"即可完成汉化

[](https://blog.youkuaiyun.com/weixin_45701550/article/details/131274466?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522171894024116800213081076%2522%252C%2522scm%2522%253A%252220140713.130102334…%2522%257D&request_id=171894024116800213081076&biz_id=0&utm_medium=distribute.pc_search_result.none-

task-blog-2alltop_positive~default-1-131274466-null-

null.142%5Ev100%5Epc_search_result_base1&utm_term=ai%E7%BB%98%E7%94%BBstable%20diffusion%E6%95%99%E7%A8%8B&spm=1018.2226.3001.4187)总结

到这里,你就完成完成stable diffusion的入门了,可以使用stable

diffusion完成基本的绘图操作了,不过对于不是设计专业出身的老铁来说,想要完整的描述出自己想要的那副画面来说还是比较难的,也就是如何与stable

diffusion进行高效的沟通,再直接一点就是如何写提示词。写提示词有一定的技巧,小编进过几天的探索,也总结出了一些行之有效的套路,会在下一篇文章中给大家分享,敬请期待。

针对各位AIGC初学者,这里列举了一条完整的学习计划,感兴趣的可以阅读看看,希望对你的学习之路有所帮助,废话不多说,进入正题:

这份完整版的AI绘画(SD、comfyui、AI视频)整合包已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

目标应该是这样的:

第一阶段(30天):AI-GPT从入门到深度应用

该阶段首先通过介绍AI-GPT从入门到深度应用目录结构让大家对GPT有一个简单的认识,同时知道为什么要学习GPT使用方法。然后我们会正式学习GPT深度玩法应用场景。

-----------

- GPT的定义与概述

- GPT与其他AI对比区别

- GPT超强记忆力体验

- 万能GPT如何帮你解决一切问题?

- GPT表达方式优化

- GPT多类复杂应用场景解读

- 3步刨根问底获取终极方案

- 4步提高技巧-GPT高情商沟通

- GPT深度玩法应用场景

- GPT高级角色扮演-教学老师

- GPT高级角色扮演-育儿专家

- GPT高级角色扮演-职业顾问

- GPT高级角色扮演-专业私人健身教练

- GPT高级角色扮演-心理健康顾问

- GPT高级角色扮演-程序UX/UI界面开发顾问

- GPT高级角色扮演-产品经理

- GPT高级技巧-游戏IP角色扮演

- GPT高级技巧-文本冒险游戏引导

- GPT实操练习-销售行业

- GPT实操练习-菜谱推荐

- GPT实操练习-美容护肤

- GPT实操练习-知识问答

- GPT实操练习-语言学习

- GPT实操练习-科学减脂

- GPT实操练习-情感咨询

- GPT实操练习-私人医生

- GPT实操练习-语言翻译

- GPT实操练习-作业辅导

- GPT实操练习-聊天陪伴

- GPT实操练习-育儿建议

- GPT实操练习-资产配置

- GPT实操练习-教学课程编排

- GPT实操练习-活动策划

- GPT实操练习-法律顾问

- GPT实操练习-旅游指南

- GPT实操练习-编辑剧本

- GPT实操练习-面试招聘

- GPT实操练习-宠物护理和训练

- GPT实操练习-吸睛爆款标题生成

- GPT实操练习-自媒体爆款软件拆解

- GPT实操练习-自媒体文章创作

- GPT实操练习-高效写作推广方案

- GPT实操练习-星座分析

- GPT实操练习-原创音乐创作

- GPT实操练习-起名/解梦/写诗/写情书/写小说

- GPT提升工作效率-Word关键字词提取

- GPT提升工作效率-Word翻译实现

- GPT提升工作效率-Word自动填写、排版

- GPT提升工作效率-Word自动纠错、建议

- GPT提升工作效率-Word批量生产优质文章

- GPT提升工作效率-Excel自动化实现数据计算、分析

- GPT提升工作效率-Excel快速生成、拆分及合并实战

- GPT提升工作效率-Excel生成复杂任务实战

- GPT提升工作效率-Excel用Chat Excel让效率起飞

- GPT提升工作效率–PPT文档内容读取实现

- GPT提升工作效率–PPT快速批量调整PPT文档

- GPT提升工作效率-文件批量创建、复制、移动等高效操作

- GPT提升工作效率-文件遍历、搜索等高效操作

- GPT提升工作效率-邮件自动发送

- GPT提升工作效率-邮件自动回复

- GPT接入QQ与QQ群实战

- GPT接入微信与微信群实战

- GPT接入QQ与VX多用户访问实战

- GPT接入工具与脚本部署实战

第二阶段(30天):AI-绘画进阶实战

该阶段我们正式进入AI-绘画进阶实战学习,首先通过了解AI绘画定义与概述 ,AI绘画的应用领域 ,PAI绘画与传统绘画的区别 ,AI绘画的工具分类介绍的基本概念,以及AI绘画工具Midjourney、Stable Diffusion的使用方法,还有AI绘画插件和模板的使用为我们接下来的实战设计学习做铺垫。

- -----------

AI绘画定义与概述 - AI绘画的应用领域

- AI绘画与传统绘画的区别

- AI绘画的工具分类介绍

- AI绘画工具-Midjourney

- AI绘画工具-百度文心一格

- AI绘画工具-SDWebUI

- AI绘画工具-Vega AI

- AI绘画工具-微信中的AI绘画小程序

- Midjourney学习-Discord账号的注册

- Midjourney Bot界面讲解

- Midjourney提示词入门

- Midjourney高级提示词

- Midjourney版本参数学解读

- Midjourney功能参数

- Midjourney上采样参数

- AI绘画组合应用1-Midjourney + GPT

- AI绘画组合应用2-Stable Diffusion + GPT

- AI绘画组合应用3-AI绘画+ GPT +小红书

- AI绘画组合应用4-AI绘画+ GPT +抖音

- AI绘画组合应用5-AI绘画+ GPT +公众号

- AI绘画组合应用6-AI绘画+ GPT + AI视频

- AI绘画组合应用7-AI绘画+ GPT + 小说人物/场景

- AI绘画设计-Logo设计

- AI绘画设计-套用万能公式

- AI绘画设计-引用艺术风格

- AI绘画设计-GPT加速设计方案落地

- AI绘画设计-Vega AI渲染线稿生成设计

- AI绘画设计-摄影

- AI绘画设计-头像设计

- AI绘画设计-海报设计

- AI绘画设计-模特换装

- AI绘画设计-家具设计

- AI绘画设计-潘顿椅设计

- AI绘画设计-沙发设计

- AI绘画设计-电视柜设计

- AI绘画设计-包装设计的提示词构思

第三阶段(30天):AI-视频高段位

恭喜你,如果学到这里,你基本可以找到一份AIGC副业相关的工作,比如电商运营、原画设计、美工、安全分析等岗位;如果新媒体运营学的好,还可以从各大自媒体平台收获平台兼职收益。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

- -----------

AI视频定义与概述 - AI视频制作-方案与创新

- AI视频制作-各种工具实操

- AI视频制作-美学风格(油画/插画/日漫/水墨)

- AI视频制作-形象设定(人物形象服装/造型/表情)

- AI视频画面特效处理

- AI视频画面拼接

- AI视频画面配音

- AI视频画面包装

- AI视频锁定人物逐一精修

- 多种表情动作/情节

- 动态模型转换-视频内部元素关键帧

- 动态模型转换-图像整体运动

- 动态模型转换-虚拟人

- 动态模型转换-表面特效

- AI自媒体视频-深问GPT,获取方案

- AI自媒体视频-风格设置(诗歌/文言文等)

- AI自媒体视频-各行业创意视频设计思路

- AI视频风格转换

- AI视频字数压缩

- AI视频同类型衍生

- AI视频Pormpt公式

第四阶段(20天):AI-虚拟数字人课程

- -----------

AI数字人工具简介 - AI工作台界面功能展示及介绍

- AI数字人任务确定

- AI数字人素材准备

- AI知识、语料的投喂

- AI模型训练

- AI训练成果展示及改进

- AI数字人直播系统工具使用

- AI人物在各平台直播

- AI数字人在OBS平台直播

第五阶段(45天以上):AIGC-多渠道变现课程

该阶段是项目演练阶段,大家通过使用之前学习过的AIGC基础知识,项目中分别应用到了新媒体、电子商务等岗位能帮助大家在主流的新媒体和电商平台引流和带货变现。

-----------

- AI-小红书引流变现

- AI-公众号引流变现

- AI-知乎引流变现

- AI-抖音引流/带货变现

- AI-写作变现

- AI-B站引流变现

- AI-快手引流变现

- AI-百家号引流变现

- AI-制作素材模板出售变现

- AI-周边定制变现

- AI-手机壳图案定制变现

- AI-周边产品定制变现

- AI-服装图案定制变现

- AI-个性头像定制变现

- AI-起号与知识付费变现

- AI-实现淘宝销售变现

学习是一个过程,只要学习就会有挑战。天道酬勤,你越努力,就会成为越优秀的自己。

如果你能在15天内完成所有的任务,那你堪称天才。然而,如果你能完成 60-70% 的内容,你就已经开始具备成为一名AIGC的正确特征了。

这份完整版的AI绘画(SD、comfyui、AI视频)整合包已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?