ParseNet和部分文章中提到在进行feature fusion之前要进行 L2norm,这是因为多层feature map的激活值大小分布差距比较大,如果没有经过 norm,会导致激活值普遍较大的 feature map 对融合后的结果影响更大。

简介

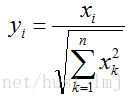

L2norm公式

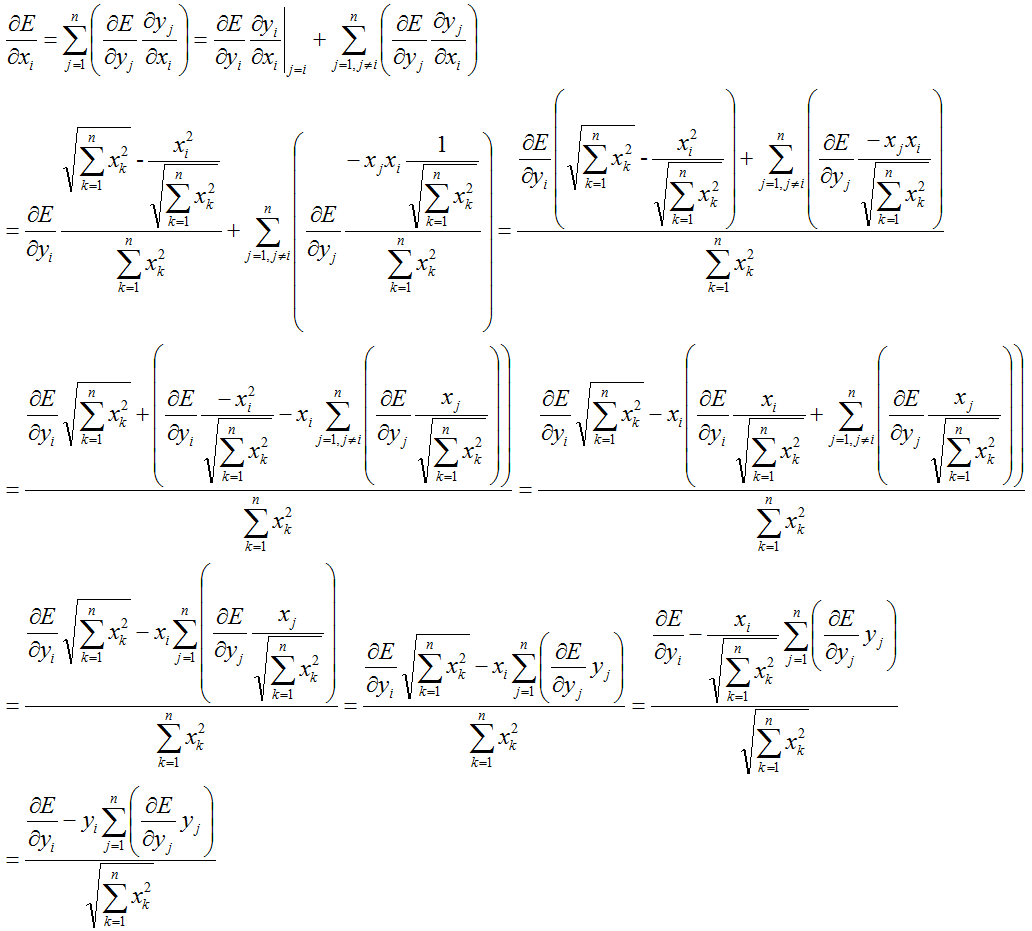

L2norm反向传播BP推导

L2norm的caffe实现

但是网上很难找到 L2norm 相关的源码,caffe本身也没有实现,大致看了一下github上有很多关于 L2norm 的实现也不够完善,比如并没有提供 across spatial: false/ true 两种不同的模式,经过搜索,发现实际上 ParseNet 的作者Wei Liu大神在自己的Github上放出了L2norm的官方源码,只是命名和存放位置不太好找。

Wei Liu大神实现的L2norm源码可以见这里,其命名为normalize_layer,对应的 .cpp, .cu, .hpp 文件都可以在对应的位置找到。另外由于Wei Liu大神的 SSD 文章中也用到了 L2norm,因此可以在 SSD 的 prototxt 中找到noramlize_layer的使用范例,见

本文详细介绍了L2norm在ParseNet中的作用,分析了L2norm的公式和反向传播推导,并探讨了在caffe中如何实现L2norm。作者还分享了Wei Liu大神提供的官方源码及在SSD中的应用示例,同时讨论了关键参数across_spatial和channel_shared的影响。最后,作者总结了在特征融合中应用L2norm和其他norm层的体验,指出初始化参数设置对结果至关重要。

本文详细介绍了L2norm在ParseNet中的作用,分析了L2norm的公式和反向传播推导,并探讨了在caffe中如何实现L2norm。作者还分享了Wei Liu大神提供的官方源码及在SSD中的应用示例,同时讨论了关键参数across_spatial和channel_shared的影响。最后,作者总结了在特征融合中应用L2norm和其他norm层的体验,指出初始化参数设置对结果至关重要。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

364

364

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?