爬前叨叨

缘由

今天本来没有打算抓取这个网站的,无意中看到某个微信群有人问了一嘴这个网站,想看一下有什么特别复杂的地方,一顿操作下来,发现这个网站除了卡慢,经常自己宕机以外,好像还真没有什么特殊的…

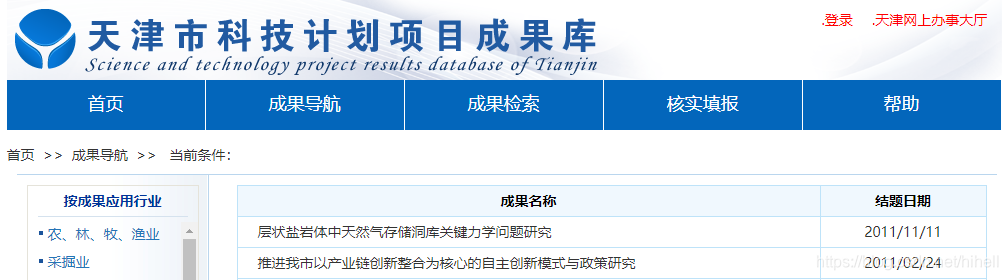

爬取网址 http://cgk.kxjs.tj.gov.cn/navigation.do

有很明显的分页表示

列表如下

Request URL: http://cgk.kxjs.tj.gov.cn/navigation.do

Request Method: POST

参数说明,里面两个比较重要的 pageNum 页码,numPerPage 每页显示的数据

本文介绍了使用Python的Scrapy框架爬取天津市科技计划项目成果库数据的过程,包括缘由、爬取网址、数据解析及入库操作。在爬取过程中,遇到网站卡慢和频繁宕机的问题,建议考虑使用代理IP或Selenium来提高稳定性。

本文介绍了使用Python的Scrapy框架爬取天津市科技计划项目成果库数据的过程,包括缘由、爬取网址、数据解析及入库操作。在爬取过程中,遇到网站卡慢和频繁宕机的问题,建议考虑使用代理IP或Selenium来提高稳定性。

订阅专栏 解锁全文

订阅专栏 解锁全文

1487

1487

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?