更多面试题看这里 面试题总结_耗子来啦的博客-优快云博客

背景

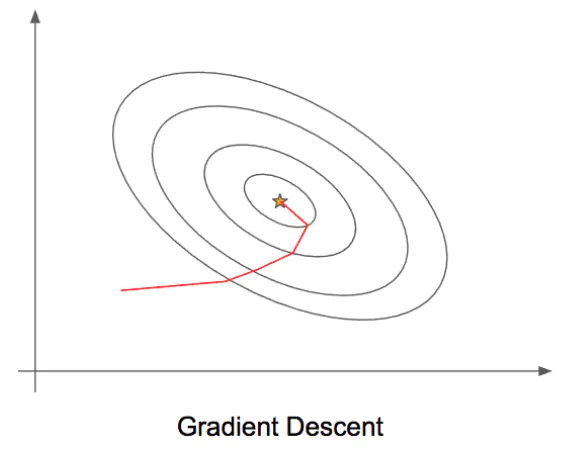

批量梯度下降法(batch gradient decent)就是我们平时所说的梯度下降,也就是梯度下降过程中,每次更新使用了所有的训练数据,最小化损失函数,找到局部最小值。

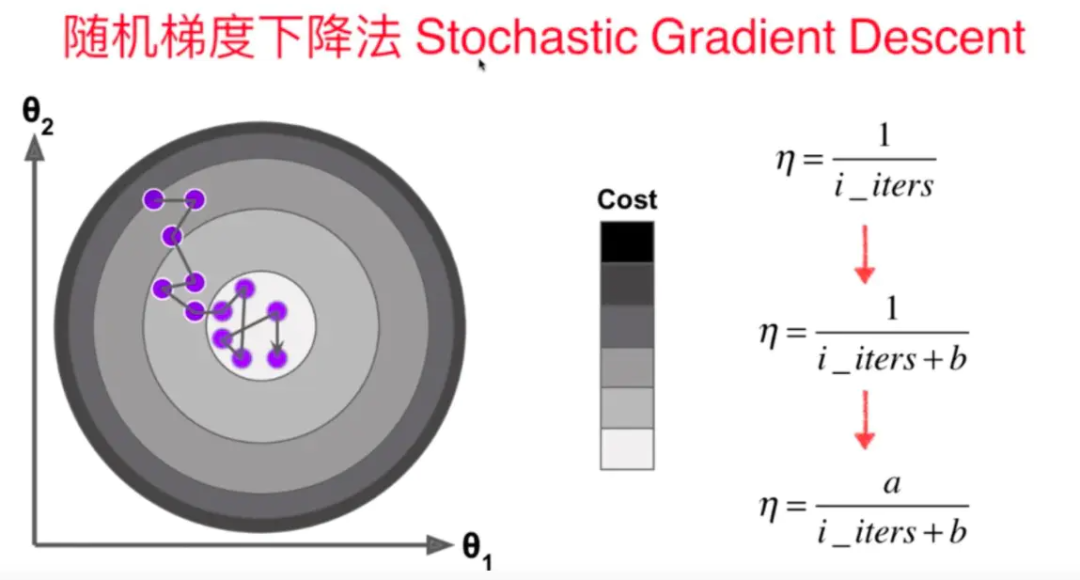

当样本量很大的时候,那么更新速度会变慢。假如每次我们只取一个样本更新,这样速度就会快很多。我们每次只取一行样本计算,当成是搜索的方向。

问题解答

批量梯度下降

a)采用所有数据来梯度下降。

b)批量梯度下降法在样本量很大的时候,训练速度慢。

随机梯度下降

a)随机梯度下降用一个样本来梯度下降。

b)训练速度很快。

c)随机梯度下降法仅仅用一个样本决定梯度方向,导致解有可能不是全局最优。

d)收敛速度来说,随机梯度下降法一次迭代一个样本,导致迭代方向变化很大,不能很快的收敛到局部最优解。

本文探讨了批量梯度下降与随机梯度下降在大规模数据和效率上的区别,强调了随机梯度下降速度快但可能不是全局最优,而批量下降虽慢但更稳定。

本文探讨了批量梯度下降与随机梯度下降在大规模数据和效率上的区别,强调了随机梯度下降速度快但可能不是全局最优,而批量下降虽慢但更稳定。

1091

1091

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?