激活函数

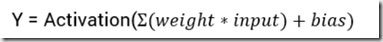

激活函数是人工神经网络的一个极其重要的特征。它决定一个神经元是否应该被激活,激活代表神经元接收的信息与给定的信息有关。

激活函数对输入信息进行非线性变换。 然后将变换后的输出信息作为输入信息传给下一层神经元。

激活函数作用

当我们不用激活函数时,权重和偏差只会进行线性变换。线性方程很简单,但解决复杂问题的能力有限。没有激活函数的神经网络实质上只是一个线性回归模型。激活函数对输入进行非线性变换,使其能够学习和执行更复杂的任务。我们希望我们的神经网络能够处理复杂任务,如语言翻译和图像分类等。线性变换永远无法执行这样的任务。激活函数使反向传播成为可能,因为激活函数的误差梯度可以用来调整权重和偏差。如果没有可微的非线性函数,这就不可能实现。总之,激活函数的作用是能够给神经网络加入一些非线性因素,使得神经网络可以更好地解决较为复杂的问题。

激活函数种类

Sigmoid函数

函数如下:作用是计算 x 的 sigmoid 函数。具体计算公式为 y=1/(1+exp(−x)),将值映射到[0.0 , 1.0]区间

当输入值较大时,sigmoid将返回一个接近于1.0的值,而当输入值较小时,返回值将接近于0.0.

优点:在于对在真实输出位于[0.0,1.0]的样本上训练的神经网络,sigmoid函数可将输出保持在[0.0,1.0]内的能力非常有用.

缺点:在于当输出接近于饱和或者剧烈变化是,对输出返回的这种缩减会带来一些不利影响.

当输入为0时,sigmoid函数的输出为0.5,即sigmoid函数值域的中间点函数图像如下所示:

激活函数在神经网络中扮演着至关重要的角色,它们引入非线性,使网络能处理复杂问题。常见的激活函数有Sigmoid、Softmax、Tanh、ReLU、ELU、SELU等,每种函数有其特定的优缺点。例如,ReLU因其缓解梯度消失问题而在隐藏层广泛使用,而Softmax则常用于多分类任务。选择激活函数需考虑问题的性质,如梯度消失问题、分类任务需求等。理解梯度在优化过程中的作用,如梯度下降法,也对模型训练至关重要。

激活函数在神经网络中扮演着至关重要的角色,它们引入非线性,使网络能处理复杂问题。常见的激活函数有Sigmoid、Softmax、Tanh、ReLU、ELU、SELU等,每种函数有其特定的优缺点。例如,ReLU因其缓解梯度消失问题而在隐藏层广泛使用,而Softmax则常用于多分类任务。选择激活函数需考虑问题的性质,如梯度消失问题、分类任务需求等。理解梯度在优化过程中的作用,如梯度下降法,也对模型训练至关重要。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

545

545

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?