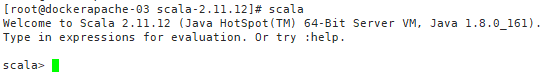

1 centos安装scala

1.下载:

https://downloads.lightbend.com/scala/2.11.12/scala-2.11.12.tgz

2.解压至【/usr/local】

tar -xvzf scala-2.11.12.tgz

3.配置环境变量

vim /etc/profile

#scala

export SCALA_HOME=/usr/local/scala-2.11.12

export PATH=$SCALA_HOME/bin:$PATH

配置完成

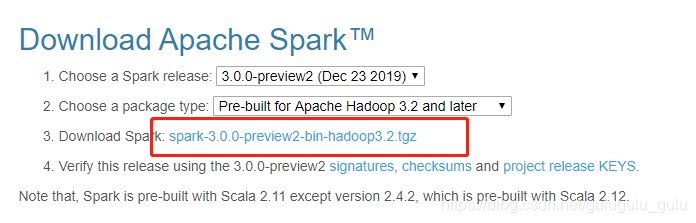

2 安装spark

以下在master节点上进行

dockerapache-01

dockerapache-02

dockerapache-03 #master

1.下载spark,

http://spark.apache.org/downloads.html

这里由于我的hadoop是3.1.3, 所以选择基于3.2的进行尝试

2. 上传至master节点上,解压至【/usr/local】

tar -xvzf spark-3.0.0

本文介绍了在CentOS上安装Scala 2.11.12,并详细讲解了如何在master节点上安装Spark 3.0.0,特别是针对基于Hadoop 3.2的环境。安装过程包括下载安装包、解压、配置环境变量和conf文件。文章还提到了在master节点上启动Spark以及启动客户端(Yarn)时遇到的问题和解决方法,适合需要部署Spark的开发者参考。

本文介绍了在CentOS上安装Scala 2.11.12,并详细讲解了如何在master节点上安装Spark 3.0.0,特别是针对基于Hadoop 3.2的环境。安装过程包括下载安装包、解压、配置环境变量和conf文件。文章还提到了在master节点上启动Spark以及启动客户端(Yarn)时遇到的问题和解决方法,适合需要部署Spark的开发者参考。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2159

2159

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?