树模型简介

树模型是有监督学习类算法中应用广泛的一类模型,同时可应用于分类问题和回归问题,其中,用于解决分类问题的树模型常被称为分类树,而用于解决回归类问题的树模型被称作回归树。

树模型通过递归式切割的方法来寻找最佳分类标准,进而最终形成规则。其算法原理虽然简单,但模型本身适用面极广,且在分类问题和回归问题上均有良好的表现,外加使用简单,无须人为进行过多变量调整和数据预处理,同时生成规则清晰,模型本身的可解释性非常强,因此在各行业均有广泛应用。

分类决策树

决策树(Decision Tree)是一种实现分治策略的层次数据结构。它是一种有效的非参数学习方法,并可以用于分类和回归。本文主要讨论分类决策树。

分类决策树模型是一种基于特征对实例进行分类的树形结构(包括二叉树和多叉树)。

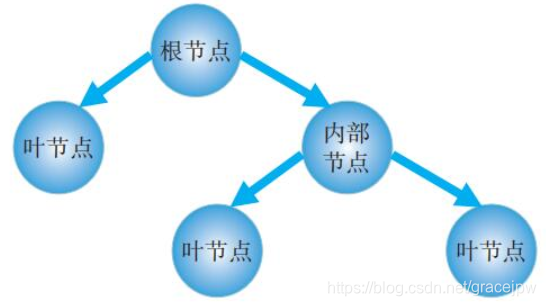

决策树由结点(node)和有向边(directed edge)组成,树中包含三种结点:

根结点(root node):包含样本全集。没有入边,但有零条或多条出边;

内部结点(internal node):对应于属性测试条件,恰有⼀一条入边,和两条或多条出边;

叶结点(leaf node)或终结点(terminal node):对应于决策结果,恰有一条入边,但没有出边。

原理

从根结点到每个叶结点的路径对应了一个判定测试序列,其基本流程遵循简单且直观的 “分而治之” 策略。由此,局部区域通过少数几步递归分裂确定,每个决策节点实现一个具有离散输出的属性测试函数,标记分支。

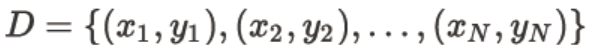

假设给定训练数据集输入:

在每个结点应用一个测试,并根据测试的输出确

本文详细介绍了决策树模型,包括其在分类问题中的应用,以及决策树的构造原理。通过递归式切割寻找最佳分类标准,决策树生成易于理解和解释的规则。文章还探讨了决策树与条件概率分布的关系,以及采用贪心算法进行学习的过程。

本文详细介绍了决策树模型,包括其在分类问题中的应用,以及决策树的构造原理。通过递归式切割寻找最佳分类标准,决策树生成易于理解和解释的规则。文章还探讨了决策树与条件概率分布的关系,以及采用贪心算法进行学习的过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2389

2389

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?