探索未来视觉:Depthstillation - 从静止图像学习光流的革命性框架

项目介绍

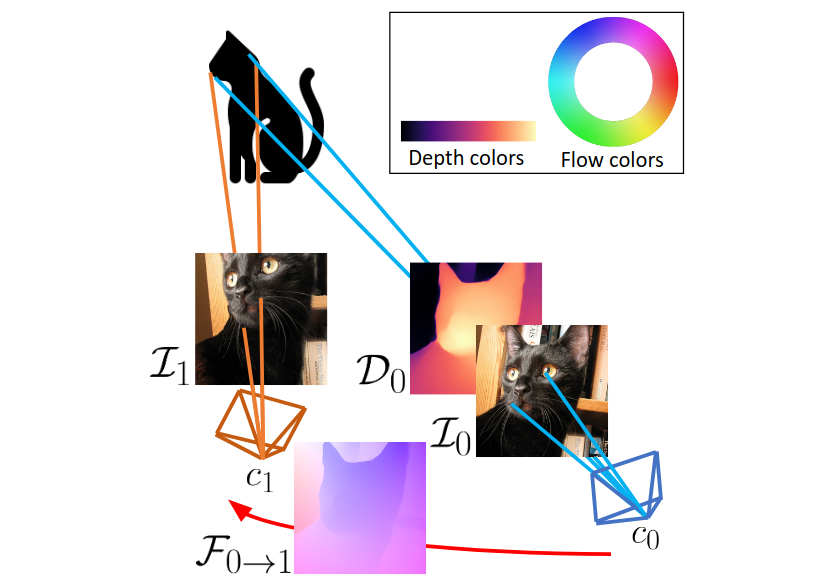

深度合成(Depthstillation)是CVPR 2021年发表的一项创新研究的代码实现,它提出了一种从单张真实图片快速生成大量精确光流标注的新方法。这个开源项目不仅解决了训练光流网络数据稀缺的问题,还展示了超越传统合成数据和无标签视频训练的效果。

项目技术分析

Depthstillation通过利用现成的单目深度估计网络构建场景的点云,然后模拟相机在重建环境中的移动,从而合成新的视图和相应的光流场。这种方法允许模型在没有真实世界标注的情况下进行训练,并展现出强大的泛化能力和特殊化性能。

该项目提供了详细的说明和样例代码,用户可以轻松编译并运行实验,观察不同参数设置下的结果,例如更改虚拟运动数量、启用实例分割等。

应用场景

Depthstillation及其相关技术适用于以下场景:

- 数据增强:为光学流网络提供丰富的训练数据,以提高模型对现实世界的适应性。

- 计算机视觉研究:用于研究如何处理单一图像中的动态和复杂情况。

- 自动驾驶:帮助车辆理解周围环境的变化,改善驾驶安全。

- 机器人导航:使机器人能够更好地感知运动和场景变化。

项目特点

- 创新方法:使用静态图像生成高精度的光流数据,打破传统数据获取方式的局限。

- 易于复现:提供清晰的使用指南和预处理代码,方便研究人员和开发者快速上手。

- 强大效果:经验证,使用该项目的数据训练的模型,在真实数据上的表现优于仅使用合成数据或无标签视频训练的模型。

- 灵活性:支持多种参数配置,可用于各种场景的模拟和特定需求的研究。

引用

如果你在工作中使用了Depthstillation,请引用以下文献:

@inproceedings{Aleotti_CVPR_2021,

title = {Learning optical flow from still images},

author = {Aleotti, Filippo and

Poggi, Matteo and

Mattoccia, Stefano},

booktitle = {IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)},

year = {2021}

}

探索深度合成,开启视觉感知的新篇章,立即试用Depthstillation,提升你的光学流动态建模能力!

创作声明:本文部分内容由AI辅助生成(AIGC),仅供参考

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?