《Convolutional Neural Networks for Sentence Classification》

概述:使用基于word2vec的单层CNN,对多个文本分类任务进行了评测。

结论:

1.word2vec是个好东西。使用pre-training 训练的资源成为nlp不可或缺的一部分。

2.Dropout可以提高2%-4%的相对性能。

3.多通道的CNN相对于Static CNN并没有太大提升。对Static CNN进行finetune可以进一步提升效果。

4.Adadelta算法与Adagram算法得到的效果基本相当,但是Adadelta算法需要的epoch更少。

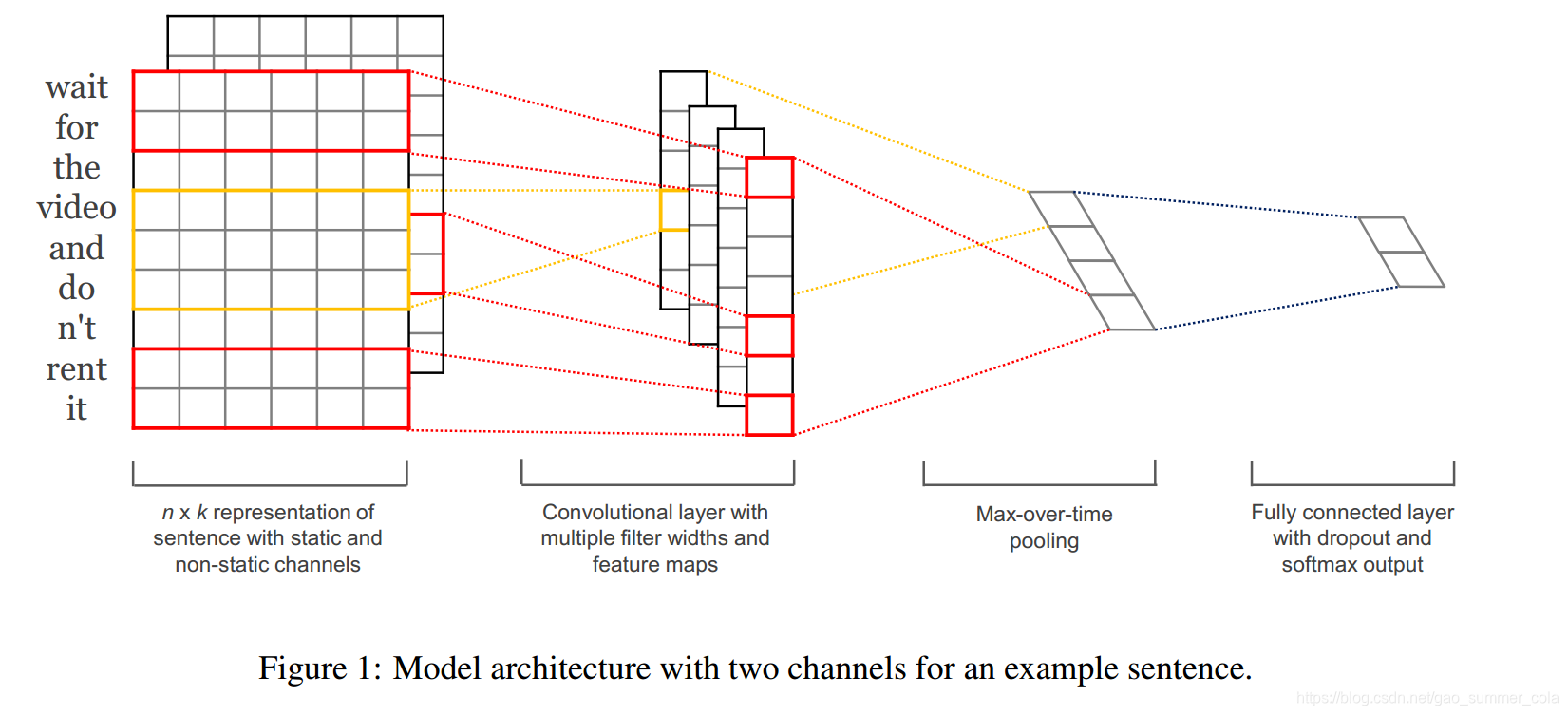

5.使用宽度为(3,4,5)的三种不同卷积核提取特征,再进行最大池化,最后将提取到的特征拼接在一起,输入到一个fullyconnect层,再经过softmax层,获取在分类标签上的概率分布。

本文介绍了一种基于word2vec预训练的单层卷积神经网络(CNN)在文本分类任务中的应用,通过实验验证了其在多个数据集上的有效性。研究发现,Dropout能显著提升模型性能,多通道CNN与StaticCNN相比提升有限,但finetune能进一步增强效果。Adadelta与Adagram算法表现相近,但前者训练速度更快。采用不同宽度的卷积核提取特征并进行最大池化,最终通过全连接层和softmax层进行分类。

本文介绍了一种基于word2vec预训练的单层卷积神经网络(CNN)在文本分类任务中的应用,通过实验验证了其在多个数据集上的有效性。研究发现,Dropout能显著提升模型性能,多通道CNN与StaticCNN相比提升有限,但finetune能进一步增强效果。Adadelta与Adagram算法表现相近,但前者训练速度更快。采用不同宽度的卷积核提取特征并进行最大池化,最终通过全连接层和softmax层进行分类。

1659

1659

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?