由于标定的需求,需要使用sam进行蒙板生成,sam项目地址:

https://github.com/facebookresearch/segment-anything我的设备信息:ubuntu20.04,CUDA 12.3

项目的requirement:

python>=3.8

pytorch>=1.7

torchvision>=0.8使用miniconda创建虚拟环境,输入命令后回车,y

conda create -n sam_name python=3.8创建成功,激活新创建的环境

conda activate sam_name下面安装pytorch、torchvision包:

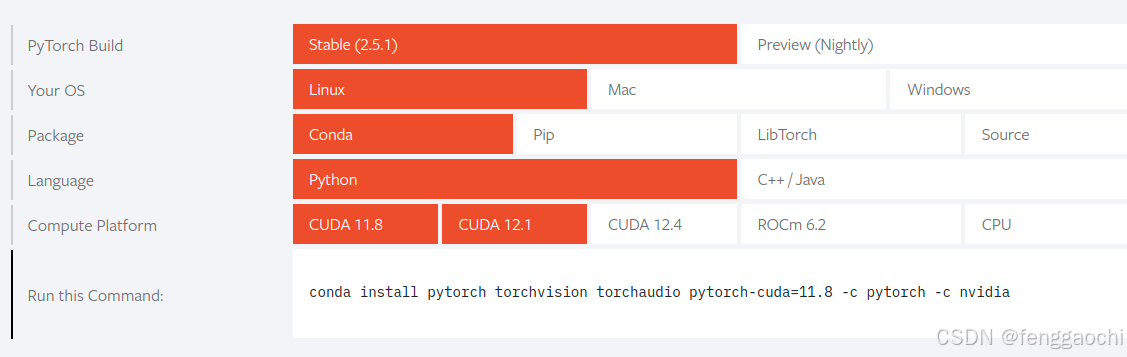

进入Pytorch官网

https://pytorch.org/进行版本选择,复制生成的命令,在sam_name环境中运行

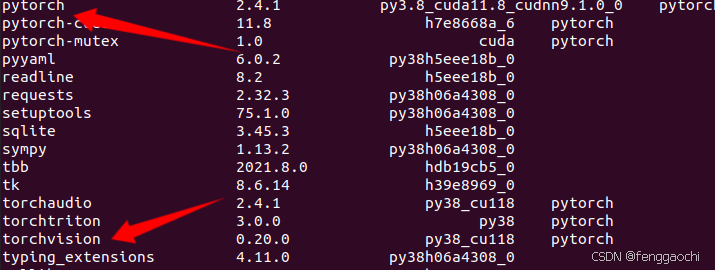

安装完成后,在sam_name环境下输入conda list查看是否安装成功,如果有下图的两个包代表成功:

下面执行命令,在主目录建立存放sagmet_anything的文件夹

#到主目录

cd /home/wyh/

#创建文件夹

mkdir sam_demo

#进入文件夹

cd sam_demo/

#从github上下载源码到文件夹

git clone https://github.com/facebookresearch/segment-anything下载完成后,sam_demo文件夹下会多出segment-anything文件,下面进行安装

#进入项目

cd segment-anything/

#安装

pip install -e .

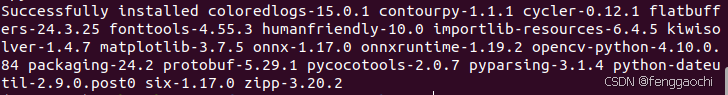

pip install opencv-python pycocotools matplotlib onnxruntime onnx出现下图的内容,说明一切顺利:

接着下载模型:https://dl.fbaipublicfiles.com/segment_anything/sam_vit_l_0b3195.pth

浏览器下载完成后,在终端将模型放到segment_anything文件夹下

sudo cp /home/wyh/下载/sam_vit_l_0b3195.pth /home/wyh/sam_demo/segment-anything/安装完成!下面跑一次示例数据

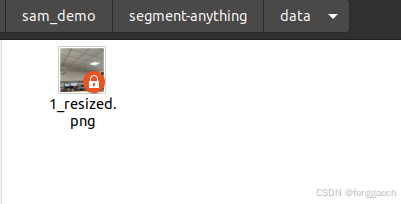

在segment_anything文件夹下新建data文件,里面放上一张图片,像这样

打开终端,确保在在sam_name环境和segmeng_anything文件夹下,运行下面命令

# run

python scripts/amg.py --checkpoint <path/to/checkpoint> --model-type <model_type> --input <image_or_folder> --output <path/to/output>

## example(recommended parameter)

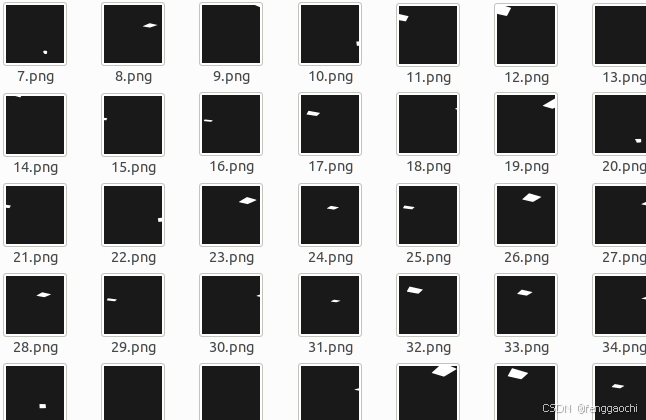

python scripts/amg.py --checkpoint sam_vit_l_0b3195.pth --model-type vit_l --input 1_resized.png --output ./output/ --stability-score-thresh 0.9 --box-nms-thresh 0.4 --stability-score-offset 0.9等待程序跑完,即可在segment_anything文件夹下,生成一个output文件,里面存放着输出的蒙板文件

大功告成!

3820

3820

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?