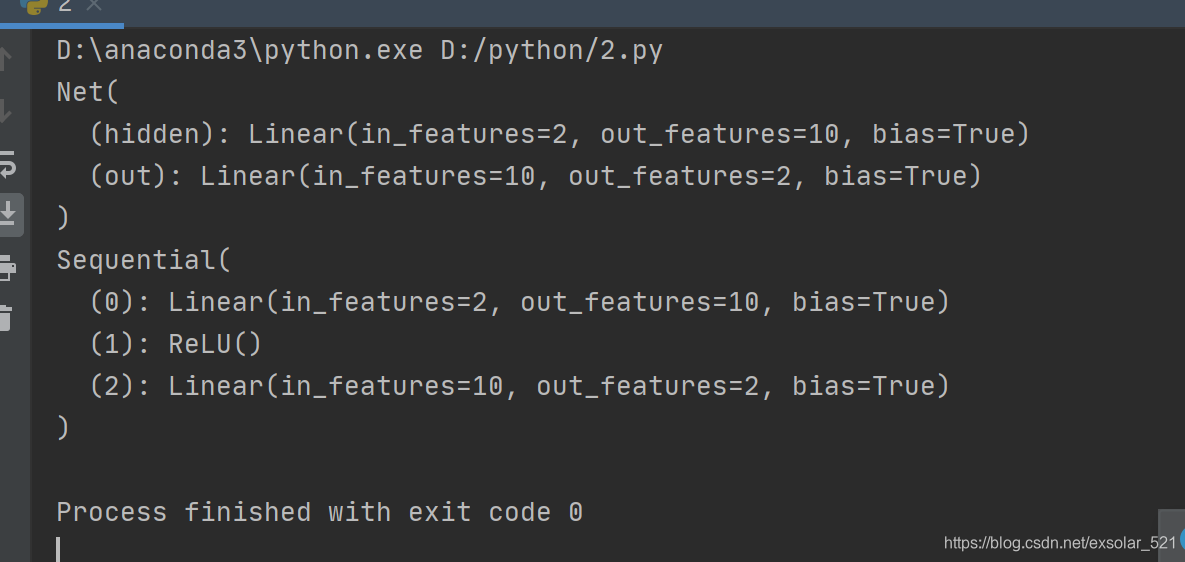

由上述结果可以看出,两种不同的神经网络搭建方式,第二种结构中包含了激活函数,此时Relu大写为一个类。第一种结构激活函数在forward( )中,此时relu小写,为功能。相比之下,我们可以在第一种方式中个性化前向传播功能。

pytorch快速搭建神经网络

最新推荐文章于 2024-08-30 22:25:47 发布

本文探讨了激活函数在神经网络结构中的两种不同实现方式。一种是在神经网络的搭建过程中直接使用Relu作为类,另一种则是在forward()函数内部使用小写的relu。通过对比,我们可以看到在第二种方式下,前向传播功能可以更加灵活地进行个性化定制。

本文探讨了激活函数在神经网络结构中的两种不同实现方式。一种是在神经网络的搭建过程中直接使用Relu作为类,另一种则是在forward()函数内部使用小写的relu。通过对比,我们可以看到在第二种方式下,前向传播功能可以更加灵活地进行个性化定制。

8万+

8万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?