TextInputFormat会创建RecordReader去读取数据,通过getCurrentKey、getCurrentValue、nextKeyValue等方法来读取;读取的结果要形成key value的形式

以wordcount为例,

1.客户端运行类似如下代码:

hadoop jar wordcount.jar cn.xx.xx.MainClass /input/ /output/

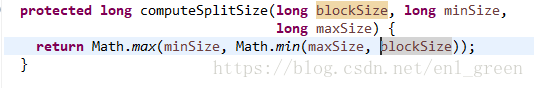

2.FileInputStream首先要计算切片大小(FileInputFormat是一个抽象类,它继承了InputFormat这个接口,真正干活的是它下面的实现类,默认是TextInputFormat;TextInputFormat是读取文件的,并且默认是一行一行读取;其实FileInputFormat下还有很多实现类,可以实现读取字节,读取数据库,多行读取等功能;);计算公式是:

Math.max(minSize, Math.min(maxSize, blockSize));源代码见下图:

默认情况下,每个片的大小就是块的大小;这样设计是有原因的,如果一个片定义的大于一个块,则检索数据时要去其它datanode节点获取数据,造成多余的网络io,影响性能;

3.过程2的分片结果会形成类似如下结果并保存成文件,命名为job.split:

a.txt 0~128m

a.txt 128~256m

a.txt 256~300m

b.txt 0~60m

。。。。。。

注意:尽管我们可以使用默认的块大小或自定义的方式来定义片的大小,但一个文件的大小如果是在切片的1.1倍以内,仍作为一个片存储;而不会将那多出来的0.1单独作为一个片;

4.TextInputFormat会创建RecordReader去读取数据,通过getCurrentKey、getCurrentValue、nextKeyValue等方法来读取;读取的结果要形成key value的形式,并返回给maptask;

5.注意maptask的创建是由mrappmaster来管理创建的(其实mrappmaster不只是协调maptask,也包括reducetask),过程3生成了job.split文件,再加上生成的job.xml以及wordcount.jar文件会一并提交到hdfs(共享区域,默认保存十份),yarn收集并设置了相关参数(这些参数来自job.xml),以及分配了的节点的cpu和内存信息然后会封装一个container对象,找到对应节点(比较空闲的节点,通过nodemanager和resourcemanager来找到)并在这个节点上启动mrappmaster,如果打开了uber模式并满足小作业的要求(10map以内,1个reduce),则在当前节点运行mr(启动mrappmaster后会去共享区域拉取切片、job.xml、jar文件)否则mrappmaster会再次访问resourcemanager,来分配资源(container)决定在哪些节点上启动maptask以及启动几个(基于效率的原因,默认是在文件的block所在节点上启动,当然,如果此时这个节点正忙,也可能在别的节点上启动);

6.maptask启动后,就可以接收由TextInputFormat读取过来的数据了。

本文详细介绍了MapReduce执行过程,从客户端运行job开始,讲解了如何计算切片大小,切片结果如何保存,TextInputFormat如何读取数据形成key value对,以及YARN如何管理MapTask的创建和分配。重点讨论了切片策略对性能的影响以及maptask在YARN中的执行流程。

本文详细介绍了MapReduce执行过程,从客户端运行job开始,讲解了如何计算切片大小,切片结果如何保存,TextInputFormat如何读取数据形成key value对,以及YARN如何管理MapTask的创建和分配。重点讨论了切片策略对性能的影响以及maptask在YARN中的执行流程。

1114

1114

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?