学习人类活动以用于辅助生活机器人

摘要

随着老年人口的增加,辅助生活近年来受到越来越多的关注。这促使人们希望采用技术解决方案来降低成本。在老年人护理等领域,通过辅助技术(尤其是辅助机器人)学习执行人类日常生活活动变得愈发重要。本文提出了一种利用从 RGB-D传感器获取的信息进行活动识别的方法,以实现对人类活动的学习。学习过程中将使用通过对活动相关方面进行聚类和分类所获得的关键特征。现有的活动识别方法仍存在局限性,阻碍了其广泛应用。本研究是旨在通过迁移学习提升人机交互能力的人类活动学习项目的一部分。为测试和验证我们的方法,采用了CAD-60人类活动数据集。

CCS概念

- 计算方法 ! 活动识别与理解;

- 基于分类的监督学习;

- 特征选择;

- 机器人视觉;

- 图像表示;

关键词

活动识别,辅助机器人,环境辅助生活,特征提取

美国计算机协会参考格式:

大卫·阿达·阿达马、艾哈迈德·洛特、卡罗琳·兰根西彭、凯文·李和佩德罗·特林达德。2017年。用于辅助生活机器人的学习人类活动。收录于PETRA ‘17 会议录,希腊罗得岛,2017年6月21-23日,共7页。

数字对象标识符: http://dx.doi.org/10.1145/3056540.3076197

David A. Adama 是一名博士研究生,他作为论文研究的一部分开展了此项研究。

†Ahmad Lot是通讯作者。 e 相应的电子邮件地址为:ahmad.lot@英国诺丁汉大学

个人或课堂教学使用,可免费复制本作品的全部或部分内容,无论是数字形式还是纸质形式,但不得以营利或获取商业利益为目的进行复制或分发,且所有复制品须在首页注明本声明及完整引用信息。若本作品中包含非作者拥有的组成部分,其版权必须得到尊重。注明出处的摘要允许使用。如需以其他方式复制、重新发布、上传至服务器或再分发到列表,则必须事先获得特别许可和/或支付费用。许可申请请发送邮件至permissions@acm.org。PETRA ‘17, 罗得岛, 希腊© 2017年 版权由所有者/作者持有。出版权利授权给美国计算机协会。ISBN 978-1-4503-5227-7/17/06…$15.00 数字对象标识符: http://dx.doi.org/10.1145/3056540.3076197

1 引言

随着发达国家社会老龄化人口的增加,环境辅助生活(AAL)技术有助于降低老年人护理的成本。实现这一目标的一种方式是在环境辅助生活环境中部署辅助机器人。这要求机器人学习人类护理人员在日常任务中执行的工作。

近年来,人类活动识别受到了广泛关注[9][10][11]。在涉及人机交互的应用中(例如游戏和辅助生活环境),人类活动识别能够对人类所执行的活动进行详细的解释/解读。这是理解这些活动如何被学习以及一次经历如何与另一次经历相关联的关键。这有助于提升辅助机器人的协作能力和适应能力。

在辅助机器人执行人类活动之前,它们需要学习这些活动以便有效完成。这需要将人类动作与其描述性语义进行分组。通过使用视觉或非视觉传感器观察正在执行的活动,可以更容易地获取环境中人类活动的信息。如果使用普通视觉传感器(如提供二维视觉数据的RGB摄像头)来理解和解释活动将会非常困难。这些传感器为真实环境中的活动提供的信息有限。然而,近年来RGB-D传感器的发展表明,它们是观测人类活动更优越的设备。这些传感器提供了更好地观察世界的方式,可用于检测人体姿态,进而构建活动识别系统。

它们还提供了利用深度图、身体形状以及三维空间中人类骨骼关节点检测的平台,这些都用于开发复杂的识别算法。

本文提出了一种利用RGB-D传感器提供的三维人体骨骼数据进行人类活动识别的监督学习方法。所提出的方法展示了活动执行过程中的观测情况,以及在应用聚类方法后如何提取特征,从而提供了一种对不同活动进行分类的手段。所提取的特征简化了学习活动的过程。本文所展示的工作是某研究项目的一部分,该研究项目旨在通过迁移学习改进人机交互或机器人间交互。这将使可适应机器人能够从迁移知识中学习执行人类日常生活活动。例如,在图

1,展示了两个机器人执行一项活动,其中一个作为教师,另一个作为学习者,通过从视觉观察中获得的迁移知识来学习,当教师机器人执行该活动时。我们研究的目标是开发一个先进的系统,使其具备与人类相当的人类活动识别和学习性能。

本文组织如下:第2节综述了该领域的相关工作;第3节介绍了我们所采用方法的细节;第4节展示了初步结果;第5节提出了结论和未来工作。

2 相关工作

辅助机器人要执行日常生活活动(ADL),需要对活动有理解,这一过程即为学习。学习过程中的一个重要方面是识别由人类行为者所执行的活动。这就要求机器人必须正确地进行环境观察,以准确解释活动。

利用RGB-D传感器获取的信息进行人类活动识别(HAR)为机器人理解人类活动提供了非常重要的信息。通过探索使用RGB-D传感器进行人体姿态检测,近年来活动识别取得了更多进展[4][19]。这些RGB-D传感器从深度图像和人体轮廓中提取三维骨架数据,用于特征生成[1]。在[4],中,RGB-D传感器被用来生成人体3D骨架模型,并通过关节连接实现身体部位的匹配。它们以三维形式x, y, z提取骨骼中各个关节的位置。文献[10]中的作者使用类似的RGB-D传感器获取人类活动的深度轮廓,并从中提取身体点信息,供活动识别系统使用。另一种方法见于[5]的研究,其中RGB-D传感器被用于获取每个关节相对于人体中心在三维空间中的基于方向的人体表示。使用RGB-D传感器获得的数据集需要进行预处理,这是活动识别中的一个重要步骤。

系统。 该过程用于 滤数据,以更好地表示活动的特征。

通过视频摄像头传感器进行人类活动识别(HAR)可以分为两个方面[18]:基于特征和基于模型。基于特征的技术,例如方向梯度直方图(HOG)[21],子空间聚类方法(SCAR)[25],用于从传感器获取的数据中提取特征以识别人类活动。基于模型的方法涉及构建人体模型以进行识别,该模型可以是二维、三维或骨架模型。[1][23]中的作者使用运动学方法构建模型,从帧序列中提取特征以表示人体结构。在[20]中可以看到基于特征和基于模型方法的结合,其中使用最大熵马尔可夫模型(MEMM)对来自骨架跟踪结合HOG的特征进行活动分类。[3]中的作者还使用神经网络技术,提出了一种端到端分层循环神经网络(RNN),用于表示基于骨架的构建。ey将人体关节的原始位置作为RNN的输入。

上述报告的所有方法均使用特征提取技术来获取描述所执行活动的特征向量。利用从RGB-D传感器提取的人体3D关节位置信息的人类活动识别方法,将单个帧的关节点位置转换为列向量。然后形成矩阵,以在特定时间间隔内编码帧序列。通过不同身体部位之间的距离获得的14种特征用于表征12种活动[4]。该方法与多个分类器组合使用,形成了动态贝叶斯混合模型(DBMM)。类似地,[8]应用了3D关节的统计协方差(Cov3DJ)作为特征,以编码原始关节位置的骨骼数据。另一种在[24]中看到的方法使用了关节轨迹序列,并应用小波将每个关节的时间序列编码为特征。由于并非人体的所有关节都能为解释所执行的活动提供重要信息,因此提出了不同的方法来选择更具描述性的关键关节[2][7][14][16],并将研究一种最优方法用于本研究。

在下一节中,将解释从RGB-D传感器获取的骨骼数据的原始关节位置中进行特征提取和活动识别的提出的方法。

3 活动识别系统 M

为了从RGB-D传感器识别活动,第一阶段是识别骨架的原始关节位置。这是通过获取由人类执行活动时记录的带有标注数据的帧来实现的。所捕获的数据包含活动的层次结构、人体骨骼特征及其随时间的转换。该系统可设置在生活环境之中。

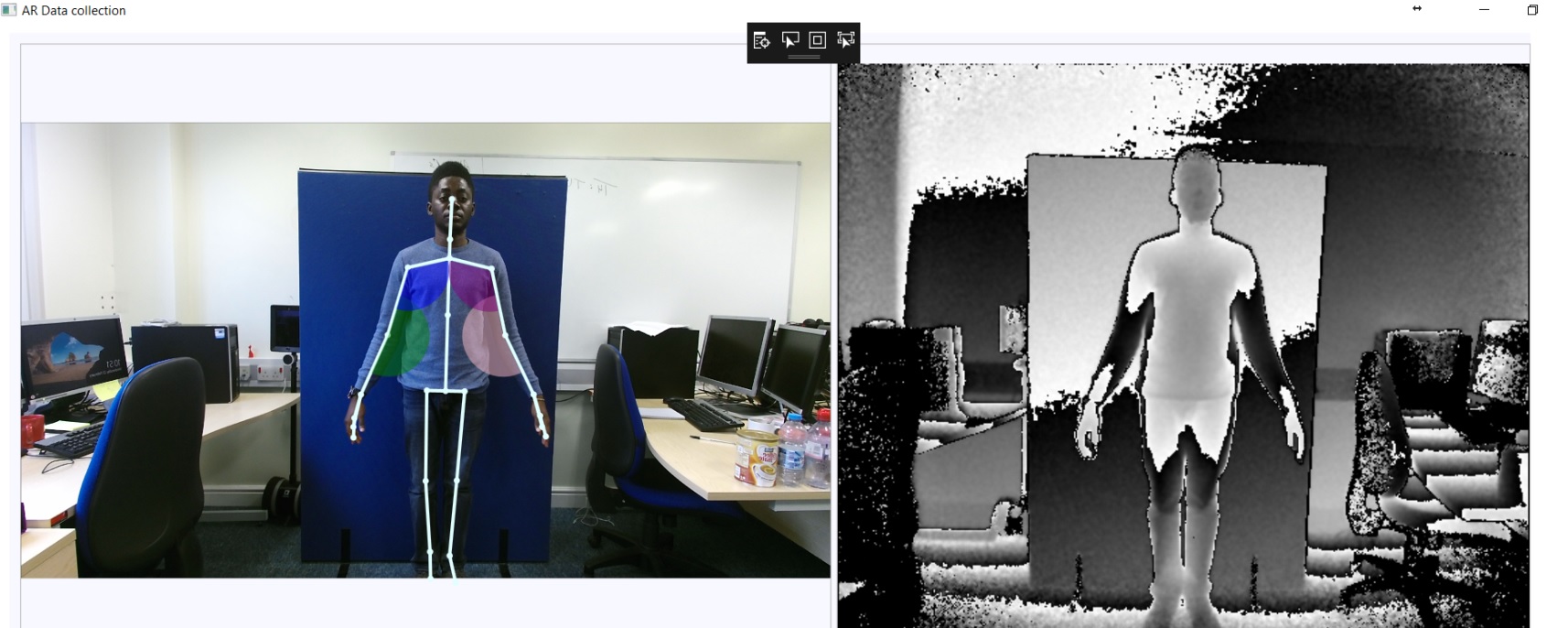

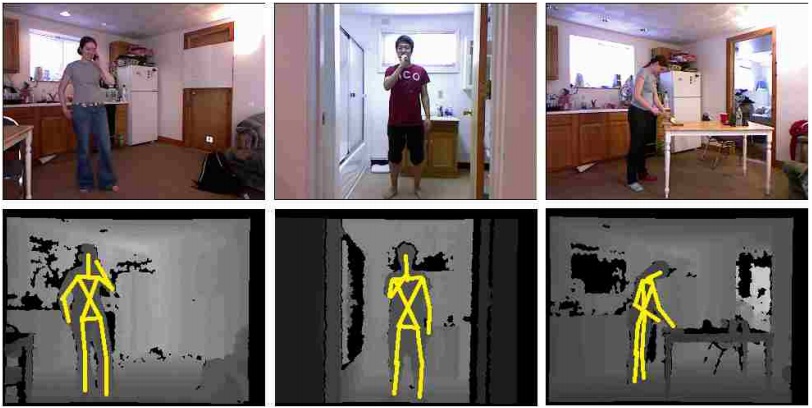

图2展示了从RGB-D传感器提取的RGB和深度图像帧示例。一旦获得原始关节点位置信息,必须从此数据中提取重要特征,然后将其分类到不同的活动中。

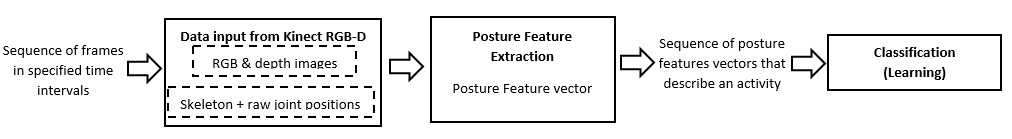

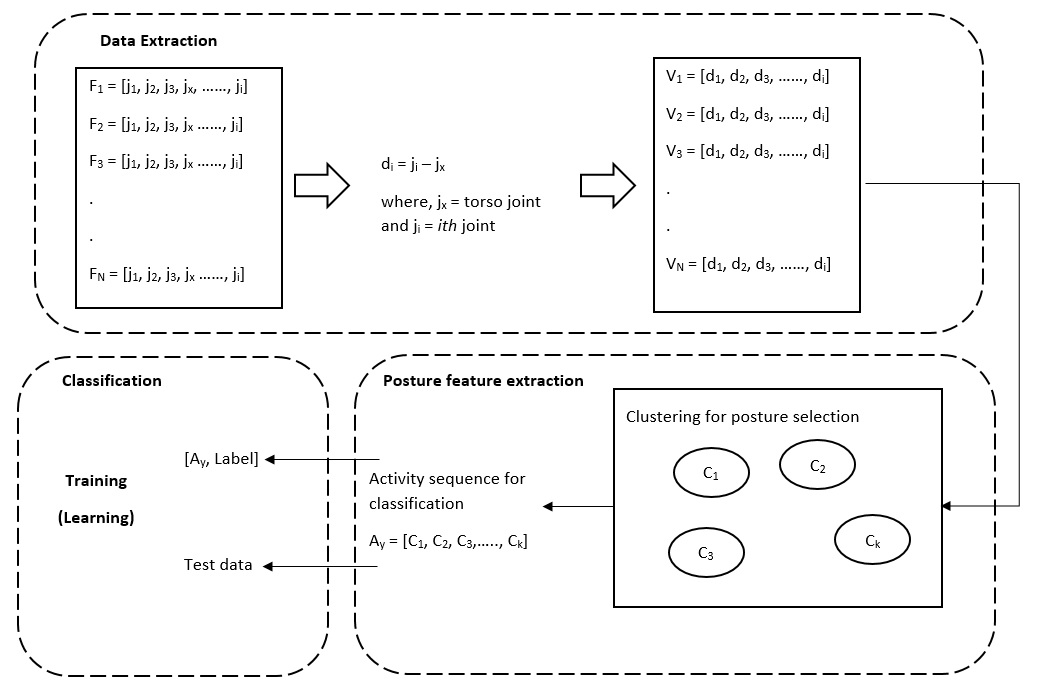

图3展示了所提出的系统架构。以下是确定的关键步骤;

3.1 姿态特征提取

姿态特征提取是我们在活动识别系统中的关键步骤。活动识别系统中获取的特征可以通过从RGB-D传感器骨骼数据中提取的关节位置坐标来计算。这种方法是研究人员采用的最简单方法之一。在考虑时序和空间数据时,可以应用两种方法,即基于原始关节点位置和基于位移的表示方法。

e提出的系统采用了一种利用骨骼关节坐标位移特征的方法。然而,为了使系统独立于运动速度,将排除时间信息。该方法由[2]引入。对于每一帧骨骼数据,使用一个向量 FN来表示在三维空间中关节j i的姿态,其中N是如图4所示的某项活动的帧(或观测)编号。e Kinect RGB-D传感器将传感器本身视为骨骼的参考坐标系。然而,为了补偿骨骼的位置,所有关节的参考坐标系将相对于躯干关节坐标来考虑。

考虑一个具有i个关节的骨架,其中jx表示躯干坐标。第ith个关节与躯干(参考点)之间的距离向量di由以下公式给出:

$$

di = j_i - j_x \quad (1)

$$

在计算一个活动帧中所有关节的距离di后,得到一个向量V,该向量表示相对于躯干的关节位置距离集合。每个向量V代表一个骨骼帧的姿态。为所有帧获取的一组VN向量表示一个活动。这一过程如图4所示。

$$

V_N = (d_1, d_2, d_3, …, d_i) \quad (2)

$$

我们提出的方法应用K-means聚类技术来选择代表活动的关键人体姿态,从而降低大型活动数据集的复杂性。该技术用于通过姿态子集表示一个活动,而无需使用所有观测值。VN向量表示活动的帧,基于平方欧氏距离作为度量,被分组到K个聚类中。

对于由VN个向量组成的活动,定义K个聚类来表示该活动的关键姿势。一个聚类CK是对该活动中各帧内紧密相关的关节位置分量(关节坐标)的分组。计算完成后,得到输出的K个聚类[C1,C2,C3,…,CK]。每个聚类是一个向量,包含定义活动中某一关键姿势的所有关节点的质心。一旦形成聚类,便根据聚类元素在活动过程中的出现顺序进行排序。e 聚类算法提供活动内每个观测值所属聚类的ID。所得聚类向量的序列代表构成该执行活动的观测值序列。e 每个聚类的质心代表关键姿势,是活动最重要的特征。ese 特征构成活动特征向量A。

$$

A = [C_1, C_2, C_3, …, C_K] \quad (3)

$$

例如,考虑一个用10个观测值和3个聚类表示的活动,在应用K-means聚类后,其中一个输出a将是代表该活动的聚类ID序列:[2, 2, 1, 1, 1, 1, 3, 3, 3, 1],这表示前两个观测值属于聚类2,第三到第六个观测值属于聚类1,第七到第九个观测值属于聚类3,第十个观测值属于聚类1。因此,该活动特征向量将为A=[C2,C1,C3,C1]。

在提出的方法中使用K-means聚类算法的一个挑战是获得能够有效表示活动姿态特征的最佳聚类数量。鉴于这一点,我们使用不同的聚类数量CK进行实验,其中K=(5, 10, 15, 20, 25, 30),并比较结果。 e 结果通过最小化误差Z来评估,该误差是针对一个活动的帧序列中各聚类的质心与实际关节点位置之间偏差的总和。

$$

Z = \sum_{n=1}^{N} |C_{k,n} - i,n| \quad (4)

$$

其中i表示第ith个关节,Ck,n表示在第nth次观测/帧中聚类k的质心,而 i,n表示第i个关节在第n帧时的位置。

3.2 活动分类

对活动特征向量进行分类计算,以将每个提取的特征向量与执行的正确活动相关联。

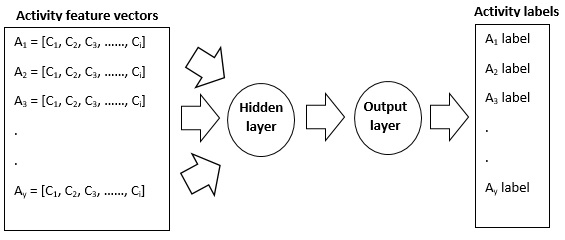

为了实现人类活动分类的任务,可以应用机器学习分类算法。其中一种算法是经过训练的人工神经网络分类器(ANN)。所提出的系统采用了一种包含隐藏层的人工神经网络算法,用于人类活动的分类。本文所采用的人工神经网络分类算法的详细信息可参见[15]。在训练分类器时,将通过聚类获得的描述执行活动的特征向量作为输入,将活动标签作为人工神经网络的目标输出。在此过程中进行一种迭代学习过程,这是人工神经网络的关键特性,在此过程中所有神经元的权重被调整,以从输入的活动特征向量中预测出正确活动标签。人工神经网络分类的结构如图5所示。

e 输入到隐层神经元的是提取的活动特征向量A和权重 wi经过激活函数后的总和。在初始迭代时,权重是随机选择的,随后在网络训练过程中,根据每次迭代传播的误差,通过连续迭代进行调整。e 误差是活动的实际输出标签与每次迭代的预测值之间的差值,并在每次迭代中进行计算。

4 实验结果与讨论

提出的基于活动识别的学习方法在著名的人类活动数据集 CAD-60数据集上进行了测试。数据是使用Microsoft Kinect RGB-D传感器提取的,包含执行人类活动序列的 RGB帧以及深度信息。

CAD-60数据集以传感器提供的15fps帧率采集,包含四人执行的12种活动。然而,在测试所提出的系统时,从12种活动中选出了6种活动,分别为; (1) 刷牙 (2) 烹饪‐切菜 (3) 烹饪‐搅拌 (4) 打开药瓶 (5) 打电话 (6) 在黑板上书写

所选活动基于使用能够执行这些活动的辅助机器人进行学习的提议系统的应用类型。因此,仅选择执行时需要手臂更多参与的活动进行测试。这些活动的选定帧如图6所示。

对于姿态特征提取,关节点位置的提取遵循第3.1节中所述的过程。然而,在计算最能代表活动特征向量的最优聚类数时,测试了从5到30个不同数量的聚类。使用25和30个聚类获得了最佳结果。为了说明这一点,图8展示了在一次刷牙活动序列中,一个关节分量(右手x坐标)的聚类中心和关节点位置的示意图。brushing teeth选择该关节位置是因为它是在执行该活动时最重要的分量之一。

聚类后,活动特征向量通过使用具有10个隐藏神经元的 ANN分类算法的训练过程与对应的活动相关联。为了评估我们的分类器,我们采用交叉验证方法进行测试

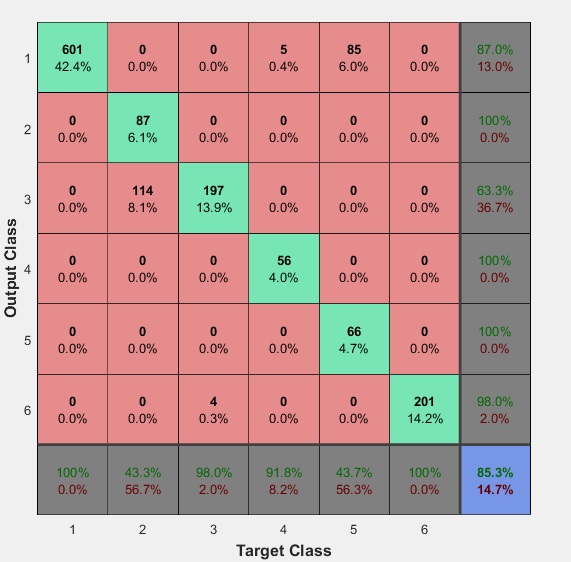

使用一个newperson数据集,该数据集未用于训练分类器。将来自newperson的包含1416个不同活动观测值的测试数据输入到已训练的网络中,得到的结果识别准确率达到85.3%,如图7 的混淆矩阵图所示。e混淆矩阵显示了来自newperson测试数据集中观测值的真正例、真负例、假正例和假负例的数量/百分比。e坐标轴表示本次测试所选择的6种活动。

在使用提取的活动特征向量对分类器进行训练和验证后,新个体测试数据的每一帧都被分类到活动特征中最接近的姿态特征向量。 e 特征向量表示姿态中紧密相关的关节组件的质心,因此输入的关节点位置帧向量可对应到该活动的特征向量。e 系统无需等待新个体活动的完整序列即可对所执行的活动进行分类。鉴于此,所提出的系统应具备实现实时性能的能力,这将在后续的研究工作中进一步探讨。

5 结论与未来工作

本文提出了一种通过聚类从RGB-D传感器获取的人体骨骼表示中提取的原始关节位置来计算活动特征向量,从而学习人类活动的方法。该方法可应用于人类辅助机器人,当检测到相应活动时,机器人能够执行这些活动。机器人可以通过将其关节与人体骨骼关节进行坐标映射来执行活动。然而,这超出了本文的范围。

e 活动分类结果表明,测试数据中的一些观测值被错误分类。这可能是由于表示活动中特定姿态的特征向量与另一活动的特征向量相似所致。 因此,未来工作的一部分是研究特征向量对不同活动的隶属程度,以便使用更复杂的计算智能方法明确地对活动进行分类。

本工作未考虑的另一个方面是执行的人类活动的时间信息,这些信息在区分不同活动的相似关节坐标位置时可能非常有用。此外,在针对特定活动选择最佳聚类数量K时,可以探索其他方法,例如使用贝叶斯信息准则(BIC)[17]来评分并选择最优的K值。这将在后续研究中予以考虑。

这种方法可用于辅助生活/老年人护理,使辅助机器人能够在生活环境中有针对性地为老年人或无法独立完成活动的人执行大多数日常生活活动(ADLs)。的结果表明,辅助机器人在人类生活环境中的共存具有非常可观的应用前景。

基于RGB-D的活动识别方法

基于RGB-D的活动识别方法

7776

7776

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?