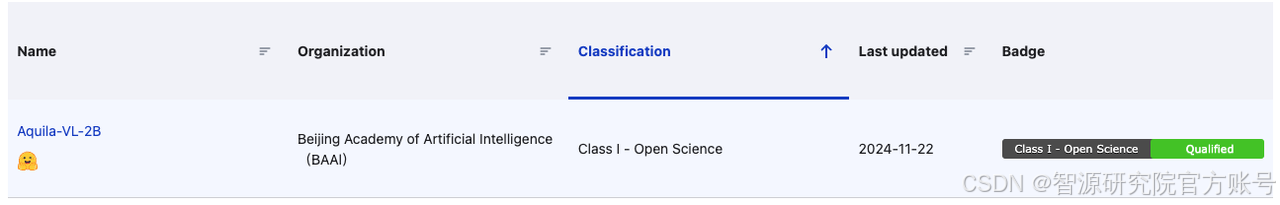

近日,由智源研究团队训练并开源的多模态模型Aquila-VL-2B通过Linux基金会模型开放性框架(Model Openness Framework, MOF)审核,作为首个达到MoF体系中Class 1开源科学标准的模型。该模型的参数、训练代码和数据等关键研究资料均以合适的开源许可证形式公开,为全球研究者提供了便捷的分析和使用途径。

图1.Aquila-VL-2B Class I认证通过截图

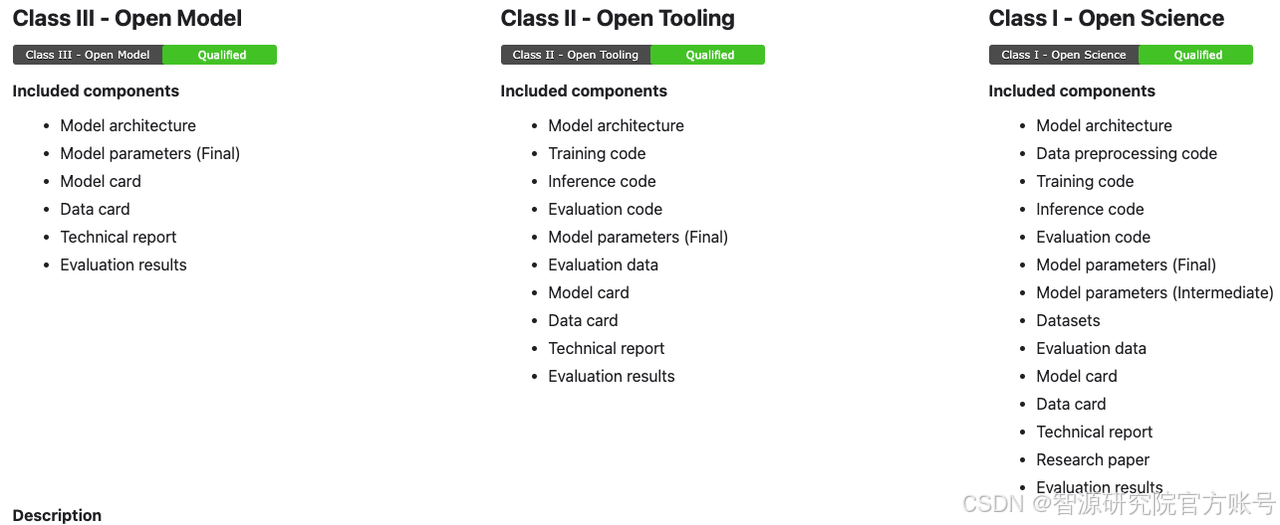

MOF(Model Openness Framework, MOF)是Linux基金会为确保AI模型的透明度、可审计性和可复现性提出的一套开源等级框架。MOF基于开放科学原则,构建了一个三层分级的分类体系,为AI模型的开放性提供了清晰的度量标准和指导方针。

MOF的三层分级体系包括:

图2.MoF开源体系介绍

-

Class I - Open Science:这一级别代表了最高标准的开放性,涵盖了模型架构、数据预处理代码、训练代码、推理代码、评估代码、模型参数(包括中间参数和最终参数)、数据集、评估数据、模型卡、数据卡、技术报告、研究论文以及评估结果。Class I 的目标是促进科学研究的透明度和协作,确保研究者能够完全访问和复现AI模型的各个方面。

-

Class II - Open Tooling:在这个级别上,除了包括Class III的所有组件外,还额外包含了训练代码、推理代码和评估代码。Class II 专注于提供完整的工具链,使开发者能够不仅理解模型的工作原理,还能够在不同的环境和应用中部署和使用这些模型。

-

Class III - Open Model:这是开放性要求的入门级别,包括模型架构、模型参数(最终参数)、模型卡、数据卡、技术报告和评估结果。Class III 的目的是为用户提供模型的基本理解和使用能力,同时保持一定的透明度和信任。

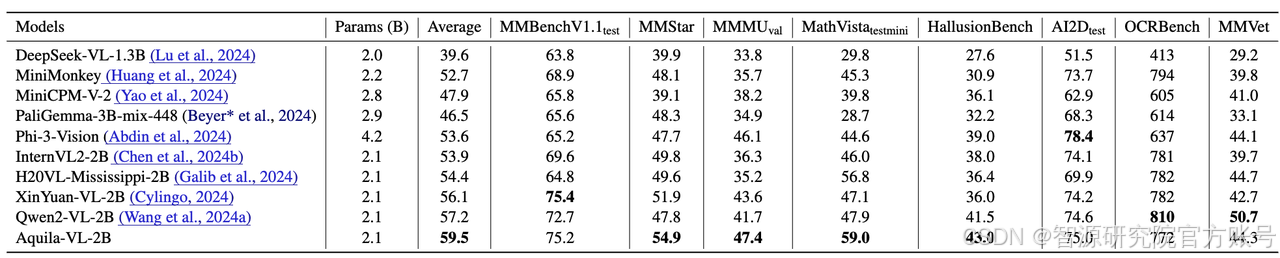

Aquila-VL-2B基于LLaVA-OneVision框架构建,采用Qwen-2.5-1.5B作为语言塔,并使用了智源团队开源的千万级多模态指令数据集Infinity-MM进行训练。这一创新设计和高质量数据的结合,使得Aquila-VL-2B在同规模模型中取得了领先的性能,如表1所示。

表1.Aquila-VL-2B在多模态榜单上的评测结果分析

表1.Aquila-VL-2B在多模态榜单上的评测结果分析

Aquila-VL-2B MOF地址:https://mot.isitopen.ai/model/1130

Aquila-VL-2B模型下载地址:https://huggingface.co/BAAI/Aquila-VL-2B-llava-qwen

Infinity-MM数据集下载地址:https://huggingface.co/datasets/BAAI/Infinity-MM

Infinity-MM数据集下载地址:https://www.modelscope.cn/datasets/BAAI/Infinity-MM

技术报告地址:https://arxiv.org/abs/2410.18558

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?