全文共5013字,预计学习时长10分钟

如果你没能亲临CVPR(IEEE国际计算机视觉与模式识别会议)的现场,无需担心。本文将列出广受关注的前十篇论文,包括深度伪造、面部识别、重建等话题。

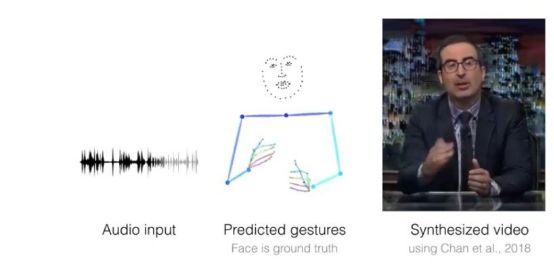

1. 学习对话姿势的个人风格(Learning Individual Styles of Conversational Gesture)

全文链接: https://www.profillic.com/paper/arxiv:1906.04160

TLDR:在输入音频演讲后,生成与声音协调的可能的姿势,并合成相应的演讲者视频。

使用的模型/架构:演讲到姿势的翻译模型。一个回旋型音频编码器降低了二维声谱图的取样频率,并将其转成一维信号。之后,翻译模型G会预测一些相应的短暂的二维姿势。真实姿势的L1回归将提供一个训练信号,同时对抗性鉴别器D会确保预测动作既保持短暂的连贯性,也符合讲话者的风格。

模型准确度:研究人员定性地将演讲到姿势的翻译结果与基准线和真实姿势顺序进行比较(作者在文中的表格显示较低的损失和新模型较高的PCK值)。

使用的数据集:通过Youtube获取演讲者特有姿势的数据集。总共有时长为144小时的视频。研究人员将数据分类,80%用于训练,10%用于佐证,剩下的10%用于测试集,因此每一段视频源只在一个集合中出现。

2. 有质感的神经性化身(Textured Neural Avatars)

全文链接:https://www.profillic.com/paper/arxiv:1905.08776

TDLR:研究员展示了用于学习全身神经性化身的系统,如深度网络,它会生成个人全身的效果图,显现多变的身体姿势和相机位置。这是从神经出发的人类化身的效果图,但并未重塑身体的几何结构。

使用的模型/架构:有质感的神经性化身的综述。输入姿势被定义为一堆“骨架”的光栅化(一条信道上有一根骨头)。完全卷积的网络(发电机)会处理输入,从而生成人体部位分配的地图堆以及人体部位协调的地图堆。这些地图堆之后会用于对人体肌理地图的取样,人体部位的协调堆规定了取样地点,并使用人体部位分配堆规定权值,制作RGB图像。除此以外,最后的人体分配地图堆与背景可能性保持一致。在学习过程中,掩码和RGB图像均需同真实情况作比较。通过在完全卷积的网络运转中、肌理上取样,所得损失进行反向传播,最终更新模型。

模型准确度:在有结构的自相似性(SSIM)方面表现优于另外两种模型,在Frechet Inception Distance(FID)方面表现比V2V突出。

使用的数据集:

· CMU全景数据集收藏的两个子集。

· 使用一套包含七个相机、横跨约30度的装备,捕捉针对三个目标的多视图序列。-从另一篇文章及Youtube视频里得来的两个短的单目序列。

3. DSFD:二元镜头面部检测器(DSFD: Dual Shot Face Detecto

本文盘点了CVPR 2019会议上的十篇热门论文,涵盖了深度伪造、面部识别、全身神经性化身等多个计算机视觉领域的研究进展。通过学习音频生成协调的姿势、全身神经性化身的系统、面部检测网络、3D面部重建等技术,揭示了计算机视觉的未来趋势。

本文盘点了CVPR 2019会议上的十篇热门论文,涵盖了深度伪造、面部识别、全身神经性化身等多个计算机视觉领域的研究进展。通过学习音频生成协调的姿势、全身神经性化身的系统、面部检测网络、3D面部重建等技术,揭示了计算机视觉的未来趋势。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

12万+

12万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?