这一节开始讲一讲神经网络中的激活函数,在讲激活函数之前,先讲一下非线性。

看一个基础知识:线性函数的叠加,我们初中学过的知识点。

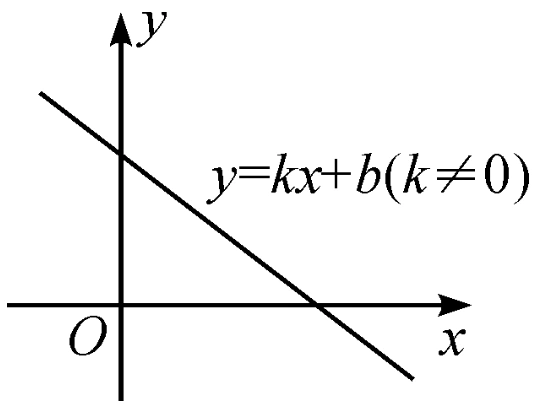

假设有一个线性函数,y = kx + b, 这个函数画出来是下面的样子,这里显示 y 和 x 是线性关系。

而如果这个时候又有一个线性关系 z = hy + d,那么,可以通过如下的线性变换,得到变量 z 和 x 同样也是线性关系。

z = hy + d

= z(kx + b) + d

= zk x + zb + d

= zk(x) + (zb + d)

令 zk = K, zb + d = B,那么 z 和 x 的关系就可以写出 z = Kx + B

所以,z 和 x 同样是线性关系。

这里想说的一个原理是:多个线性关系的叠加,还是线性关系,他不可能变成非线性关系。

回到神经网络,我们知道卷积的算法公式是 y = x * w, 其中 x 是输入数据,w 是权值,中间的 * 代表卷积计算。

那么x * w 是线性关系还是非线性关系呢?不好意思,就是线性关系。

这是因为卷积的核心计算是乘累加,这个概念我

激活函数:神经网络中的非线性关键

激活函数:神经网络中的非线性关键

本文探讨了神经网络中激活函数的重要性,强调了非线性因素如何避免模型退化为线性模型,使得多层网络能处理复杂任务。通过在卷积层后加入非线性激活层(如ReLU),神经网络可以拟合非线性系统,提升模型表现。

本文探讨了神经网络中激活函数的重要性,强调了非线性因素如何避免模型退化为线性模型,使得多层网络能处理复杂任务。通过在卷积层后加入非线性激活层(如ReLU),神经网络可以拟合非线性系统,提升模型表现。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?