前言

在选择了架构并设置了超参数后,进入训练阶段。此时,我们的目标就是找到使损失函数最小化的模型参数。有时,我们希望提取参数,以便在其他环境中复用。

某一层的参数

net=nn.Sequential(nn.Linear(4,8),nn.ReLU(),nn.Linear(8,1))

X=torch.rand(size=(2,4))

print(net[2].state_dict())

目标参数

print(net[2].bias)

print(net[2].bias.data)

一次性访问所有参数

print(*[(name,param.shape) for name,param in net.named_parameters()])

print(net.state_dict()['2.bias'].data)

嵌套块收集参数

def block1():

return nn.Sequential(nn.Linear(4,8),nn.ReLU(),

nn.Linear(8,4),nn.ReLU())

def block2():

net=nn.Sequential()

for i in range(4):

net.add_module(f'block {i}',block1())

return net

rgnet=nn.Sequential(block2(),nn.Linear(4,1))

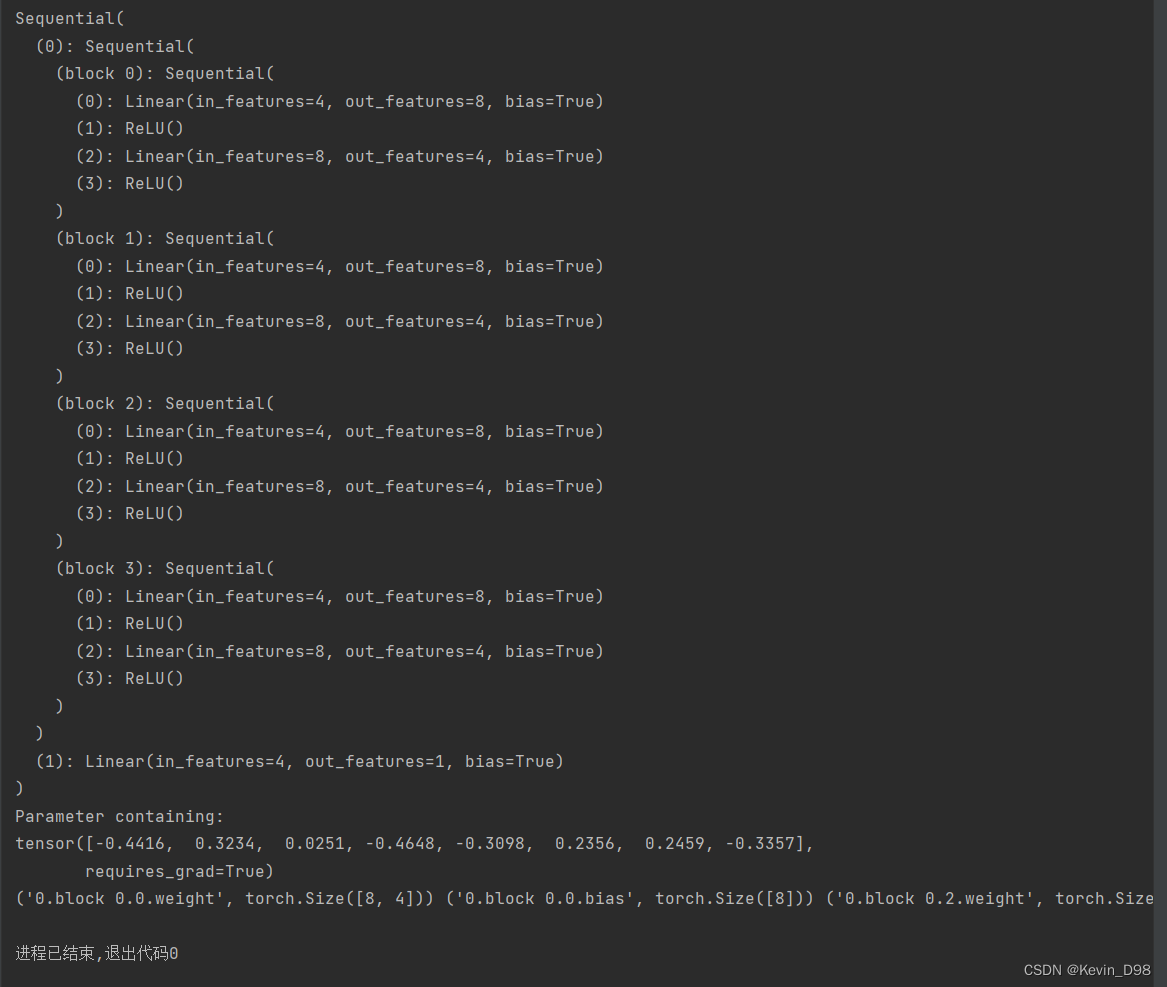

print(rgnet) # 查看网络结构

print(rgnet[0][1][0].bias) # 访问具体参数

print(*[(name,param.shape) for name,param in rgnet.named_parameters()])

本文介绍了深度学习中如何管理和访问模型参数,包括单层参数的提取,目标参数的指定,以及处理嵌套块结构时的参数收集。作者通过实例展示了如何使用`state_dict`方法和模块层次结构来操作网络参数。

本文介绍了深度学习中如何管理和访问模型参数,包括单层参数的提取,目标参数的指定,以及处理嵌套块结构时的参数收集。作者通过实例展示了如何使用`state_dict`方法和模块层次结构来操作网络参数。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?