一,Ai绘画的历史

"古典"方式的电脑自动绘画

早在20世纪70年代,艺术家哈罗德·科恩(Harold Cohen)就开始着手开发一款名为“AARON”的计算机程序,用于进行绘画创作。不同于今天的AI绘画输出数字作品,AARON能够控制机械臂在画布上作画。科恩对AARON的改进持续了几十年,直到他去世。20世纪80年代,AARON掌握了三维物体的绘制;

不过, AARON的代码没有开源, 所以其作画的细节无从知晓, 但可以猜测, ARRON只是以一种复杂的编程方式描述了作者Harold本人对绘画的理解 -- 这也是为什么ARRON经过几十年的学习迭代,最后仍然只能产生色彩艳丽的抽象派风格画作,这正是 Harold Cohen 本人的抽象色彩绘画风格. Harold用了几十年时间, 把自己对艺术的理解和表现方式通过程序指导机械臂呈现在了画布上.

The Painting Fool与早期尝试

2006年,出现了另一个类似于AARON的产品——The Painting Fool。它能够观察照片,提取颜色信息,并使用真实的绘画材料如油漆、粉彩或铅笔等进行创作。尽管这些早期的尝试已经相当先进,但它们仍然依赖于物理过程和明确的指令集。

深度神经网络基础的AI训练

在2012年 Google两位大名鼎鼎的AI大神, 吴恩达和Jef Dean进行了一场空前的试验, 联手使用1.6万个CPU训练了一个当时世界上最大的深度学习网络, 用来指导计算机画出猫脸图片. 当时他们使用了来自youtube的1000万个猫脸图片, 1.6万个CPU整整训练了3天, 最终得到的模型, 令人振奋的可以生成一个非常模糊的猫脸.

在今天看起来, 这个模型的训练效率和输出结果都不值一提. 但对于当时的AI研究领域, 这是一次具有突破意义的尝试,

在吴恩达和Jeff Dean开创性的猫脸生成模型之后, AI科学家们开始前赴后继投入到这个新的挑战性领域里. 在2014年, AI学术界提出了一个非常重要的深度学习模型, 这就是大名鼎鼎的对抗生成网络GAN (Generative Adverserial Network, GAN).

正如同其名字"对抗生成", 这个深度学习模型的核心理念是让两个内部程序 "生成器(generator)" 和"判别器(discriminator)" 互相PK平衡之后得到结果.

GAN模型一问世就风靡AI学术界, 在多个领域得到了广泛的应用. 它也随即成为了很多AI绘画模型的基础框架, 其中生成器用来生成图片, 而判别器用来判断图片质量. GAN的出现大大推动了AI绘画的发展.

但是, 用基础的GAN模型进行AI绘画也有比较明显的缺陷, 一方面是对输出结果的控制力很弱, 容易产生随机图像, 而AI艺术家的输出应该是稳定的. 另外一个问题是生成图像的分辨率比较低.

分辨率的问题还好说, GAN在"创作"这个点上还存在一个死结, 这个结恰恰是其自身的核心特点: 根据GAN基本架构,判别器要判断产生的图像是否和已经提供给判别器的其他图像是同一个类别的, 这就决定了在最好的情况下, 输出的图像也就是对现有作品的模仿, 而不是创新......

Google的探索

2017Google开发了高级滤镜的图像生成工具,以及利用千张手绘简笔画图片训练的一个模型, AI通过训练能够绘制一些简笔画. (Google, 《A Neural Representation of Sketch Drawings》)

这个模型之所以受到广泛关注有一个原因, Google把相关源代码开源了, 因此第三方开发者可以基于该模型开发有趣的AI简笔画应用. 一个在线应用叫做 “Draw Together with a Neural Network” ,随意画几笔,AI就可以自动帮你补充完整个图形.

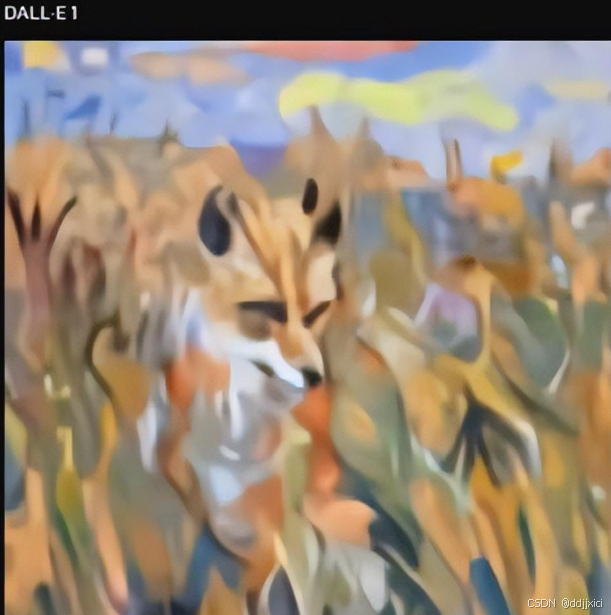

一直到2021年初, OpenAI发布了广受关注的DALL-E系统, 其AI绘画的水平也就一般, 下面是DALL-E画一只狐狸的结果, 勉强可以辨别.

但值得注意的是, 到了DALL-E这里, AI开始拥有了一个重要的能力, 那就是可以按照文字输入提示来进行创作了!

突飞猛进的时刻-Clip的运用

OpenAI团队, 在2021年1月开源了新的深度学习模型 CLIP(Contrastive Language-Image Pre-Training). 一个当今最先进的图像分类人工智能.

CLIP训练AI同时做了两个事情, 一个是自然语言理解, 一个是计算机视觉分析. 它被设计成一个有特定用途的能力强大的工具, 那就是做通用的图像分类, CLIP可以决定图像和文字提示的对应程度, 比如把猫的图像和"猫"这个词完全匹配起来.

关键的地方来了, 其实呢, 之前也有人尝试过训练"文字-图像" 匹配的模型, 但CLIP最大的不同是, 它搜刮了40亿个"文本-图像"训练数据! 通过这天量的数据, 再砸入让人咂舌的昂贵训练时间, CLIP模型终于修成正果.

西班牙玩家@RiversHaveWings在此基础上发布了CLIP+VQGAN的版本和教程, 这个版本通过Twitter被广为转发传播, 引起了AI研究界和爱好者们的高度关注. 而这个ID背后, 正是现在所被熟知的计算机数据科学家 Katherine Crowson.

在之前,类似VQ-GAN这样的生成工具在对大量图像进行训练后,可以合成类似的新图像,然而,如读者还有印象, 前面说过, GANs类型的模型本身并不能通过文字提示生成新图像, 也不擅长创作出全新的图像内容.

而把CLIP嫁接到GAN上去生成图像, 这其中的思路倒也简单明了:

既然利用CLIP可以计算出任意一串文字和哪些图像特征值相匹配, 那只要把这个匹配验证过程链接到负责生成图像的AI模型 (比如这里是VQ-GAN), , 负责生成图像的模型反过来推导一个产生合适图像特征值, 能通过匹配验证的图像, 不就得到一幅符合文字描述的作品了吗?

一个原因是CLIP+VQGAN 模型所用到的图像生成部分, 即GAN类模型的生成结果始终不尽如人意.

AI人员注意到了另外一种图像生成方式.

如果复习一下GAN模型的工作原理, 其图像输出是内部生成器和判断器的PK妥协结果.

但还有另外一种思路, 那就是Diffusion模型(扩散化模型).

Diffusion这个词也很高大上, 但基本原理说出来大家都能理解, 其实就是"去噪点". 对, 就是我们熟悉的手机拍照(特别是夜景拍照)的自动降噪功能. 如果把这个去噪点的计算过程反复进行, 在极端的情况下, 是不是可能把一个完全是噪声的图片还原为一个清晰的图片呢?

Diffusion扩散化模型目前在计算机视觉领域的影响力越来越大,它能够高效合成视觉数据,图

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?