1.一般的神经网路训练数据,最一般的训练方法就是把数据直接放到神经网络中去训练,这样消耗的资源会很大 。so

2.SGD(梯度下降法)其原理就是把数据分成一小块,然后放到神经网络中去学习。虽然说是批量处理,但是最后的准确率也还行。

3.若还是不满意,

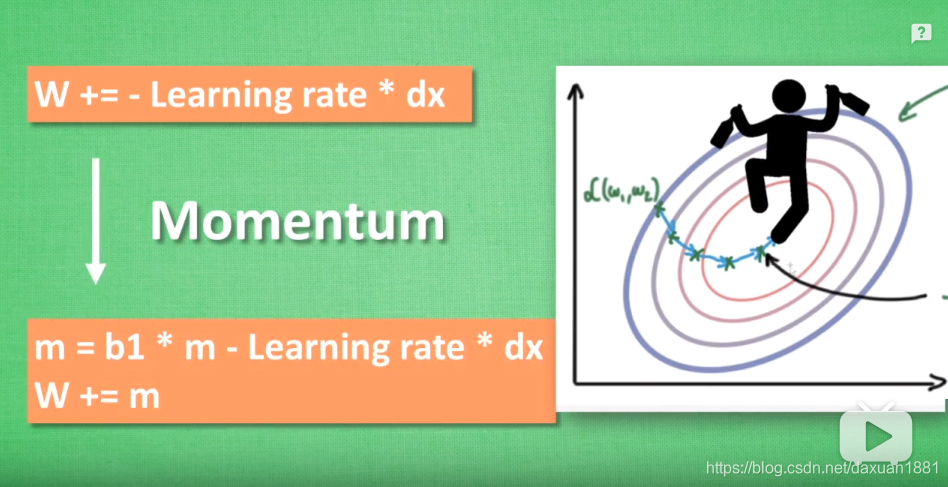

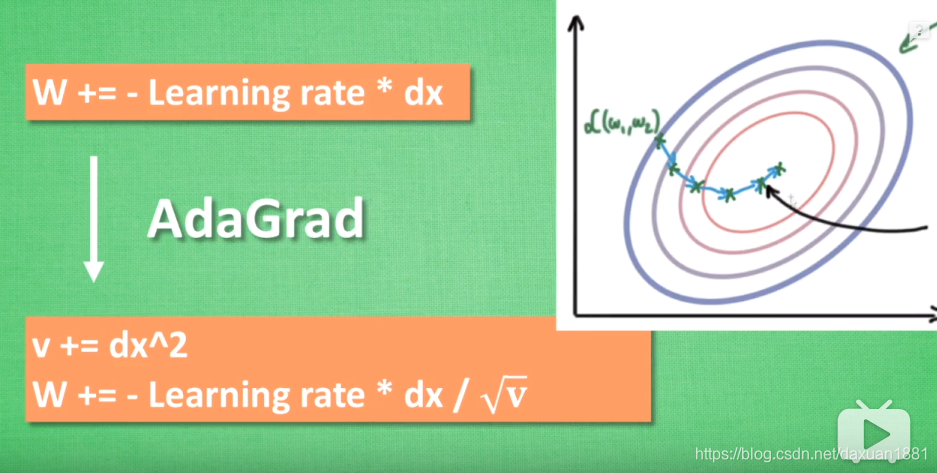

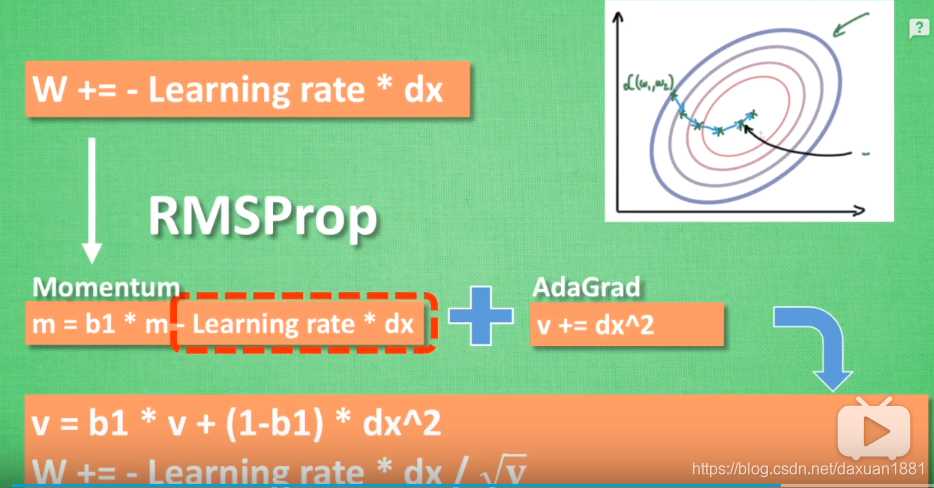

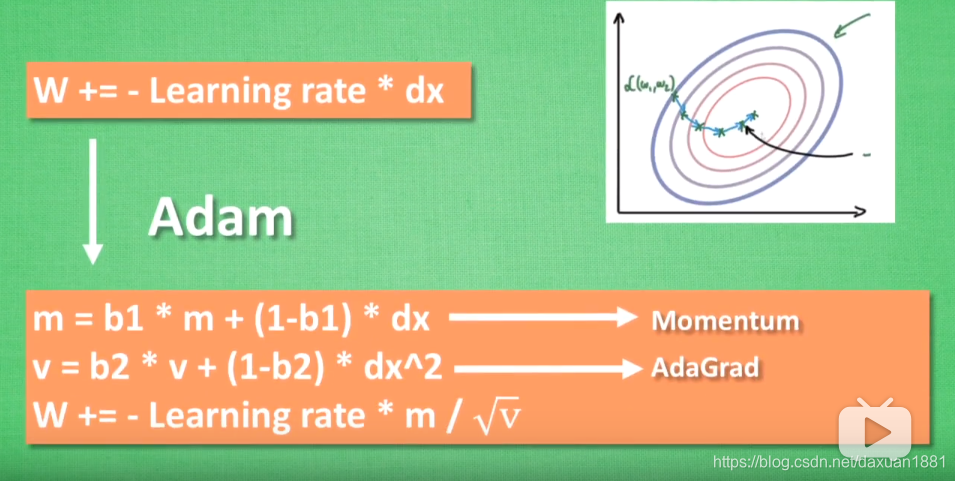

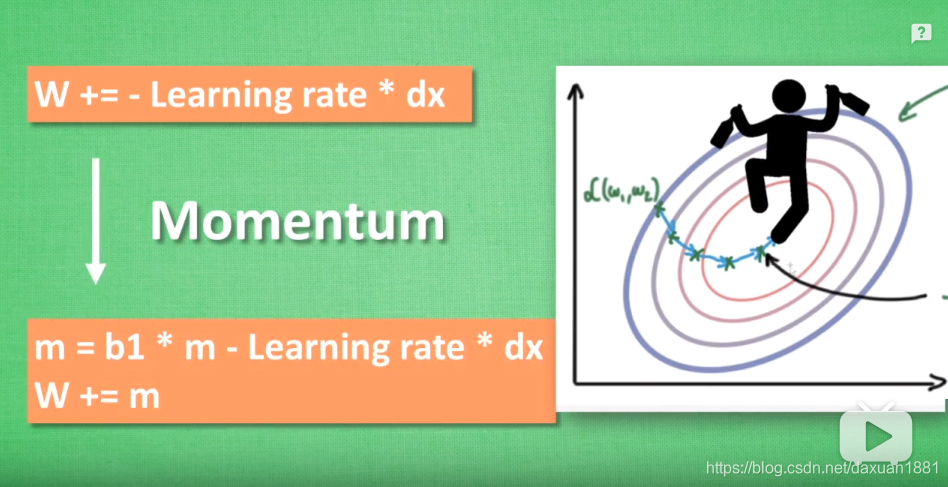

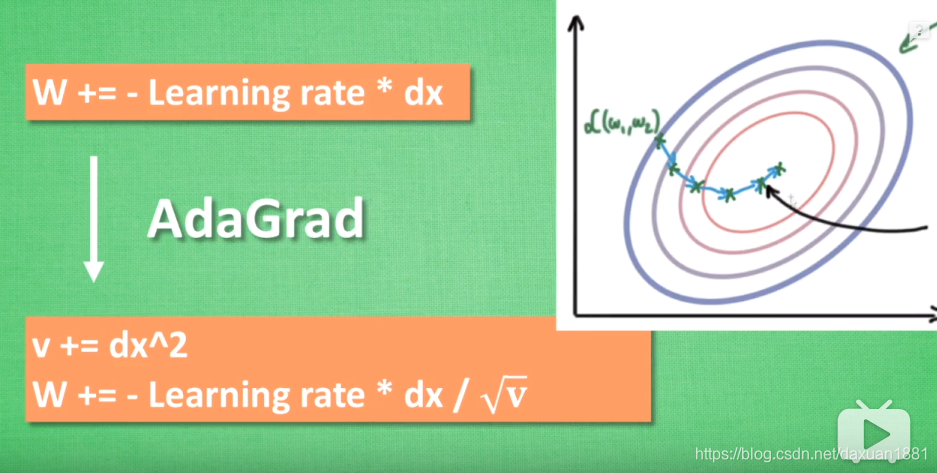

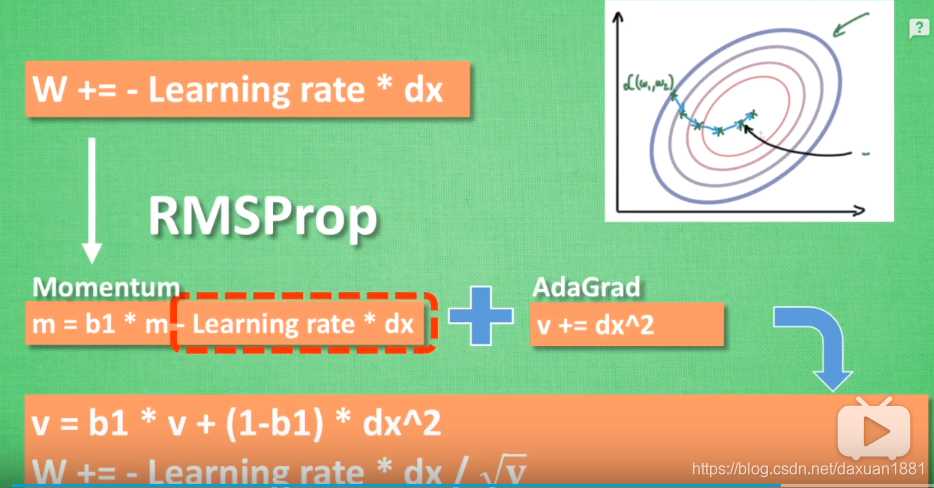

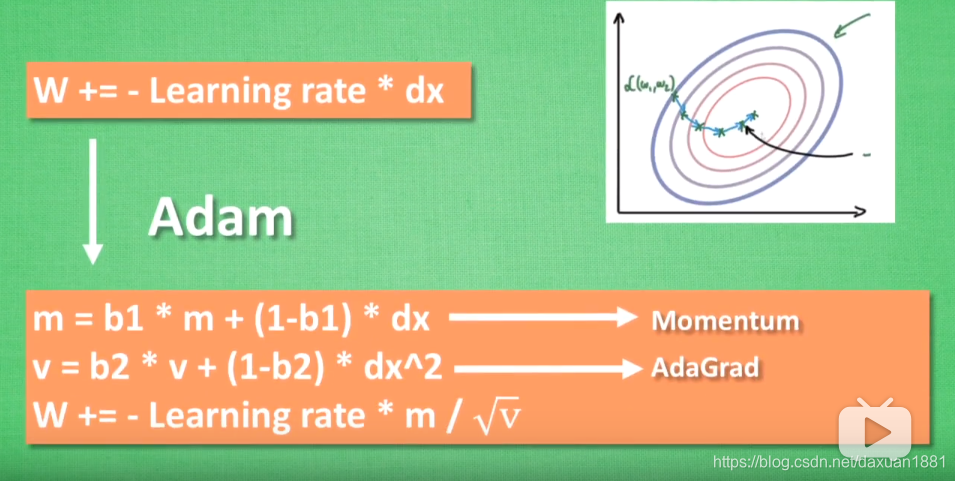

4.在学习率上动手脚:

5.

1.一般的神经网路训练数据,最一般的训练方法就是把数据直接放到神经网络中去训练,这样消耗的资源会很大 。so

2.SGD(梯度下降法)其原理就是把数据分成一小块,然后放到神经网络中去学习。虽然说是批量处理,但是最后的准确率也还行。

3.若还是不满意,

4.在学习率上动手脚:

5.

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?