https://www.bilibili.com/video/BV1jh41187Qq/?from=search&seid=13828532683994909740&spm_id_from=333.337.0.0&vd_source=de203b26ba8599fca1d56a5ac83a051c参考上述视频

一、总体

Attention机制就是注意力机制。

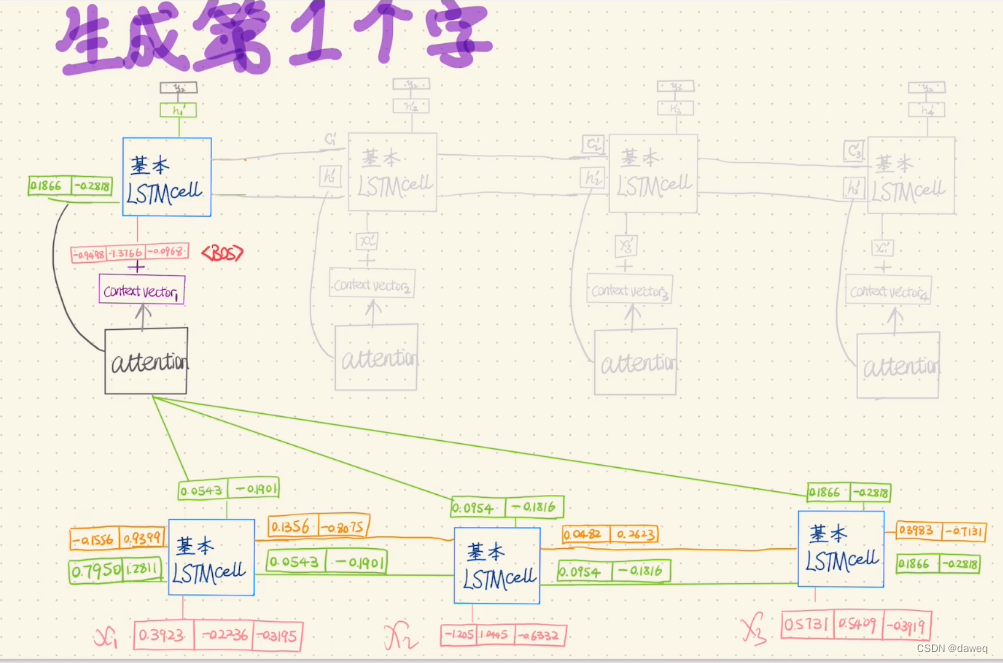

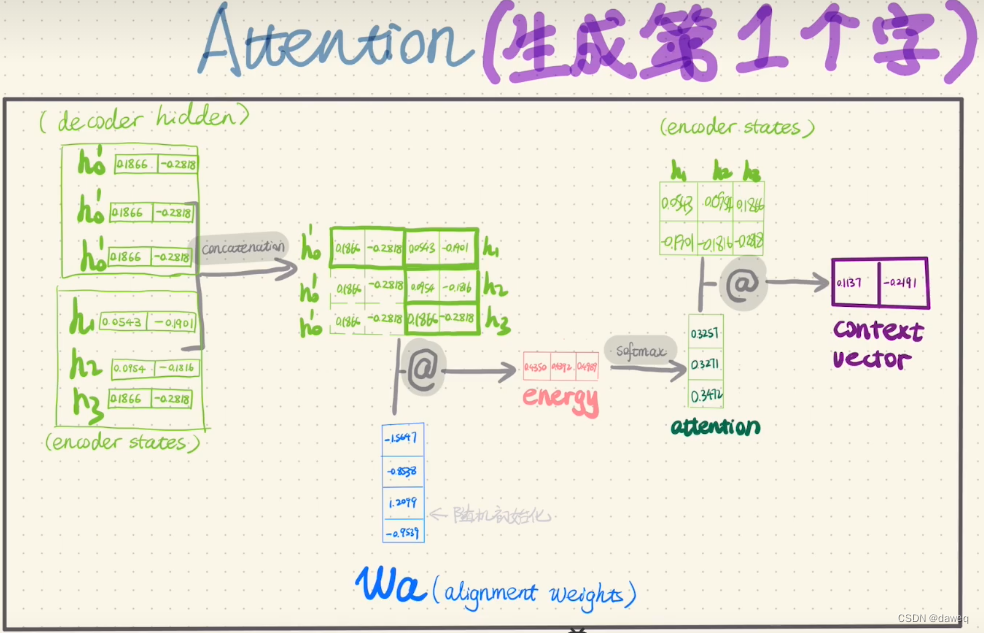

在翻译系统中使用LSTM,假如使用其来分析一个句子,如果这个句子被拆分成3个词向量,那么在LSTM中,会输出3个h矩阵。

这里将三个h矩阵输入Attetion模块中去计算,会输出一个context vector矩阵。

二、Attetion模块的具体使用

具体来说,Attention就是要确定哪一个词对于这一句话的生成(翻译)等最重要,这对于处理长句子是非常有用处的。

Attention机制是用于处理序列数据的一种方法,尤其在翻译系统中。通过LSTM分析句子产生的词向量,Attention模块确定每个词对句子生成的重要性,生成contextvector,这对于处理长句子的翻译非常有效。

Attention机制是用于处理序列数据的一种方法,尤其在翻译系统中。通过LSTM分析句子产生的词向量,Attention模块确定每个词对句子生成的重要性,生成contextvector,这对于处理长句子的翻译非常有效。

1553

1553

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?