针对pyspark的dataframe可以利用aggregation进行统计计算,而默认的算子目前只有sum, avg, max, min, count, approx_distinct_count。这对于需要利用pyspark开发类似于Kibana这样的数据分析平台的开发人员来说是个头疼的问题。

好消息是,pyspark的dataframe和SQL一样,自带了UDF(User self-Defined Fuction)功能,然而这对于Scala而言是一个极好的功能,有多重TYPE进行处理。但是对于Python而言,还是缺少了很多实用的东西,可以说是一个阉割版。

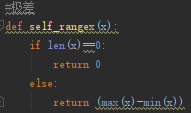

首先,我们来看一下最普通的定义一个udf的步骤,我们以定义极差函数(rangex)为例:

![]()

![]()

先是自定义一个非常普通的函数,然后使用udf把它注册一下。

然后下面是使用方式:

![]()

这里,就开始比较麻烦了,由于无法像Scala那样直接@pandaudf定义一个groupby后可以直接agg的函数,所以必须使用collect_list把所有数据变成list,然后使用withColumn间接调用我们自定义的udf。

这是第一个坑,接下来第二个坑是:一次只能使用一个udf,如果你想对dataframe中的多个字段使用不同的udf,那么不好意思,你只能分别调用,然后通过groupby的key进行拼接。

接下来的坑比较隐蔽,那就是numpy库会在udf里面失效。。。

尝试过多次以后,不得不放弃numpy,许多便捷的统计函数只能自己重写。目前具体原因还没有搞清楚,但至少利用python自带的函数重写需要的统计方法后,可以正常使用,而一旦使用numpy就会报错。当然,后续发现math这个库的函数仍可以使用,所以,对于一些复杂计算而言,这还是个好消息。但具体为啥math能用,numpy就出问题,还没有搞清楚。

1095

1095

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?