1 开发环境:

Centos6.0 ,Scrapy,Python3.6,Mongodb3.6,Pycharm

2.安装Scrapy,首先需要安装Lxml,twisted,Pywin32 --一定要下对应版本。

可参考:https://blog.youkuaiyun.com/dvivily/article/details/81325337

3.Scrapy的介绍:

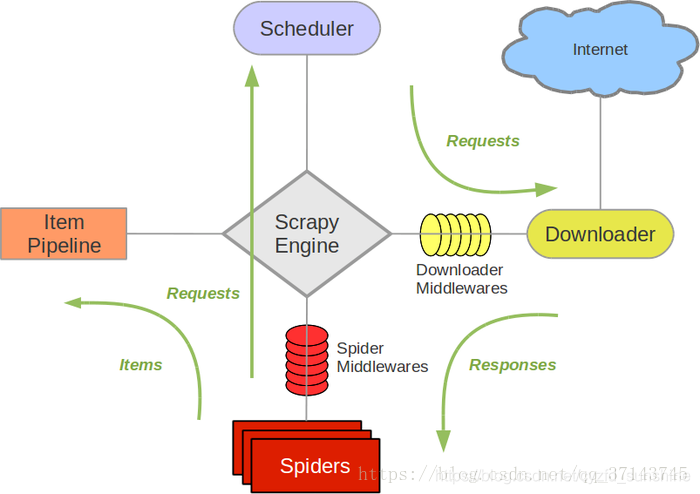

Scrapy:是一套基于Twisted的异步处理框架,是纯python实现的爬虫框架,用户只需要定制开发几个模块就可以轻松的实现一个爬虫,用于爬取网页内容或者各种图片。

图表参考:https://blog.youkuaiyun.com/qq_37143745/article/details/80996707

简单叙述一下每层图的含义吧:

Spiders(爬虫):它负责处理所有Responses,从中分析提取数据,获取Item字段需要的数据,并将需要跟进的URL提交给引擎,再次进入Scheduler(调度器)

Engine(引擎):负责Spider、ItemPipeline、Downloader、Scheduler中间的通讯,信号、数据传递等。

Scheduler(调度器):它负责接受引擎发送过来的Request请求,并按照一定的方式进行整理排列,入队,当引擎需要时,交还给引擎。

Downloader(下载器):负责下载Scrapy Engine(引擎)发送的所有Requests请求,并将其获取到的Responses交还给Scrapy Engine(引擎),由引擎交给Spider来处理

ItemPipeline(管道):它负责处理Spider中获取到的Item,并进行进行后期处理(详细分析、过滤、存储等)的地方.

Downloader Middlewares(下载中间件):你可以当作是一个可以自定义扩展下载功能的组件。

Spider Middlewares(Spider中间件):你可以理解为是一个可以自定扩展和操作引擎和Spider中间

通信的功能组件(比如进入Spider的Responses;和从Spider出去的Requests)

4.Mongodb的安装

参考这位大哥的文章:https://blog.youkuaiyun.com/qq_37251696/article/details/83187927

5.Scrapy项目实践

5.1Scrapy抓取4步走

新建项目

明确目标

制作爬虫

存储内容

感谢这位大神的:https://blog.youkuaiyun.com/pleasecallmewhy/article/details/19642329

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?