作者: 18届cyl

日期:2021-08-14

论文:《‘Anchors’ High-Precision Model-Agnostic Explanations》

期刊:AAAI

一、简单介绍

之前讲到过,LIME的主要思路是在一个复杂的模型的局部提出一个简单地可解释地模型(Explainer),以提升整个复杂模型的可解释性。

原作者为了改进LIME中的一些缺点,于2018年又设计了Anchors也就是这篇文章。

Anchors是LIME的改进版,也是一种local的方法,会将特征和输出简化成IF-Then形式。简单来说,就是能找到特征里面的一个小子集,只要出现这个特征子集,那么这个预测结果总是相同。

二、问题陈述

1.可解释的机器学习开始盛行,也涌现出了很多全局可解释的模型(global)和 局部解释的方法(local)。

2.大多数局部local的方法是通过线性模型去模拟得出特征的相对重要性,比如LIME。

3.但是线性模型的适用范围是不确定的。

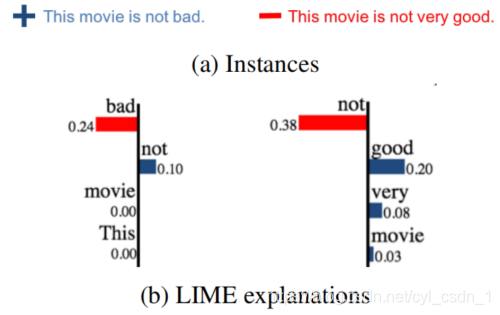

上图表示的是文本分类中,LIME对两个实例预测结果的解释。蓝色表示positive,红色表示negative。

观察发现,第一句中“not"对于原始模型给出“positive"的判断也就是蓝色的判断起正向作用,而第二句not则是负向作用。LIME对这两句的分析都是准确的,但是用户无法根据这些分析来预测模型之后的行为,因为用户无法知道not具体在何时是使模型得到positiv

Anchors是LIME的改进版,提供了一种模型无关的、基于规则的局部解释方法,特别是在文本分类、结构化预测和图像识别等领域。Anchors寻找特征子集形成IF-Then规则,确保在满足规则条件下,预测结果高度一致。算法通过多臂老虎机(MAB)策略估算精度,并使用beam search优化覆盖率,旨在生成易于理解和有效的解释。尽管需要设置参数,但Anchors在处理非线性和复杂模型预测时表现出优势。

Anchors是LIME的改进版,提供了一种模型无关的、基于规则的局部解释方法,特别是在文本分类、结构化预测和图像识别等领域。Anchors寻找特征子集形成IF-Then规则,确保在满足规则条件下,预测结果高度一致。算法通过多臂老虎机(MAB)策略估算精度,并使用beam search优化覆盖率,旨在生成易于理解和有效的解释。尽管需要设置参数,但Anchors在处理非线性和复杂模型预测时表现出优势。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3339

3339

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?