译者 | 弯月 责编 | 张文

头图 | 优快云 下载自视觉中国

出品 | 优快云(ID:优快云news)

以下为译文:

科技垄断有关的话题,相信大家都不陌生,而纵向垄断指的是通过技术栈深入到硬件的纵向集成。在本文中,我们来讨论一下为什么当下科技垄断开始朝着纵向发展,这种垄断会产生哪些影响,以及各大平台在这种垄断中的定位。

摩尔定律失效

有人说:“如果你欠银行500块钱,那么你会为此发愁;但是如果你欠银行5亿,那就该银行发愁了。” 当前的某些技术垄断企业就在反客为主,他们与供应商之间的关系正在发生变化。随着软件企业在计算领域中的地位节节攀升,硬件发展的幕后推手已经由半导体公司变成了科技公司。软件彻底吞噬了整个世界,如今的科技巨头都开始向技术栈底层的硬件渗透。而英特尔等公司则开始落后。

当前,没有任何一家公司拥有绝对的计算主导权,并将其作为服务出售。甚至在巅峰时期的 IBM 也仅出售 PC 和大型机,而未能像基础设施即服务(Infrastructure as a Service,即IaaS)的提供商那样分解计算单元。随着摩尔定律的失效,人工智能对计算的需求猛增,各大公司也开始意识到这个问题。

FOSSi Foundation 的某个视频中就曾给出一些有趣的警告:

我们对计算能力的需求仍在持续增长,而且呈指数级增长。

过去,我们可以依靠摩尔定律解决这个问题,通过不断提高计算能力,满足不断增长的计算需求。但如今情况已发生了变化。在 Google,我们的很多项目都在努力解决这个问题,我个人也沉迷其中。我从事的项目 TPU 算不上最成功的项目,这是一个机器学习的加速器,可以极大地提高机器学习的计算能力。在项目的进行过程中,我们发现硬件可以满足不断增长的计算需求。然而,问题在于创建这些硬件加速器需要花费很多精力,Google 的部分团队非常强大,比如机器学习人员拥有专门的团队来研发硬件,例如 TPUum 等。最终可能 Google 的每个团队都需要加速工作负载的硬件,尤其是在需求持续增长的情况下。

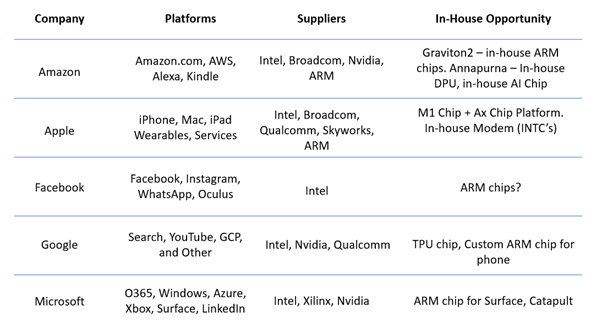

很显然,如今全球许多科技公司都在考虑这个问题。在今年短短几个月内,我们看到了苹果的 M1 芯片、AWS 的 Graviton、Azure 的 Catapult,甚至有传闻说 Facebook 也准备启动自家的芯片平台。似乎这种纵向发展已势不可挡。

不难想象,在未来几年内,科技巨头将纷纷关注硬件集成水平。也许很快我们就能看到商品化的平台,这些平台部分运行在开放的技术栈之上,但各个平台之间的差别将不仅限于软件,还包括硬件。而整个计算机世界将重回软件与硬件集成一体化的旧模式。

在这种发展趋势下,如果某家公司跟不上时代发展的脚步,那么他们将不得不面对呈指数级增长的 AI 计算成本,而且潜在的竞争对手也将面临新的门槛。而科技巨头构建的护城河周围的利润也将进一步攀升,他们能够以低于竞争对手的价格销售产品,同时还能获得巨额利润。

下面,我们来看看各个科技巨头的计划。

苹果

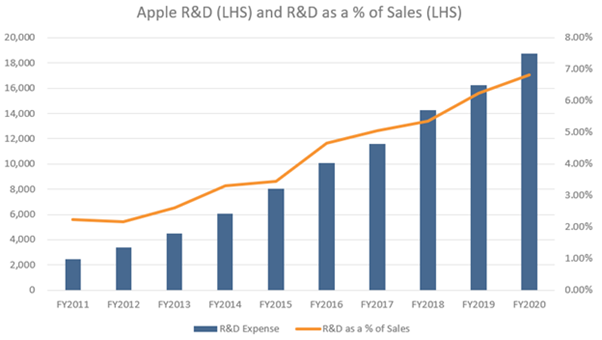

我们可以看到,苹果率先迈出了纵向整合的第一步。人们可能一直在质疑:“苹果的研发资金都去哪儿了?”如今很明显,这部分资金都流向了苹果内部的半导体技术。

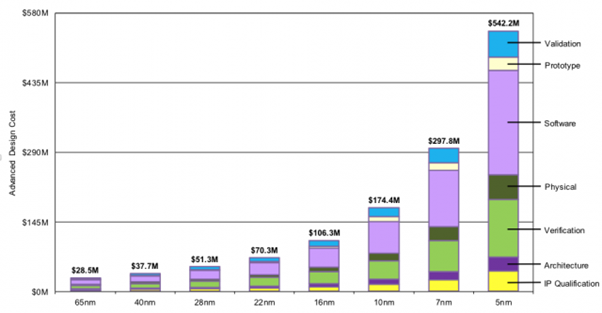

曾有传闻说苹果的研发投资都花在了眼镜或汽车上,但事实上苹果瞄准了芯片。5 纳米已经接近芯片集成的极限,但身价过万亿的苹果斥巨资实现了 5 纳米芯片。如今,苹果不仅拥有了绝对的硬件优势,可以紧密地集成到软件中,而且还可以进一步控制在苹果的生态系统中开发软件的合作伙伴,并要求他们紧密集成苹果的硬件,否则就会面临性能的问题。

最近,苹果发布的 M1 芯片不仅是快速的 CPU,而且还提供了异构计算所能提供的最佳性能,此外该芯片的电池寿命更长,能够更好地优化某些应用程序,而且对于苹果而言这款芯片的价格更便宜。苹果已稳操胜券,他们还在制造自己的智能手机调制解调器,设计新的 U1 UWB,而且随着世界范围内 Axx 手机平台的发展,苹果也会不断水涨船高。苹果的目标是有一天能够将所有技术都纳入自家,打造一座四周高墙林立的科技乐园,然后为用户提供更好更廉价的产品。

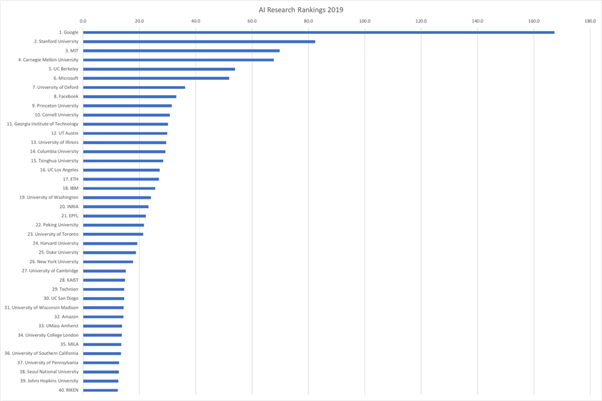

另一方面,Google 只有过一次制作芯片的大胆尝试,但他们的 TPU 却引起了轰动。Google 一直在人工智能领域处于领先地位,他们的研究数量超过世界上任何一家公司或一所大学。

TPU 是一款张量处理单元,专门为配合 Tensorflow 的使用而创建。TPU 是Google 在同时发展硬件和软件并创建由 Google 控制的端到端 AI 技术栈方面的一次尝试。如果 AI 继续发展,而且是在 Tensorflow 平台的支持下不断发展,则无论是从软件角度还是从计算的销售角度来看,Google 的地位都将不可撼动。TPU 是 Google 在围墙内打造 AI 花园的利器。由于用户只能租用云TPU,因此 Google 可以借此以软件的战略地位获利。

Google 不会止步于此,最近 Google 宣布与台积电建立合作伙伴关系,共同打造新的 SoIC,并且由于无人驾驶汽车是计算需求最大的驱动力之一,因此Google 很可能会为其子公司 Waymo 推出一系列定制芯片。还有传言称Google 将为 Pixel 手机推出新的 ARM 芯片。

亚马逊

AWS 是全球最大的 IaaS 运营商,所以毫无意外一直以来他们也在贯彻这种策略。只不过他们的策略水平较低,有些不为大众所接受。但是他们也做了大量的尝试。首先,亚马逊收购了 Annapurna 实验室,并研发了 DPU 和Graviton。从 IaaS 的角度看,亚马逊在构筑自家的围墙花园方面走得最远。Annapurna 率先推出了首批网络 DPU,而且他们成功地推出了 Graviton 芯片,并有望推出 AI 加速器。推特上有关 Graviton 的最新报道如下:

虽然云计算没有出现大幅降价,但硬件价格对 IaaS 至关重要。关键在于,客户购买的是通用计算单元,而如果 Graviton 芯片能够提供价格非常低的通用计算单元,那么客户肯定会非常满意。这将有助于 Graviton 平台的扩展,将其推向更高水平(比如 5 纳米),同时还会创造巨大的规模经济,并节省大量成本,当然这部分资金都将流入 AWS 的口袋。如今,英特尔的利润已经成了亚马逊的机会。IaaS(这个依靠大量资本运作的行业)的门槛将越来越高。

众所周知,亚马逊不仅仅是一家 IaaS 公司,最近他们将部分 Alexa 芯片从英伟达转移到了内部。随着对这部分市场的渗透,亚马逊会继续将其芯片技术带入他们涉足的每个市场。随着亚马逊从零售业扩展到医疗保健,以及其他垂直领域,他们必将构建更多有趣的平台。

微软

微软对于芯片技术的研究远比其他公司低调,直到我深入了解了 Inphi 之后才意识到,我们看到的只不过是冰山一角。微软有一个相对较新的数据中心对等策略,该策略依赖于 ColorZ,相信微软很快就会涉足芯片制作。证据之一就是微软一直在设计基于 ARM 的 surface 笔记本电脑。虽然 Wintel(Windows+Intel)联盟依然在,但微软似乎准备放弃这种合作关系了。

特别是,微软讨论最多以及定制芯片进展最快的平台就是边缘计算平台。尤其是Azure Sphere 是一个新平台,微软通过 Pluton 芯片提高了该平台的安全性,而且该平台也是一个可保证安全性和性能的基于 ARM 的生态系统。

最后还有微软的 Catapult 平台。这是一款由 Altera 负责特别设计的 FPGA 产品,专门针对灵活的网络设计(例如 DPU)。在 Azure 数据中心内,微软的Catapult 芯片有助于在整个网络中移动数据,并加速某些工作负载。展望未来,Catapult 的配置将接近传统的 DPU,这是一个刚刚起步的新兴市场。

这种模式不仅适用于 IaaS 提供商,而且适用于各个互联网巨头。作为独立云的Facebook 可能会跻身全球前十。到目前为止,Facebook 尚未宣布重大的芯片制作计划,但是根据他们的发展轨迹以及 Oculus,也许在未来几年内他们就会有新举措。

芯片制作的门槛异常高

通过上述内容,不难看出对于没有定制平台的公司来说,制造芯片有多么困难。

放眼全世界,能够拿出 5 亿美元研发资金的公司恐怕为数不多(大约 270家?),而投入的研发资金超过了 5 亿美元的公司都是科技巨头。这些公司做出这样的投资也并不奇怪,因为他们想要通过资本运作建立与其他人之间的鸿沟。上述我们提到的每一家公司在研发上的投资都超过了英特尔!甚至连我们没有讨论到的三星,也是其中之一。而这一切绝不是巧合!随着半导体技术的发展触及极限,这个行业越来越需要资金的支持,最终只留下一众处于领先地位的科技垄断企业继续这场角逐。

想象一下,你是一家出售 IaaS 的公司,就像 Digital Ocean 一样。如果你只能使用英特尔和 AMD 芯片,则最好祈祷并希望这两家公司能够健康地发展下去,因为如今你的竞争对手能够更快地制造芯片和扩展规模,甚至超过了大型半导体平台,那么最终你可能会被迫购买他们的芯片,或看着别人吃肉自己只能喝汤。虽然你可以提供相同的服务,但你无法制造自己的基础芯片,所以你的利润非常微薄。如果他们降低价格,你甚至可能会亏本!你丝毫没有竞争力。

但是我们不必着急喊“狼来了”,有一家公司对于这种形式有非常清楚的认识,而且这是一家仅次于英特尔的半导体公司,那就是英伟达。对英伟达来说,收购ARM 非常重要,尽管价格昂贵,但 ARM 会在上述我们提到的发展策略中发挥重要的作用。实际上,大多数定制产品都是基于 ARM 的,而英伟达知道这一点。英伟达将自己定位成了 AI 时代的大型独立芯片平台。就像过去的英特尔一样。无论技术平台如何向前发展,英伟达都将从中分一杯羹。如今,英伟达甚至脱离了科技巨头的技术栈,他们开始提供软件。当然,这又是另一个话题了。

这场芯片大战来势凶猛,但是很显然主要战场集中在大型软件公司之间。他们掌握了所有互联网的创新技术,而如今许多科技巨头都将推出首批最先进的芯片产品。英特尔遗留下来的空白是巨大的,每个人都意识到,制作自己的芯片并创建无法复制的端到端平台,他们就可以从中受益。

软件吞噬了整个世界,而硬件一直在努力跟上潮流。如今,大型软件公司正在逐步进军硬件,而且他们贯彻了一种综合战略,这种战略不仅需要巨额资本的运作支持,而且进入该领域的门槛也会急速升高。如今,科技巨头们都在忙着打造自家的花园,四周的高墙在缓慢上升,护城河在缓慢扩大,随着我们站在硬件复兴的风口浪尖,他们现在做出的决定都将为自己带来持久的竞争力。

评论

评论1

有一些手段可以减缓垂直垄断,我们以前也用过:

-

规范化市场(如,限制服务捆绑,比如带有定向广告的免费邮件,输入设备绑定到社交账号,为第三方广告商提供账号数据等)

-

强制要求数据或文本提供商提供标准格式,方便用户迁移到其他平台

-

禁止软硬件捆绑,或对软硬件捆绑平台与通用计算平台征收不同的税

-

强制电子商务交易用标准的格式来表示(禁止各种专用的代币流通,这对于税务部门也是问题)

随着文明数字化,这些问题并不完全是新问题,有些问题已经被金融界解决过了。只不过因为过去十年我们都被“云计算”洗脑了。

评论2

各大公司应当为人类提供福利。

如果公司对公共秩序造成威胁,就应该出台管制法规。

评论3

问题是,现在政府受到大公司商业利益的影响越来越大,而公众利益的影响越来越小。需要想办法给政客们施加压力,减少大公司的影响。

在许多国家,大公司能够以停止服务来威胁国家,因为这样做会给本地经济带来巨大的影响。

原文:https://mule.substack.com/p/the-tech-monopolies-go-vertical

本文为 优快云 翻译,转载请注明来源出处。

更多精彩推荐

☞华大基因辟谣“基因编辑58个婴儿”;苹果发布头戴式耳机AirPods Max;Debian 10.7发布|极客头条

☞被弃用的 Docker 会被 Podman 取代吗?

☞稳居TIOBE前三,涨幅No.1,Python做了什么?

☞索要 2.3 亿元赎金!富士康遭遇黑客攻击

☞马斯克与贝索斯:世界上最有钱的两人展开太空大战

☞升级版APDrawing,人脸照秒变线条肖像画,细节呈现惊人

点分享点点赞点在看

23

23

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?