摘要

本文深入探讨了DeepSeek-R1模型的元学习技术,从快速适应到少样本学习的实现方法。内容包括元学习策略、快速适应、少样本学习等核心技术,帮助读者掌握大模型元学习的实现方法。

1. 元学习概述

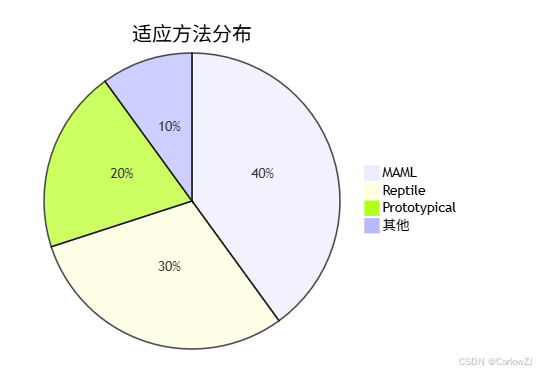

1.1 学习架构

1.2 学习策略

META_LEARNING_STRATEGIES = {

"MAML": {

"特点": ["模型无关", "快速适应", "梯度优化"],

"适用场景": "少样本学习",

"实现方式": "元优化"

},

"Reptile": {

"特点": ["简单高效", "稳定收敛", "计算友好"],

"适用场景": "快速适应",

"实现方式": "参数平均"

},

"Prototypical": {

"特点": ["原型学习", "度量学习", "分类友好"],

"适用场景": "分类任务",

"实现方式": "原型计算"

}

}

2. 元学习策略

2.1 策略流程

2.2 实现代码

class MetaLearner:

"""

元学习器

"""

def __init__(self, config):

self.config = config

self.logger = logging.getLogger(__name__)

def learn(self, model, task_distribution):

"""

元学习

"""

try:

# 任务采样

tasks = self._sample_tasks(task_distribution)

# 任务学习

learned_model = self._learn_tasks(model, tasks)

# 快速适应

adapted_model = self._adapt_model(learned_model, tasks)

return adapted_model

except Exception as e:

self.logger.error(f"元学习失败: {str(e)}")

raise

def _sample_tasks(self, distribution):

"""

任务采样

"""

# 实现任务采样逻辑

pass

def _learn_tasks(self, model, tasks):

"""

任务学习

"""

# 实现任务学习逻辑

pass

def _adapt_model(self, model, tasks):

"""

快速适应

"""

# 实现快速适应逻辑

pass

3. 快速适应

3.1 适应流程

3.2 适应实现

class FastAdapter:

"""

快速适应器

"""

def __init__(self, config):

self.config = config

self.logger = logging.getLogger(__name__)

def adapt(self, model, task):

"""

快速适应

"""

try:

# 准备数据

prepared_data = self._prepare_data(task)

# 计算梯度

gradients = self._compute_gradients(model, prepared_data)

# 更新参数

updated_model = self._update_parameters(model, gradients)

return updated_model

except Exception as e:

self.logger.error(f"快速适应失败: {str(e)}")

raise

def _prepare_data(self, task):

"""

准备数据

"""

# 实现数据准备逻辑

pass

def _compute_gradients(self, model, data):

"""

计算梯度

"""

# 实现梯度计算逻辑

pass

def _update_parameters(self, model, gradients):

"""

更新参数

"""

# 实现参数更新逻辑

pass

4. 少样本学习

4.1 学习架构

4.2 学习实现

class FewShotLearner:

"""

少样本学习器

"""

def __init__(self, config):

self.config = config

self.logger = logging.getLogger(__name__)

def learn(self, support_set, query_set):

"""

少样本学习

"""

try:

# 计算原型

prototypes = self._compute_prototypes(support_set)

# 计算距离

distances = self._compute_distances(query_set, prototypes)

# 预测分类

predictions = self._predict_classes(distances)

return predictions

except Exception as e:

self.logger.error(f"少样本学习失败: {str(e)}")

raise

def _compute_prototypes(self, support_set):

"""

计算原型

"""

# 实现原型计算逻辑

pass

def _compute_distances(self, query_set, prototypes):

"""

计算距离

"""

# 实现距离计算逻辑

pass

def _predict_classes(self, distances):

"""

预测分类

"""

# 实现分类预测逻辑

pass

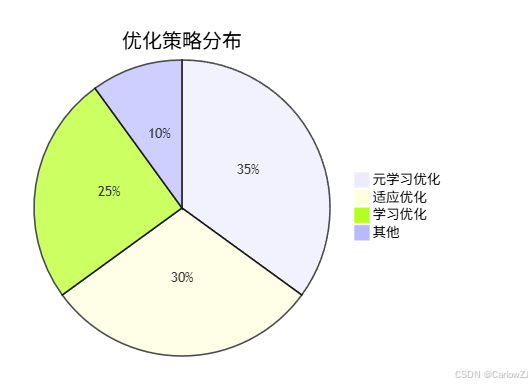

5. 性能优化

5.1 优化分布

5.2 优化实现

class PerformanceOptimizer:

"""

性能优化器

"""

def __init__(self, config):

self.config = config

self.logger = logging.getLogger(__name__)

def optimize(self, model):

"""

优化性能

"""

try:

# 优化元学习

meta_optimized = self._optimize_meta(model)

# 优化适应

adaptation_optimized = self._optimize_adaptation(meta_optimized)

# 优化学习

learning_optimized = self._optimize_learning(adaptation_optimized)

return learning_optimized

except Exception as e:

self.logger.error(f"性能优化失败: {str(e)}")

raise

def _optimize_meta(self, model):

"""

优化元学习

"""

# 实现元学习优化逻辑

pass

def _optimize_adaptation(self, model):

"""

优化适应

"""

# 实现适应优化逻辑

pass

def _optimize_learning(self, model):

"""

优化学习

"""

# 实现学习优化逻辑

pass

6. 最佳实践

6.1 学习策略

-

元学习策略

- MAML

- Reptile

- Prototypical

-

快速适应

- 梯度优化

- 参数平均

- 原型计算

6.2 优化建议

-

元学习优化

- 任务采样

- 梯度计算

- 参数更新

-

适应优化

- 快速适应

- 少样本学习

- 性能优化

7. 常见问题

7.1 技术问题

-

Q: 如何选择元学习算法?

A: 根据任务特点、数据规模、计算资源等。 -

Q: 如何提高适应效率?

A: 使用快速适应、少样本学习、性能优化等。

7.2 应用问题

-

Q: 如何平衡学习和适应?

A: 使用任务采样、梯度计算、参数更新等。 -

Q: 如何保证学习效果?

A: 使用原型计算、距离度量、分类预测等。

8. 实施计划

8.1 开发时间线

总结

本文详细介绍了DeepSeek-R1模型的元学习技术,包括:

- 元学习策略

- 快速适应

- 少样本学习

- 性能优化

- 最佳实践

参考资料

附录

A. 完整元学习代码

# 完整的元学习实现

import os

import time

import logging

import torch

import torch.nn as nn

import numpy as np

class CompleteMetaLearning:

"""

完整的元学习实现

"""

def __init__(self, config):

self.config = config

self.logger = logging.getLogger(__name__)

# 初始化组件

self.meta_learner = MetaLearner(config)

self.fast_adapter = FastAdapter(config)

self.few_shot_learner = FewShotLearner(config)

self.performance_optimizer = PerformanceOptimizer(config)

def train(self, model, task_distribution):

"""

执行元学习

"""

try:

# 元学习

meta_learned_model = self.meta_learner.learn(model, task_distribution)

# 快速适应

adapted_model = self.fast_adapter.adapt(meta_learned_model, task_distribution)

# 少样本学习

few_shot_model = self.few_shot_learner.learn(adapted_model, task_distribution)

# 性能优化

optimized_model = self.performance_optimizer.optimize(few_shot_model)

return optimized_model

except Exception as e:

self.logger.error(f"元学习失败: {str(e)}")

raise

B. 性能测试代码

def benchmark_meta_learning():

"""

元学习性能测试

"""

# 初始化配置

config = MetaLearningConfig()

# 初始化学习

learning = CompleteMetaLearning(config)

# 准备测试数据

task_distribution = prepare_task_distribution()

# 运行测试

results = []

for algorithm in ["MAML", "Reptile", "Prototypical"]:

# 设置学习算法

config.algorithm = algorithm

# 执行测试

performance = test_performance(learning, task_distribution)

results.append({

"algorithm": algorithm,

"performance": performance

})

return results

更新日志

- 2024-03-20:首次发布

- 2024-03-21:添加性能测试代码

- 2024-03-22:更新优化策略

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?