目录

目录

为什么选择Hugging Face Transformers

BERT(Bidirectional Encoder Representations from Transformers)

GPT(Generative Pre-trained Transformer)

RoBERTa(A Robustly Optimized BERT Approach)

引言

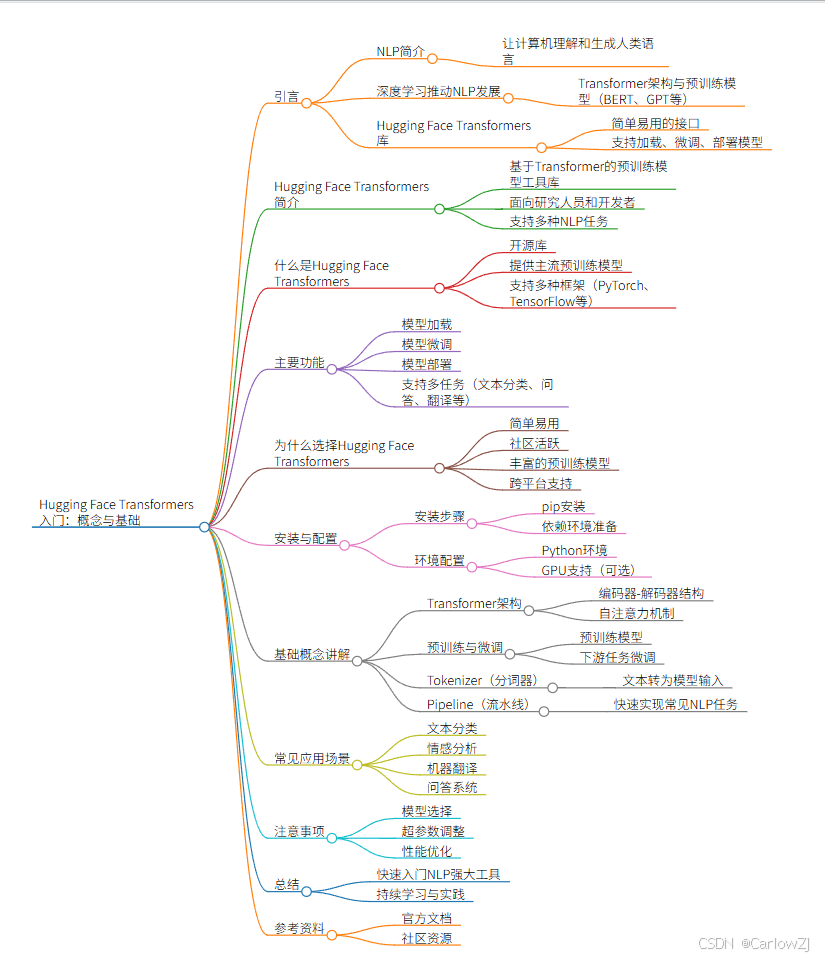

自然语言处理(NLP)是人工智能领域的一个重要分支,它致力于让计算机能够理解和生成人类语言。近年来,随着深度学习技术的飞速发展,NLP领域也取得了巨大的突破。其中,Transformer架构及其衍生的预训练模型(如BERT、GPT等)成为了推动这一进步的关键力量。Hugging Face的Transformers库正是基于这些预训练模型的强大工具,它为研究人员和开发者提供了一个简单易用的接口,用于加载、微调和部署这些模型。本文将详细介绍Hugging Face Transformers的基本概念、安装配置、使用方法以及一些常见的应用场景和注意事项,帮助读者快速入门并掌握这一强大的工具。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?