爬取网易云的音乐链接的简单代码如下

from selenium import webdriver

import os

import time

from selenium.webdriver.common.by import By

from bs4 import BeautifulSoup

import pymssql #引入pymssql模块

dr= webdriver.Firefox(executable_path ="C:\Program Files\Mozilla Firefox\geckodriver.exe")

url='https://music.163.com/#/discover/toplist?id=19723756'

dr.get(url)

dr.switch_to.frame("g_iframe")

first=dr.find_element_by_css_selector(".g-wrap12")

m=first.find_elements_by_tag_name("tr")

lo=first.find_elements_by_css_selector(".txt")

mon=first.find_elements_by_css_selector(".text")

for i in range(1, 100):

ko = m[i].find_element_by_tag_name("a").get_attribute("href")

kd = lo[i - 1].find_element_by_tag_name("b").get_attribute("title")

kk = mon[i - 1].get_attribute("title")

print(ko,kd,kk)

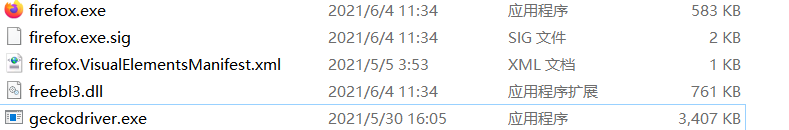

geckodriver的下载根据火狐浏览器的版本进行下载,同时解压放入火狐浏览器的目录里即可,截图如下

运行geckodriver时按照上述代码调用绝对路径即可。

运行geckodriver时按照上述代码调用绝对路径即可。

我只是一位负责领路的小人物,希望这篇文章对那些爬虫新人们有很大的帮助,如能让你爱上爬虫的话,这也将是我的一份成就。

这篇博客展示了如何利用Python的Selenium和BeautifulSoup库爬取网易云音乐的热门歌单链接。通过切换到内联框架,定位到相关元素,获取歌曲链接、歌名和歌手信息。代码中还提到了geckodriver的下载和配置,对于初学者来说是一份很好的爬虫实践教程。

这篇博客展示了如何利用Python的Selenium和BeautifulSoup库爬取网易云音乐的热门歌单链接。通过切换到内联框架,定位到相关元素,获取歌曲链接、歌名和歌手信息。代码中还提到了geckodriver的下载和配置,对于初学者来说是一份很好的爬虫实践教程。

6858

6858