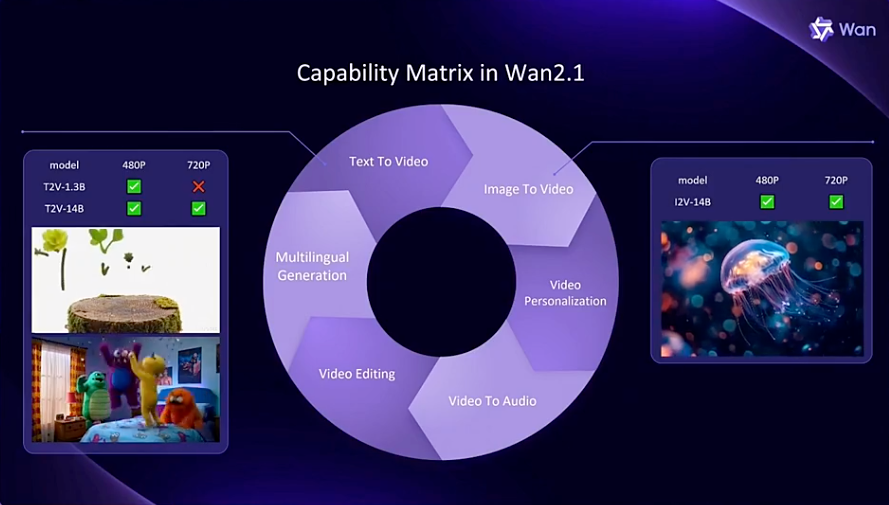

近期,阿里云通义万象团队发布了视频生成大模型Wan2.1,很快冲到了HuggingFace榜的第4位。Wan2.1是阿里云开源的AI视频生成大模型,具备强大的视觉生成能力。Wan2.1支持文生视频和图生视频任务,包含两种尺寸的模型,14B参数的专业版擅长复杂运动生成和物理建模,性能卓越;1.3B参数的极速版能在消费级显卡上运行,显存需求低,适合二次开发和学术研究。

| 6257 | |

| 464 |

主要特点

-

卓越性能:Wan2.1在多个基准测试中持续超越现有开源模型及顶尖商业解决方案。

-

支持消费级GPU:T2V-1.3B模型仅需8.19GB显存,兼容几乎所有消费级GPU。在RTX 4090上,约4分钟即可生成一段5秒480P视频(未采用量化等优化技术),其性能甚至可与某些闭源模型媲美。

-

多任务处理:Wan2.1在文本转视频、图像转视频、视频编辑、文本转图像及视频转音频等任务上表现卓越,推动视频生成领域向前发展。

-

视觉文本生成:Wan2.1是首个能生成中英双语文本的视频模型,具备强大的文本生成能力,增强了其实用性。

-

强大的视频VAE:Wan-VAE在效率与性能上表现卓越,能编码解码任意长度的1080P视频,同时保留时间信息,是视频与图像生成的理想基础。

HuggingFace模型库:https://huggingface.co/Wan-AI

4325

4325

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?