文章目录

MindIE Torch整体介绍

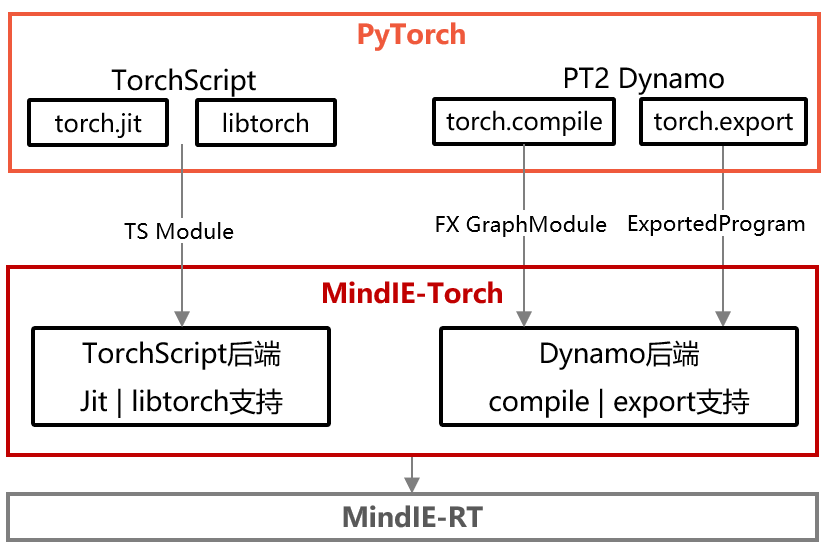

整体架构

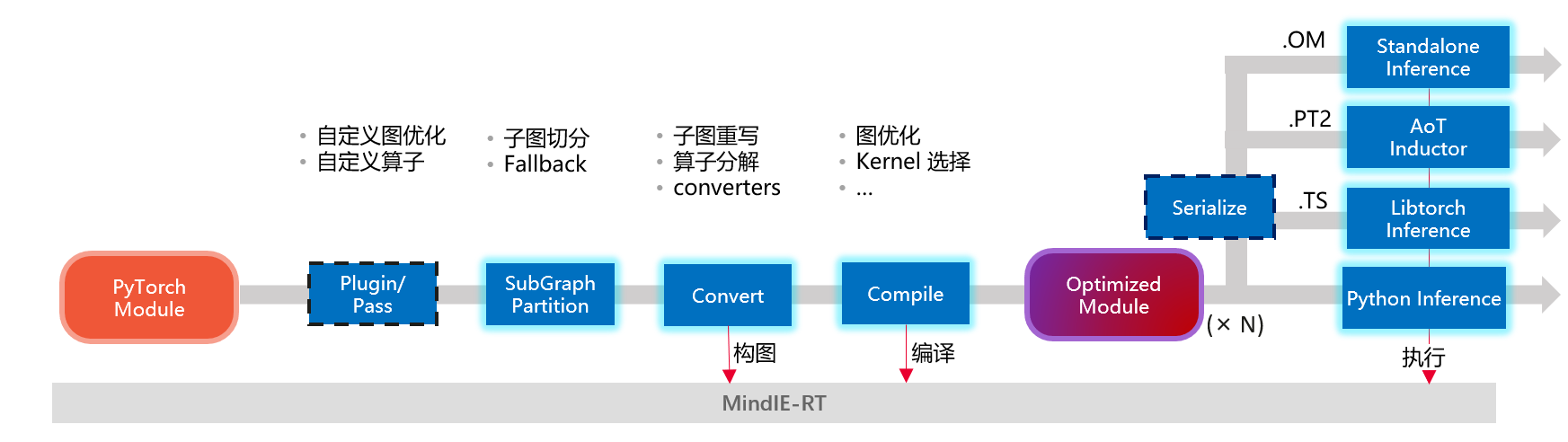

推理迁移工作流

关键特性

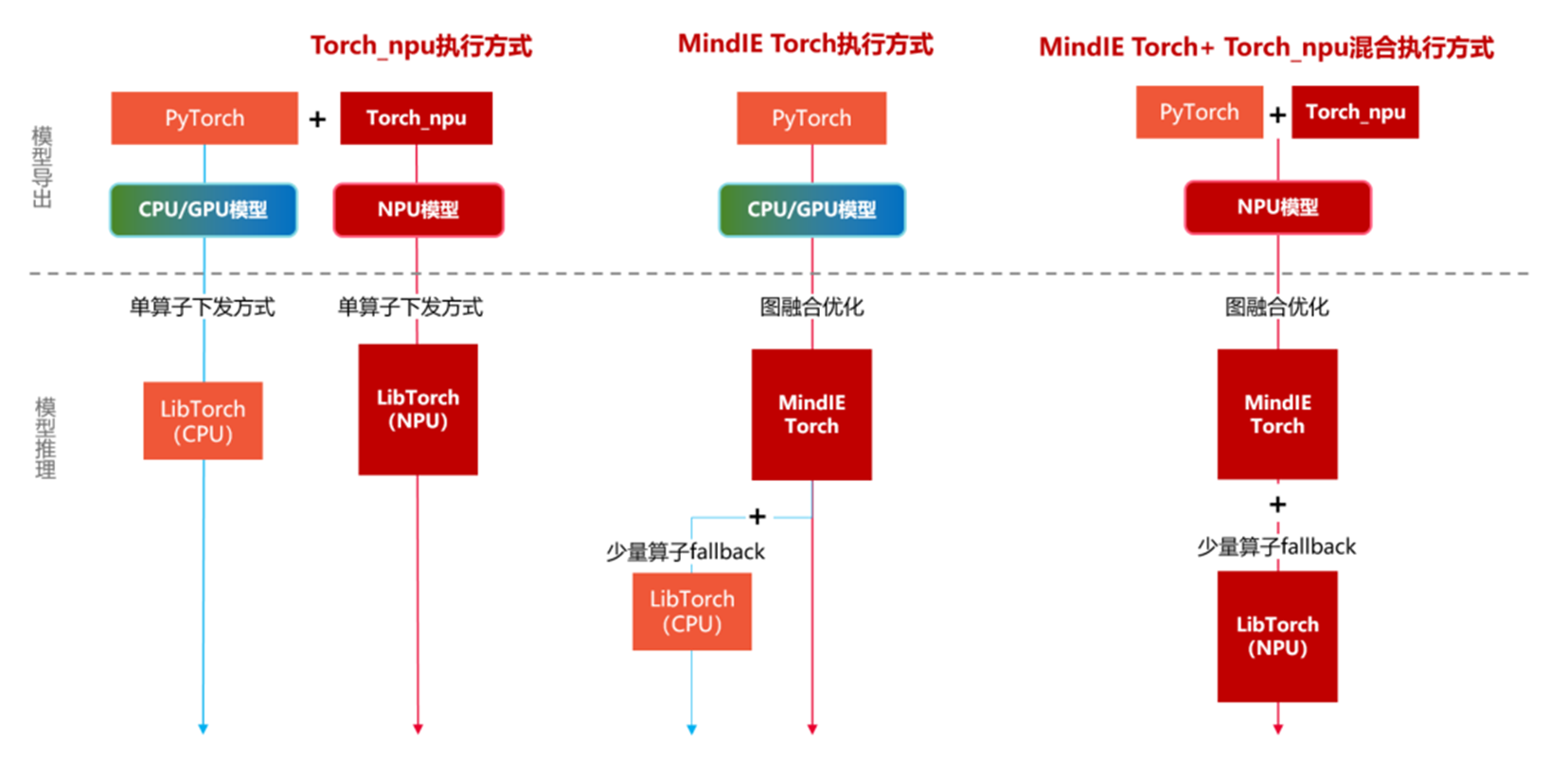

特性1:配合torch_npu实现子图+单算子混合执行

特性2:支持C++和Python编程

c++伪代码(适用于TorchScript路线):

// load TorchScript module

torch::jit::script::Module module = torch::jit::load("xxx.pth");

// step1:compile

torch_aie::torchscript::CompileSpec compileSpec(inputsInfo);

auto compiled_module = torch_aie::torchscript::compile(module, compileSpec);

// step2:forward

npu_results = compiled_module.forward(input);

python伪代码(适用于TorchScript路线):

# load TorchScript module

model = torch.jit.load("xxx.pth")

# step1:compile

compiled_module = mindietorch.compile(model, inputs=inputs_info)

# step2:forward

npu_results = compiled_module.forward(input_data)

特性3:支持TorchScript、ExportedProgram多种模式

- TorchScript模式

支持对torch.jit.trace/script导出的TorchScript模型进行编译优化

# load TorchScript module

model = torch.jit.load

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

794

794

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?