目录

4.2.1 尺度感知(Scale-aware): 这类方法旨在解决海上无人机图像中物体尺度差异大的问题。编辑

多尺度特征融合(Multi-scale Feature Fusion):

4.2.2.小目标检测(Small Object Detection):

4.2.4旋转目标检测(Rotated Object Detection):

4.2.5轻量级方法(Lightweight Methods):

原文:Deep learning-based object detection in maritime unmanned aerial vehicle imagery: Review and experimental comparisons

笔记:MS2ship船舶数据集 海上无人机目标检测的技术更进过程和挑战 未来展望(笔记未完成)

MS2ship数据集可在https://github.com/zcj234/MS2ship.获得。

ABSTRACT

随着海上无人机和深度学习技术的进步,基于无人机的目标检测在海洋工业和海洋工程领域的应用越来越显著。海上无人机具有智能传感能力,能够实现有效和高效的海上监视。为了进一步促进基于无人机的海上目标检测的发展,本文对挑战、相关方法和无人机航空数据集进行了全面综述。具体来说,在这项工作中,我们首先简要总结了海上无人机目标检测的四个挑战,即目标特征多样性、设备限制、海洋环境可变性和数据集稀缺性。然后,我们将重点放在计算方法上,以提高基于海上无人机的目标检测性能,包括尺度感知、小目标检测、视图感知、旋转目标检测、轻量级方法等。接下来,我们回顾了无人机航空图像/视频数据集,并提出了一个名为MS2ship的海上无人机航空数据集,用于船舶检测。此外,我们进行了一系列实验,以提出目标检测方法在海事数据集上的性能评估和鲁棒性分析。最后,我们对基于海上无人机的目标检测的未来工作进行了讨论和展望。

本文的主要贡献总结如下

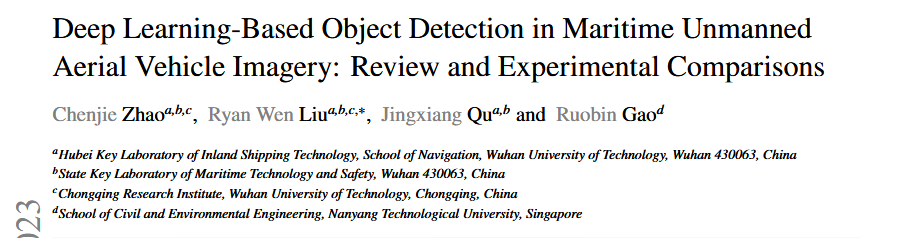

1.详细分析了基于海上无人机的目标检测面临的主要挑战,并回顾了相应的基于深度学习的方法,这些方法可分为六类:尺度感知、小目标检测、视图感知、旋转目标检测、轻量级方法和其他。

2.审查跨越多个场景的UAV空中数据集,然后提出船舶图像数据集,命名为MS2ship。我们希望带注释的基准可以帮助研究人员开发和验证适合海上无人机航拍图像的船舶检测方法。

3.对海事数据集上最先进的物体检测方法进行全面评估,并提供实验结果的详细讨论。分析指出了比较方法的优缺点及其在海上场景中的性能。

基于海上无人机的目标检测面临的主要挑战

-

目标特征多样性(Object Feature Diversity): 无人机的高度机动性使其能够从不同高度和距离拍摄海面物体,导致了显著的尺度变化 。

即使是同一类别的物体,其大小也可能各异,这使得模型难以提取一致的特征 。在高空作业时,图像中常常包含大量小目标,其特征不明显且容易受到海上环境的干扰,从而影响检测精度 。此外,无人机可以从不同视角(如正面、侧面和鸟瞰图)拍摄物体,导致同一类别内的外观特征差异巨大,对模型的鲁棒性提出了挑战 。

-

设备限制(Device Limitation): 无人机在移动时可能导致图像出现运动模糊,从而影响成像质量 。

此外,无人机机载设备的计算能力、承载能力和功耗通常有限 ,这使得需要开发高效、准确且能在有限计算资源上运行的检测方法 。

-

海上环境可变性(Maritime Environment Variability): 海上环境的复杂性和多变性对目标检测构成了挑战 。

恶劣天气条件(如低光照和雾霾)会显著降低能见度 。背景的复杂性也是一个主要问题,例如,图像中常见的太阳光反射产生的眩光 、海浪引起的白色浪花 、船只航行产生的尾迹 以及人与船之间的重叠 ,这些都使准确可靠的检测变得困难 。

-

数据集稀缺性(Dataset Scarcity): 深度学习方法需要大量的训练数据 。

然而,用于海上无人机目标检测的可用数据集非常稀缺 。大多数现有的无人机数据集(如 VisDrone、AU-AIR)主要侧重于内陆场景 ,而现有的海上数据集(如 SeaShips、Mcships)大多是通过岸基、船载或卫星平台采集的,其视角与无人机航拍数据集不同 。

基于深度学习的方法分类

图5:现有基于深度学习的无人机目标检测方法的结构化分类法,主要包括五大方法和其他。

4.2.1 尺度感知(Scale-aware): 这类方法旨在解决海上无人机图像中物体尺度差异大的问题。

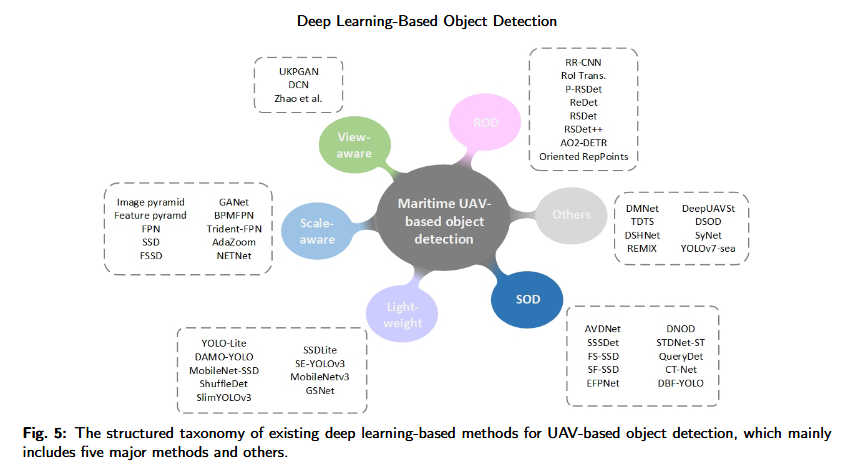

图6:用于尺度感知对象检测方法的一些经典网络结构。

图6展示了从早期到现代,深度学习目标检测方法在处理多尺度问题上的发展历程,主要集中在如何更高效、更准确地利用多尺度特征进行检测。

(a) 图像金字塔(Image Pyramid)

这是最早期的多尺度检测方法之一。它通过将原始输入图像缩放到不同的尺寸来创建图像金字塔。然后,使用固定大小的滑动窗口在每个尺度的图像上进行检测。这种方法的优点是在一定尺度范围内具有不错的竞争力,但其主要缺点是计算量巨大,效率低下,因为它需要对每个尺度的图像都进行完整的特征提取和检测。

(b) 尺度无关(Scale-Agnostic)

为了提高效率,后续方法开始在特征图上进行检测,而不是在图像金字塔上。尺度无关的检测器,如Faster R-CNN、R-FCN和YOLO,只利用网络最后一层的特征图进行预测。这种方法虽然减少了计算量,但由于只使用深层特征图,对于尺寸差异较大的物体,尤其是小目标,其检测效果不佳,因为小目标的特征在经过多层下采样后可能已经丢失。

(c) 单次多盒检测器(SSD)

SSD是第一个利用多层特征图进行预测的代表性方法,它没有使用复杂的特征金字塔结构。SSD利用网络中不同深度的特征图来检测不同大小的物体:

浅层特征图:由于下采样次数少,具有较小的感受野,保留了丰富的边缘和位置信息,适合用于检测小目标。

深层特征图:具有较大的感受野和更丰富的语义信息,适合用于检测大目标。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1463

1463

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?