一、论文主要内容总结

LONGLIVE 是一款基于帧级自回归(AR)框架的实时交互式长视频生成模型,旨在解决长视频生成中效率低、质量退化、交互式提示切换一致性差三大核心问题,具体内容如下:

- 研究背景与挑战

- 长视频生成需兼顾效率与质量:扩散模型及扩散强制模型虽能生成高质量视频,但依赖双向注意力导致推理效率低;因果注意力 AR 模型支持 KV 缓存加速推理,却因长视频训练时的内存问题导致质量退化。

- 交互式需求增加复杂度:静态提示生成限制灵活性,而流式提示输入等交互能力需保证提示切换时的视觉一致性与语义连贯性,进一步提升技术难度。

- 核心技术方案

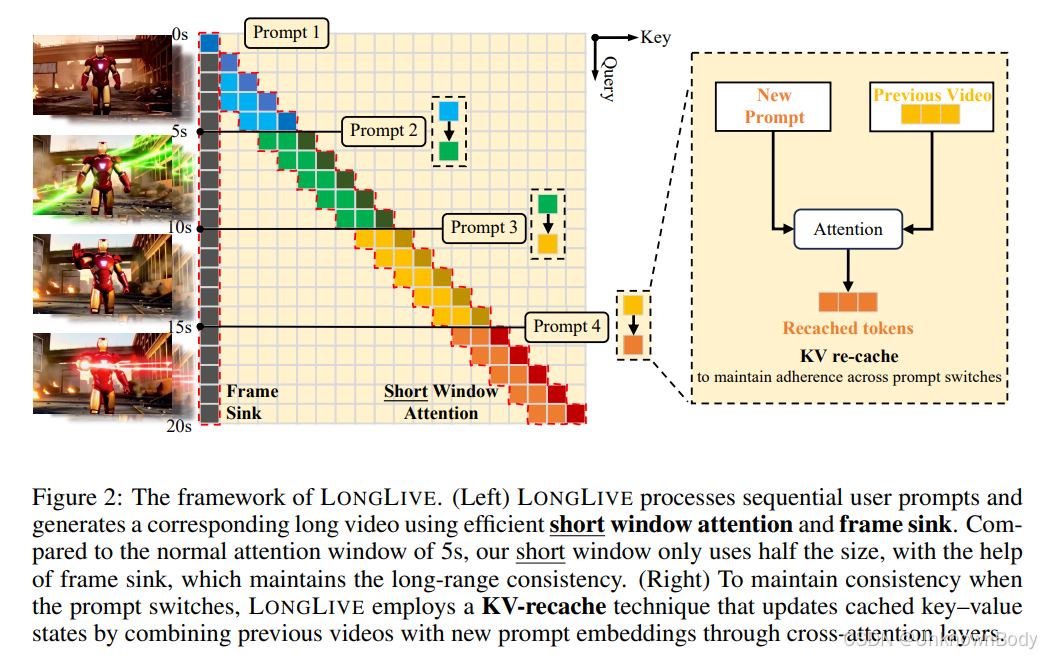

- KV 重缓存(KV-recache):在提示切换边界,结合已生成帧与新提示重新计算 KV 缓存,清除旧提示残留语义,同时保留运动和视觉线索,实现平滑过渡与新提示精准遵循。

- 流式长训练(Streaming Long Tuning):采用“训练-测试长度一致”策略,训练时通过滚动扩展短片段生成长序列,依托教师模型提供局部可靠监督,避免内存溢出(OOM),缓解“短训练-长测试”导致的质量漂移。

- 高效长推理设计

订阅专栏 解锁全文

订阅专栏 解锁全文

1765

1765

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?