文章主要内容总结

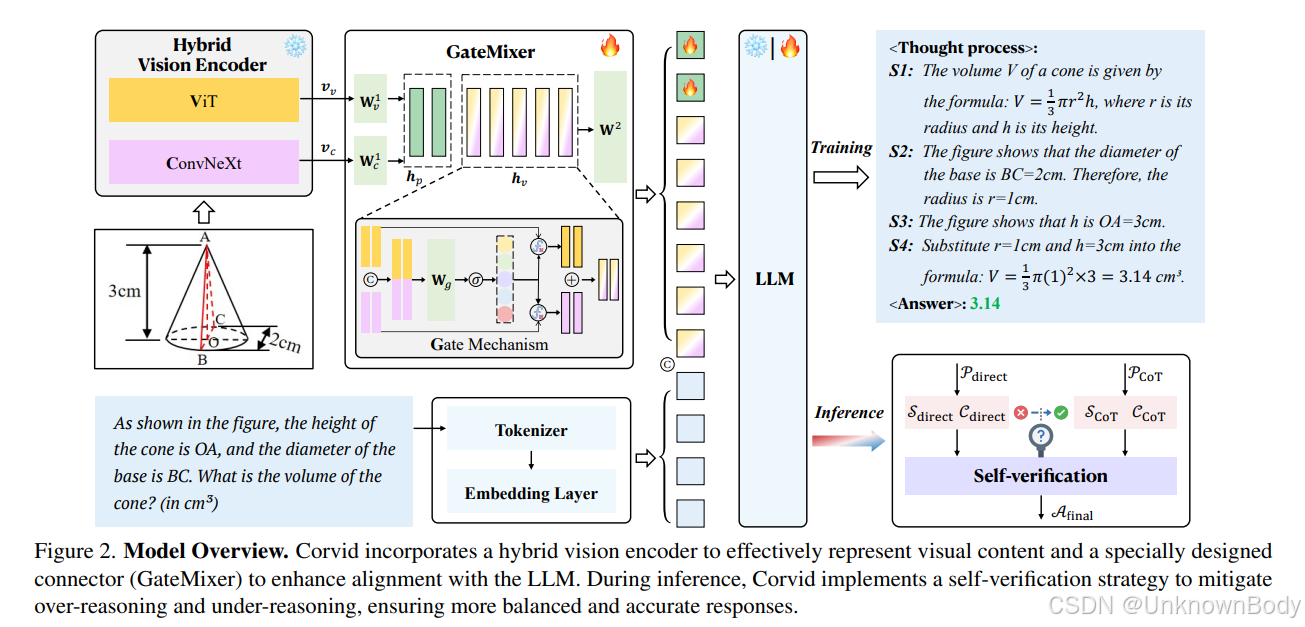

本文提出了一种增强链式思维(Chain-of-Thought, CoT)推理能力的多模态大语言模型(MLLM)——Corvid,旨在解决现有MLLMs在复杂结构化推理中的局限性。

- 核心挑战:现有MLLMs存在三大问题:高质量多模态CoT数据短缺、视觉表征与跨模态对齐不足、推理时易出现过度推理或推理不足。

- 模型架构:

- 采用混合视觉编码器(整合SigLIP ViT和ConvNeXt-XXL),增强视觉信息提取;

- 设计新型连接器GateMixer,通过门控机制和选择性注意促进跨模态交互与对齐。

- 数据集与训练:

- 构建高质量多模态CoT指令数据集MCoT-Instruct-287K,标准化并优化了多种推理数据;

- 采用三阶段训练:多粒度对齐预训练、CoT增强监督微调、纯CoT指令调优,逐步提升分步推理能力。

- 推理策略:提出自验证策略,通过跨模态相似度和模型置信度的加权评估,动态选择直接推理或CoT推理,缓解过度/不足推理。

- 实验结果:Corvid在数学推理、科学问题解决

订阅专栏 解锁全文

订阅专栏 解锁全文

1031

1031

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?