文章主要内容总结:

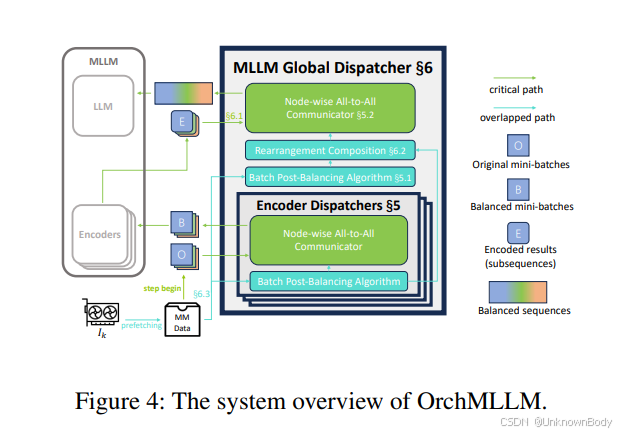

本文提出了一种用于多模态大语言模型(MLLM)训练的高效框架OrchMLLM,旨在解决模态组成不一致(Modality Composition Incoherence)导致的训练效率问题。研究发现,不同模态数据在批次中的比例剧烈变化会加剧小批量不平衡,导致数据并行(DP)实例间的GPU利用率不均。OrchMLLM通过以下核心设计优化训练:

-

批后平衡调度器(Batch Post-Balancing Dispatcher)

- 提出多种批后平衡算法,动态调整小批量分布以消除计算负载差异。

- 设计节点间全连接通信器(Node-wise All-to-All Communicator),通过轻量级通信和内存优化实现高效数据重排。

-

MLLM全局协调器(MLLM Global Orchestrator)

- 协调多模态数据在各训练阶段的平衡,通过重排组合(Rearrangement Composition)减少通信开销。

- 将计算调度与前向传播重叠,进一步提升效率。

-

实验验证

- 在2560块H100 GPU集群

订阅专栏 解锁全文

订阅专栏 解锁全文

544

544

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?