©PaperWeekly 原创 · 作者|王东伟

单位|致趣百川

研究方向|深度学习

本文介绍神经网络(Neural Network)及激活函数(Activation Function)的基本原理。

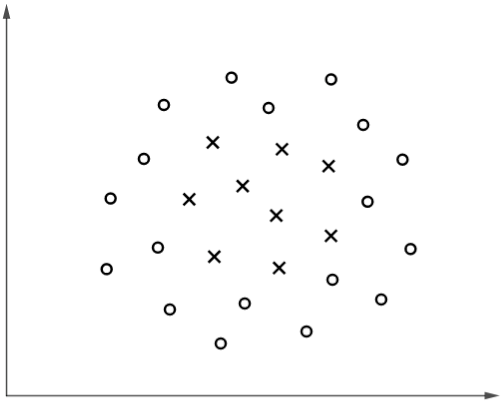

考虑以下分类问题:

▲ 图1

显然,该分类问题具有非线性的决策边界。如果不增加特征,采用线性核的 SVM(以下简称线性 SVM)和逻辑回归都无法拟合,因为它们只能得到形如 的线性边界。

一个可行的办法是增加高次方项作为特征输入,比如以 作为线性 SVM 或逻辑回归输入,可以拟合形如 的决策边界(实际上它可以拟合圆或椭圆),对于图 1 所示的例子这可能是不错的模型。

然而,在实际案例中我们通常都无法猜到决策边界的“形状”,一是因为样本的特征数量很大导致无法可视化,二是其可能的特征组合很多。

对于上述非线性模型拟合的问题,我们之前介绍了采用核函数的 SVM,本文将介绍更通用的方法——神经网络。

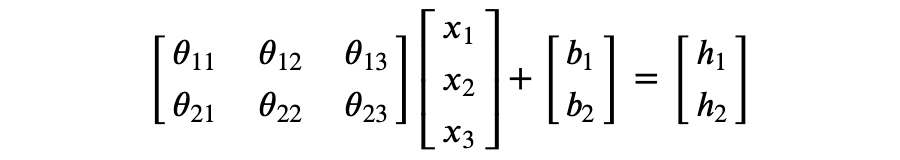

考虑以下矩阵运算:

即:

可以看到 的每个元素都是

本文详细介绍了神经网络(Neural Network)和激活函数(Activation Function)的基本原理,探讨了如何使用神经网络解决非线性分类问题。通过矩阵运算展示了神经网络的结构,特别强调了激活函数在解决非线性模型拟合中的作用,如Sigmoid、Tanh、ReLU及其变种。此外,还讨论了隐藏层单元数量对模型性能的影响以及激活函数选择的考量因素。

本文详细介绍了神经网络(Neural Network)和激活函数(Activation Function)的基本原理,探讨了如何使用神经网络解决非线性分类问题。通过矩阵运算展示了神经网络的结构,特别强调了激活函数在解决非线性模型拟合中的作用,如Sigmoid、Tanh、ReLU及其变种。此外,还讨论了隐藏层单元数量对模型性能的影响以及激活函数选择的考量因素。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

771

771

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?