第一节——Detectron2-BlendMask论文综述

1-1 Detectron2-BlendMask论文摘要

实例分割是计算机视觉中非常基础的任务。近来,全卷积实例分割方法得到了更多的注意力,因为它们要比双阶段的方法(如Mask R-CNN)更简单、高效。到目前为止,在计算复杂度相同的情况下,几乎所有的方法在掩码准确率上都落后于双阶段的 Mask R-CNN 方法,给了很大的提升空间。本文将实例级别信息和较低细粒度的语义信息结合,提升了掩码的预测。本文主要贡献就是,提出了一个混合模块,它受到自上而下实例分割方法和自下而上方法的启发。BlendMask 仅用少数几个通道,就能有效地预测密集的逐像素点的位置-敏感实例特征,只用一个卷积层就可以学习每个实例的注意力图,因此推理时非常快速。BlendMask 可以很容易地加到 state of the art 的单阶段检测器中,并且在性能上超过 Mask R-CNN,速度要快20 % 20\%20%。在单张1080ti显卡上,BlendMask 的一个轻量级版本取得的mAP 是34.2 % 34.2\%34.2%,速度为25FPS。由于其简洁性和有效性,BlendMask 能够作为一个简单而有效的基线模型,供实例预测任务使用。

图1-1 Detectron2-BlendMask论文

1-2 Detectron2-BlendMask简介

表现最优的目标检测器和分割器都延续了一个双阶段流程。它们由一个全卷积网络、RPN构成,在兴趣区域RoI上进行密集的预测。人们使用了一系列的轻量级网络(head)来重新对齐 RoI 的特征,进行预测。生成掩码的质量和速度与掩码 head 的结构息息相关。此外,各独立的 heads 很难与相关的任务(如语义分割任务)来共享特征,造成网络结构优化很困难。

最近一些单阶段目标检测方法如FCOS证明了它们可以在准确率上超过双阶段方法。在实例分割任务上也能进行单阶段检测就很诱人了:1)仅有卷积操作的模型更简单、更容易进行跨平台部署,2)一个统一的框架可以为多任务网络结构的优化提供便利和灵活度。

密集的实例分割方法可以追溯到 DeepMask,它是一个自上而下的方法,通过滑动窗的方式产生密集的实例掩码。在每个空间位置上,掩码的特征表示被编码为一个一维的向量。尽管结构上很简单,但在训练过程中存在多个障碍,使其无法取得优异的性能:1)特征和掩码之间的局部一致性丢失了;2)特征表示是冗余的,因为每个前景特征都重复编码了掩码信息;3)卷积中的下采样造成位置信息退化。

Dai 等人[8] 探索了第一个问题,他们尝试通过保留多个位置敏感图,保留局部一致性。Chen 等人[7] 研究了这个想法,针对目标实例掩码上的每个位置,提出了一个密集的表征对齐方法。但是,这个方法为了对齐而牺牲了表征的效率,造成第二个问题难以解决。第三个问题造成下采样过多的特征无法提供实例的细节信息。

鉴于这些难点,另一些人提出了一个自下而上的策略。这些方法生成大量的逐像素点的 embedding 特征,然后使用一些技巧来组合它们。取决于 embedding 的特征,这些组合方法包括简单的聚类,以及基于图的算法等。通过逐像素点的预测,局部一致性和位置信息就很好地保留了下来。自下而上方法的缺点有:1)过于依赖密集预测的质量,导致性能不佳,造成掩码的割裂与错误连接;2)对于类别较多的复杂场景泛化能力有限;3)需要非常复杂的后处理技术。

本文中作者将自上而下和自下而上的方法结合起来。作者研究了两个重要的方法:FCIS 和 YOLACT。它们都是预测实例级别的信息,如边框位置,然后利用裁剪手段(FCIS)或加权和(YOLACT)将其与逐像素点的预测结合起来。本文认为,这些过度简化的合并设计可能无法平衡顶层和底层特征表示的能力。

较高层级的特征对应着更大的感受野,可以获取实例的全局信息,如姿势,而较低层级的特征则保留了更好的位置信息,可以提供更精细的细节信息。本文的一个关注点在于,如何以全卷积实例分割的方式,更好地融合这两种特征。更具体点就是,作者把实例级别的信息变得更加丰富,并且进行细粒度更高的位置敏感掩码预测,为基于候选框的掩码方法提供通用性的操作。作者进行了广泛的研究,探索了最优的维度、分辨率、对齐方法,以及特征定位方法等。具体点就是:

对于基于候选框方式的实例掩码生成,设计了一个灵活的方法:Blender,它将实例级别的丰富信息和准确的密集的像素特征融合起来。在COCO 数据集的比较中,该方法的mAP要比 YOLACT 和 FCIS 的融合方法准确率高1.9和1.3分。

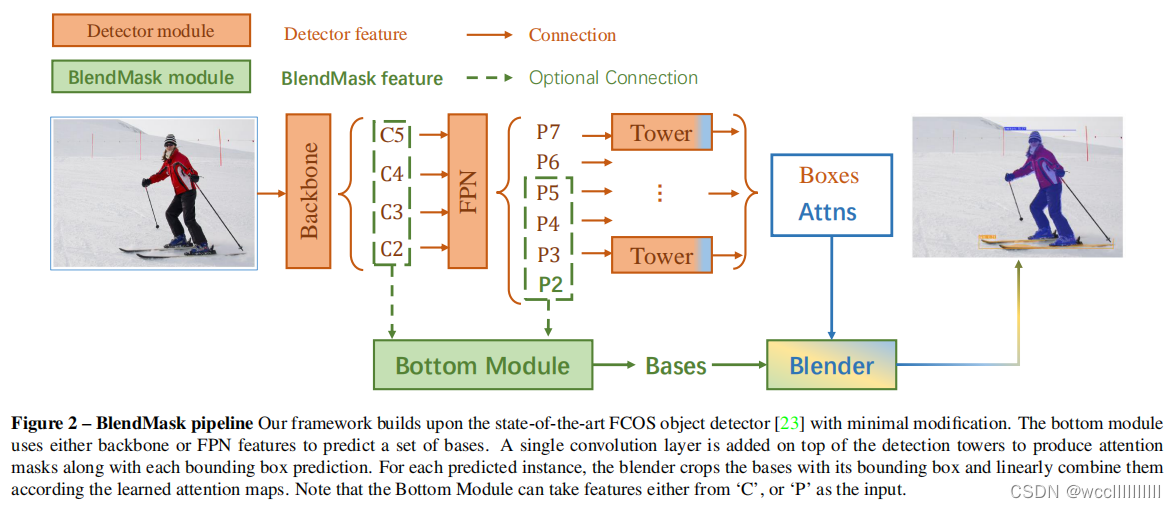

提出了一个简单的网络结构,BlendMask,基于目前 state of the art 的单阶段目标检测器 FCOS,在既有的网络结构之上增加了少许的计算量。

BlendMask 一个明显的优势就是,它的推理时间不会像双阶段方法一样,随着预测数量的增加而增加,对实时场景更加地鲁棒。

在COCO数据集上,当BlendMask 在主干网络为 ResNet-50 时,它取得的 mAP 为 37.0 % 37.0\%37.0%,而当主干网络为 ResNet-101 时,它可以取得 38.4 % 38.4\%38.4% 的mAP,这超越了 Mask R-CNN,而且要快20 % 20\%20%。该方法创下了全卷积实例分割的新记录,掩码mAP 要比 TensorMask 高 1.1 1.11.1 个点,而只需一半的训练次数,推理时间也仅为1 / 5 1/51/5。BlendMask 可能是第一个在掩码 AP 和推理效率上超过 Mask R-CNN 的算法。

因为 BlendMask 的底部模块可以同时分割 “things and stuff”,BlendMask 可以自然地解决全景分割问题,而无需改动。

对于 Mask R-CNN 的掩码 head,它的分辨率通常为28 × 28 28\times 2828×28,而由于 BlendMask 更加灵活,底部模块没有严格地绑定到FPN上,其底部模块输出的掩码的分辨率要更高。因此,BlendMask 输出掩码的边界可以更加准确,如图4所示。

BlendMask 非常通用而且灵活。只需稍微的改动,就可以将 BlendMask 应用到实例级别的识别任务上,如关键点检测。

图1-2Detectron2-BlendMask论文

1-3 Detectron2-BlendMask的方法

Top-down 方法:自上而下的密集实例分割的开山鼻祖是DeepMask,它通过滑动窗口的方法,在每个空间区域上都预测一个mask proposal。这个方法存在以下三个缺点:

1、mask与特征的联系(局部一致性)丢失了,如DeepMask中使用全连接网络去提取mask;

2、特征的提取表示是冗余的, 如DeepMask对每个前景特征都会去提取一次mask;

3、下采样(使用步长大于1的卷积)导致的位置信息丢失;

Bottom-up 方法:自下而上的密集实例分割方法的一般套路是,通过生成per-pixel的embedding特征,再使用聚类和图论等后处理方法对其进行分组归类。这种方法虽然保持了更好的低层特征(细节信息和位置信息),但也存在以下缺点:

1、对密集分割的质量要求很高,会导致非最优的分割;

2、泛化能力较差,无法应对类别多的复杂场景;

3、后处理方法繁琐;

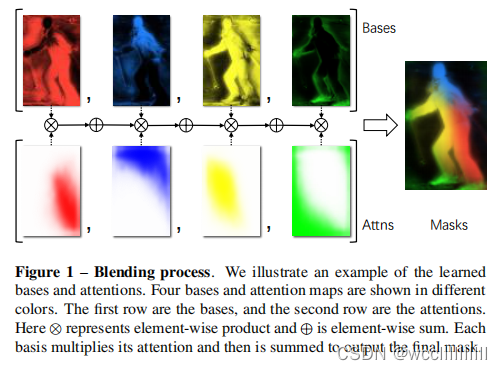

本论文中,detectron2-blendmask采取的是混合方法:本文想要结合 top-down和bottom-up两种思路,利用top-down方法生成的instance-level的高维信息(如bbox),对bottom-up方法生成的 per-pixel prediction进行融合。因此,本文基于FCOS提出简洁的算法网络BlendMask。融合的方法借鉴FCIS(裁剪)和YOLACT(权重加法)的思想,提出一种Blender模块,能够更好地融合包含instance-level的全局性信息和提供细节和位置信息的低层特征。

1-4 Detectron2-BlendMask的网络结构

BlendMask 由一个检测网络(detector module)和一个掩码分支(BlendMask module)构成。BlendMask的整体架构如下图所示,掩码分支有三个部分,bottom module用来对底层特征进行处理,是预测得分图的底部模块,生成的score map称为Base;top layer串接在检测器的box head上,一个预测实例注意力的顶部模块,生成Base对应的top level attention;最后是blender来对Base和attention进行融合,即一个将得分和注意力融合起来的混合模块。

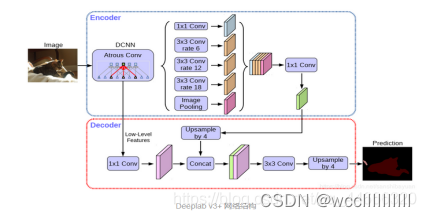

底部模块。与其它基于候选框的全卷积网络类似,作者增加了一个底部模块来预测得分图,称之为 bases。作者在实验部分使用 DeepLab V3+作为 decoder。底部模块的输入可以作为主干网络特征,跟传统的语义分割网络,或者YOLACT和全景FPN中的特征金字塔一样。

Top layer 作者在每个检测tower 之上都附加了单个卷积层,预测 top-level 的注意力。

图1-3 Detectron2-BlendMask网络结构

文中使用的是DeeplabV3+的decoder,其他分割网络的decoder同样适用。

图1-4

提出BlendMask,结合自顶向下和自底向上方法,实现实例分割任务。模型速度快,精度高,可在单张1080Ti上达34.2% mAP,速度25FPS。

提出BlendMask,结合自顶向下和自底向上方法,实现实例分割任务。模型速度快,精度高,可在单张1080Ti上达34.2% mAP,速度25FPS。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1720

1720