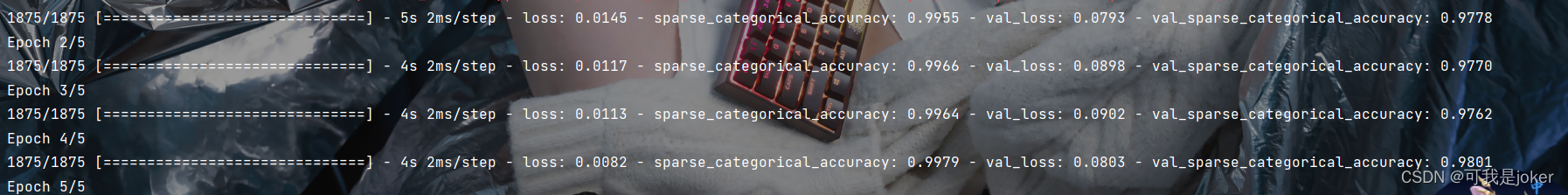

你在训练的时候看到下面这样的图片是不是感觉不太直观

当迭代次数多的时候,前面的loss和accuracy与后面的交织在一起,变化变得不那么直观,看起来会比较麻烦

那咱把这东西整成图不就好了,loss变成啥样,accuracy咋变的,一目了然,开整!

# history=model.fit(训练集数据,训练集标签,batch_size=,epochs=,validation_split=用作测试数据的比例,validation_data=测试集,

# validation_freq=测试频率)

# history:

# 训练集loss:loss

# 测试集loss:val_loss

# 训练集准确率:sparse_categorical_accuracy

# 测试集准确率:val_sparse_categorical_accuracy

import tensorflow as tf

import os

from tensorflow import keras

import matplotlib.pyplot as plt

import numpy as np

np.set_printoptions(threshold=np.inf)

mnist = keras.datasets.mnist

(x_train,y_train),(x_test,y_test) = mnist.load_data()

x_train,x_test = x_train/255,x_test/255

model = keras.models.Sequential([

keras.layers.Flatten(),

keras.layers.Dense(128,activation='relu'),

keras.layers.Dense(10,activ

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?