Logistic Regression as a Neural Network

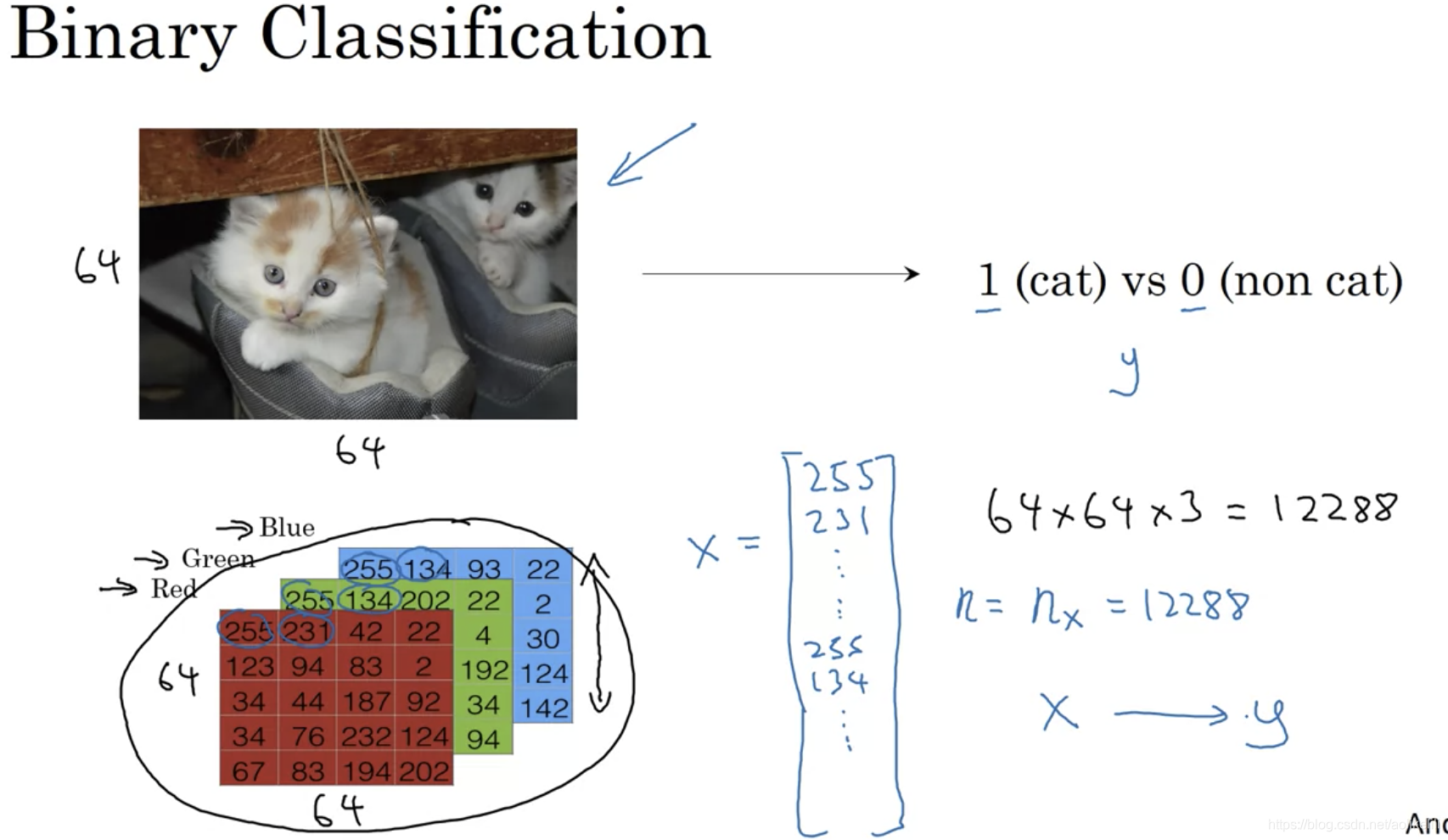

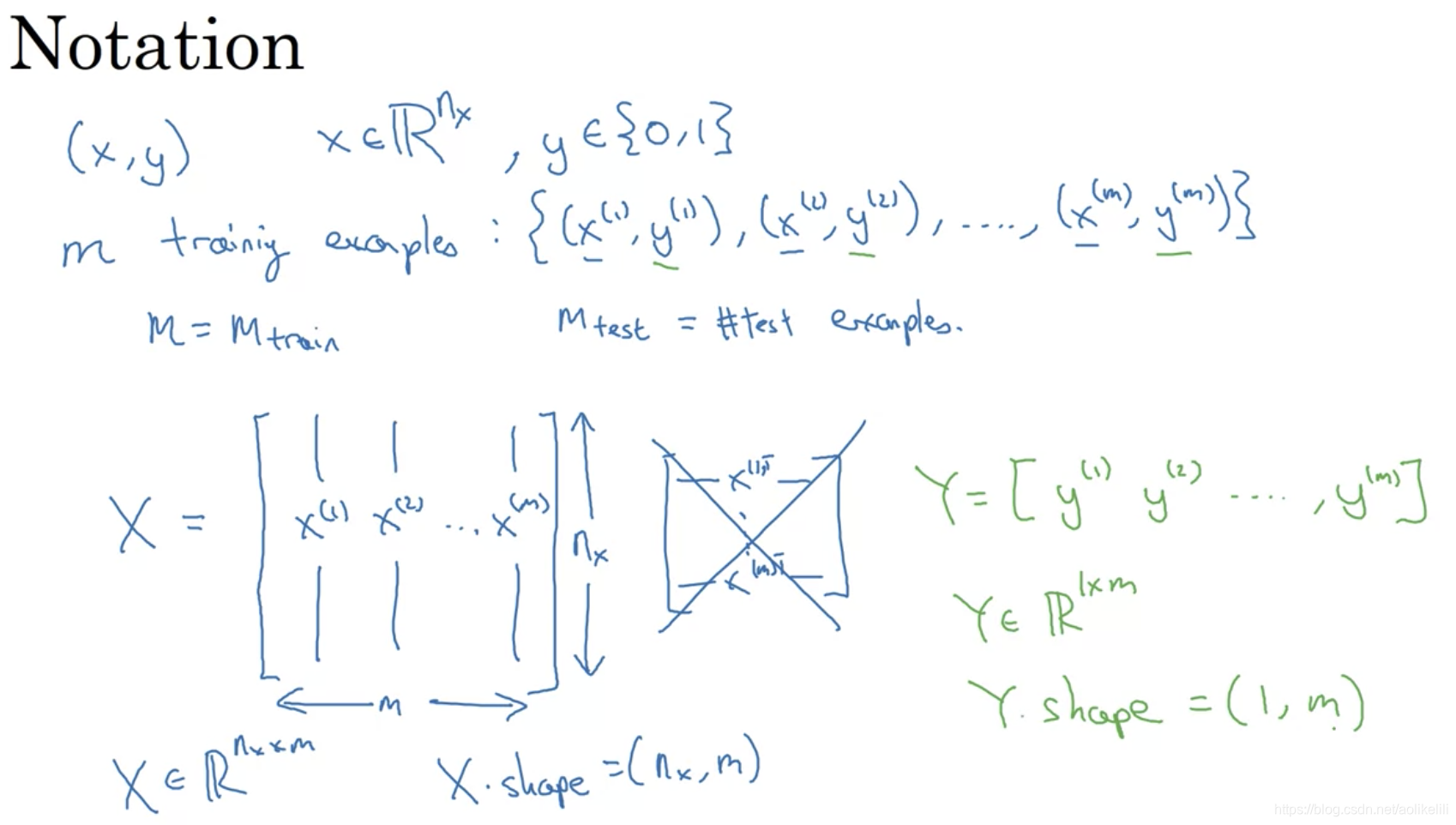

1.Binary Classification

** binary classification定义**

其中n为向量的纬度

nations

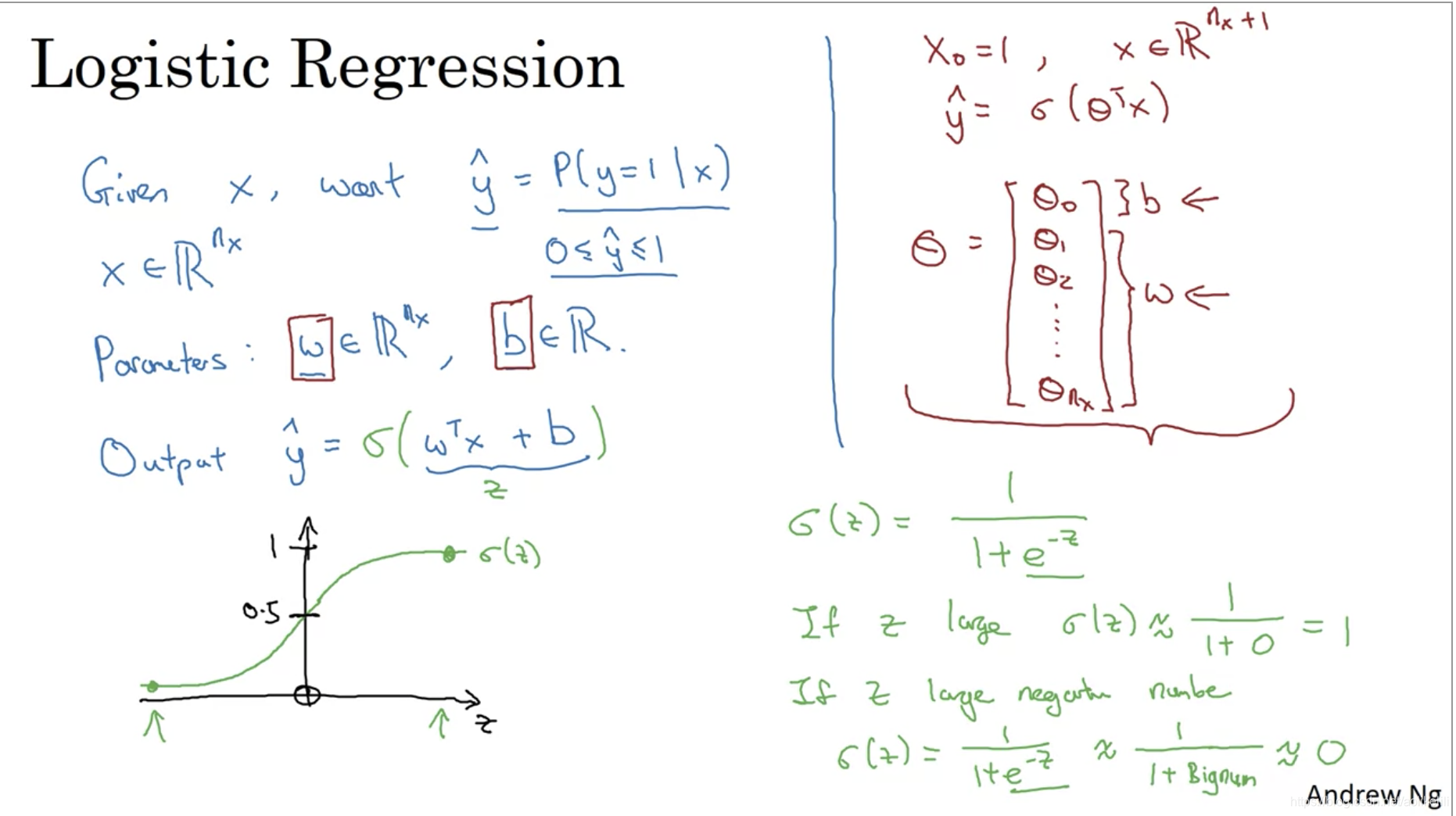

2.logistic Regression

(逻辑回归是一种学习算法?)

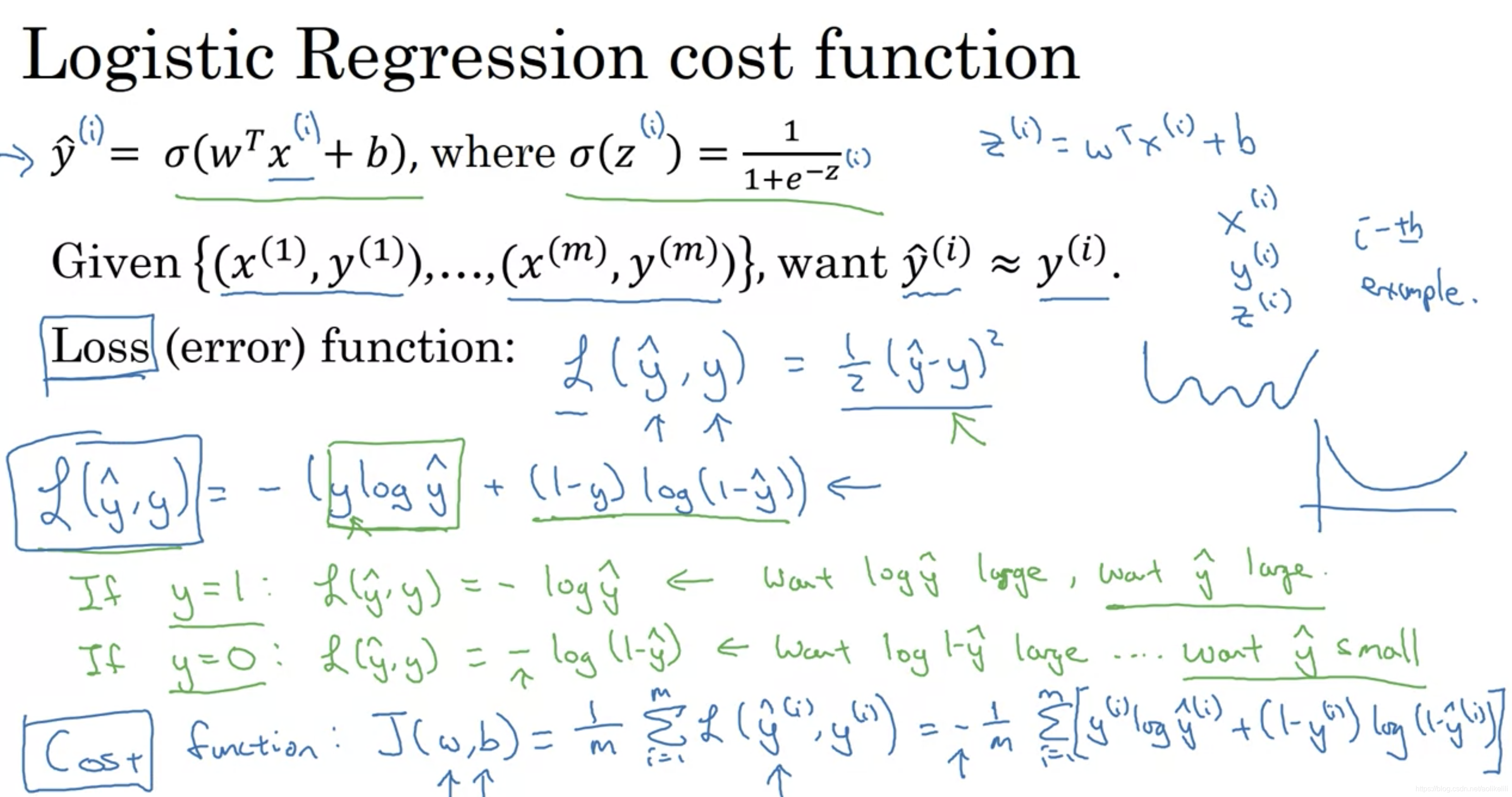

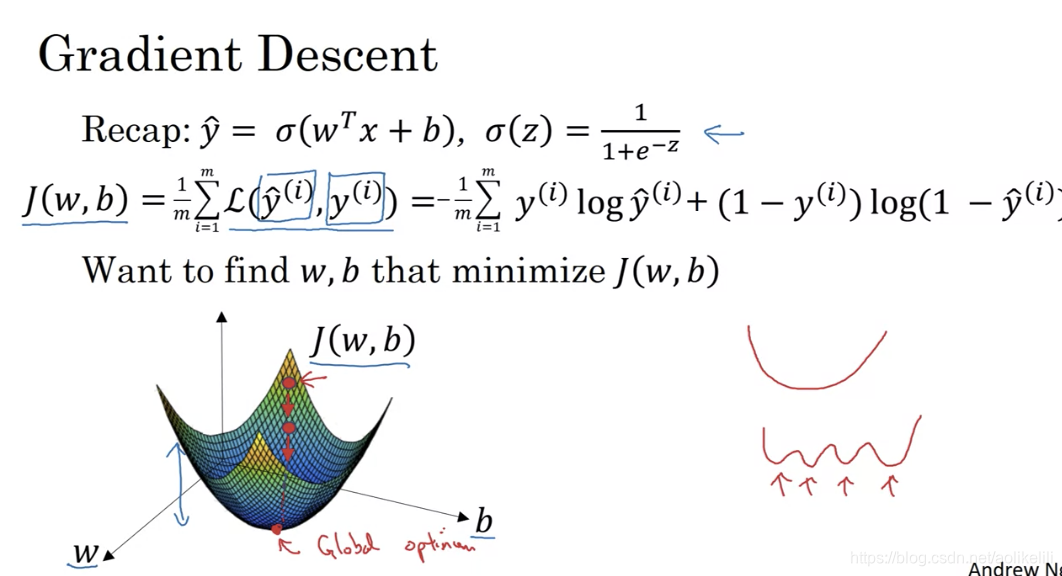

3.logistic Regression Cost Function

cost function反应了参数成本,就是衡量参数w&b在训练集上的效果

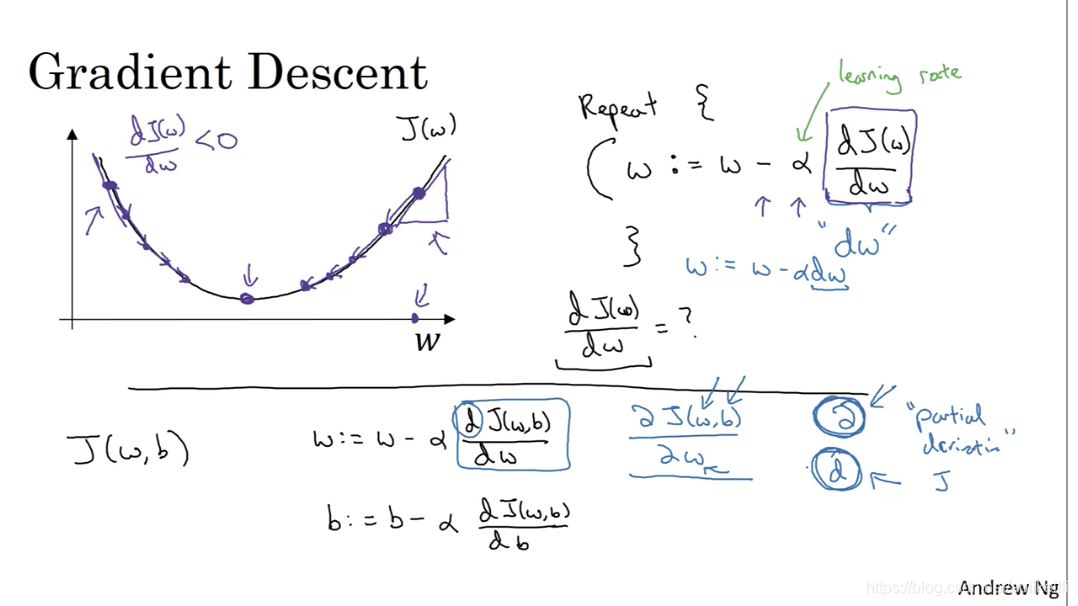

Gradient Descent

//梯度下降

一些英语名词:

partial derivative偏导

the slope of the function(函数的斜率),with respect to one of the variables.关于至于

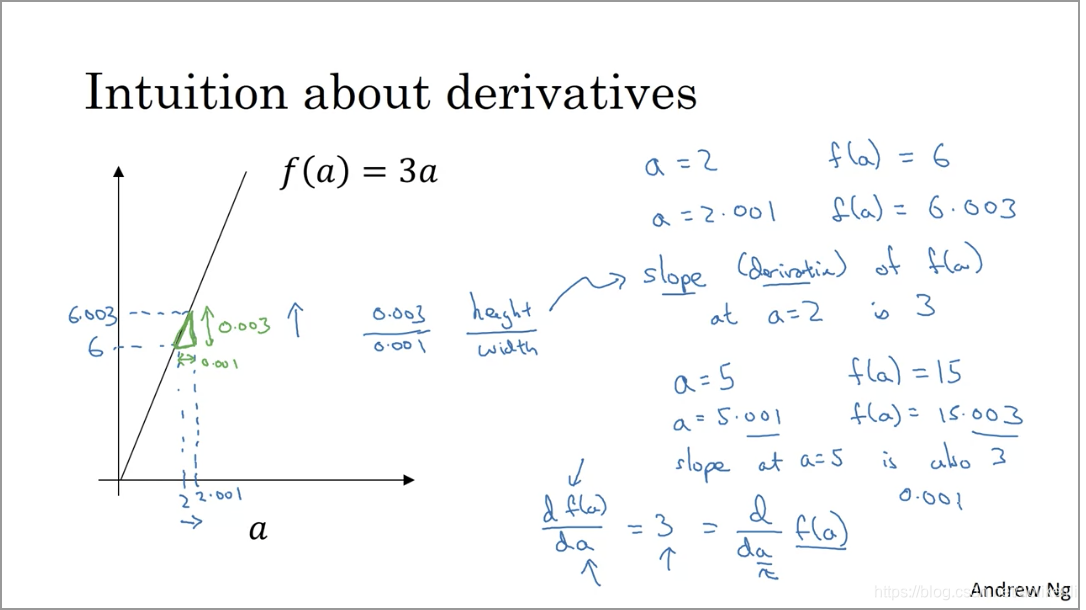

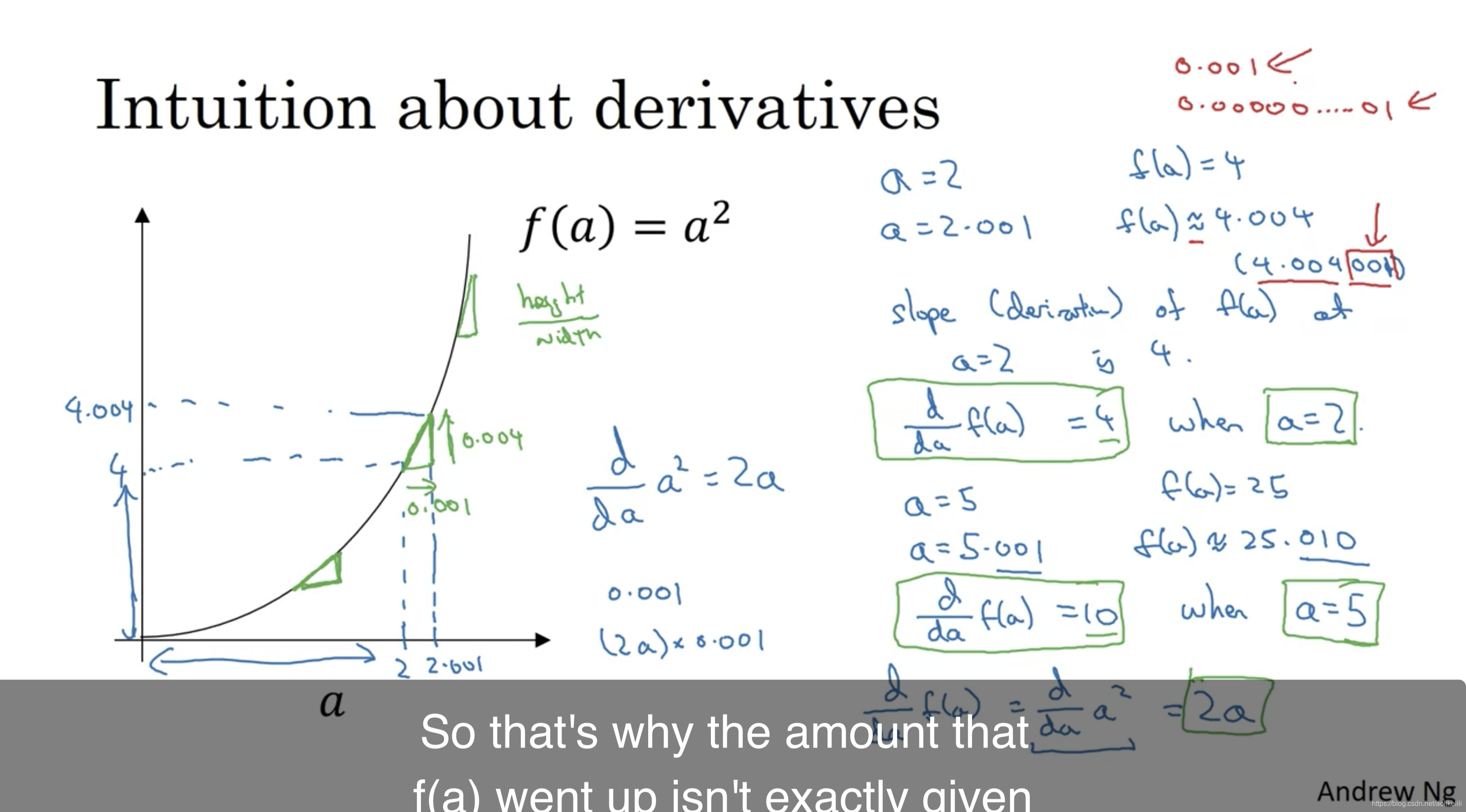

Derivatives

calculus and the derivatives //微积分和导数

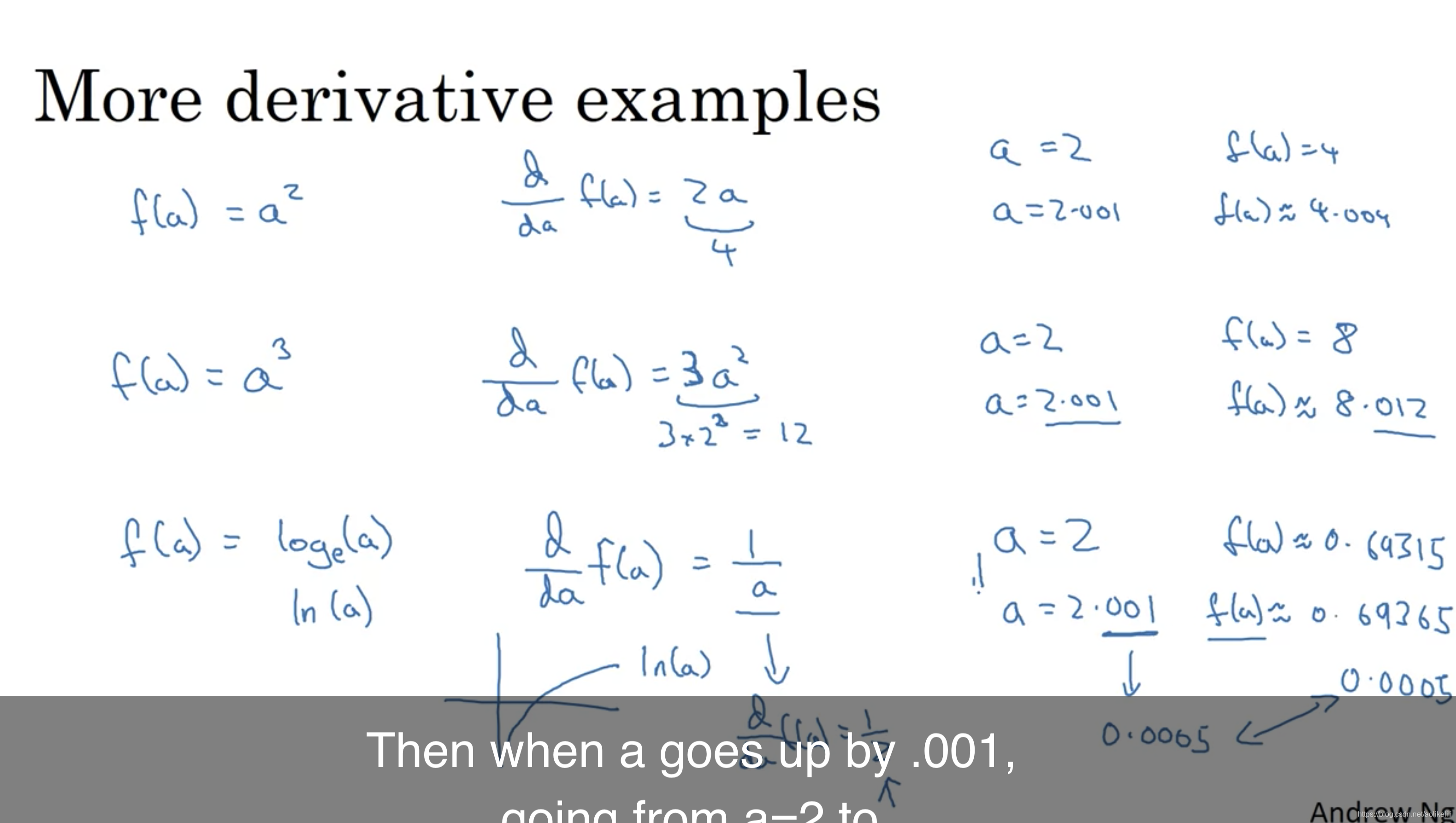

More Derivative Examples

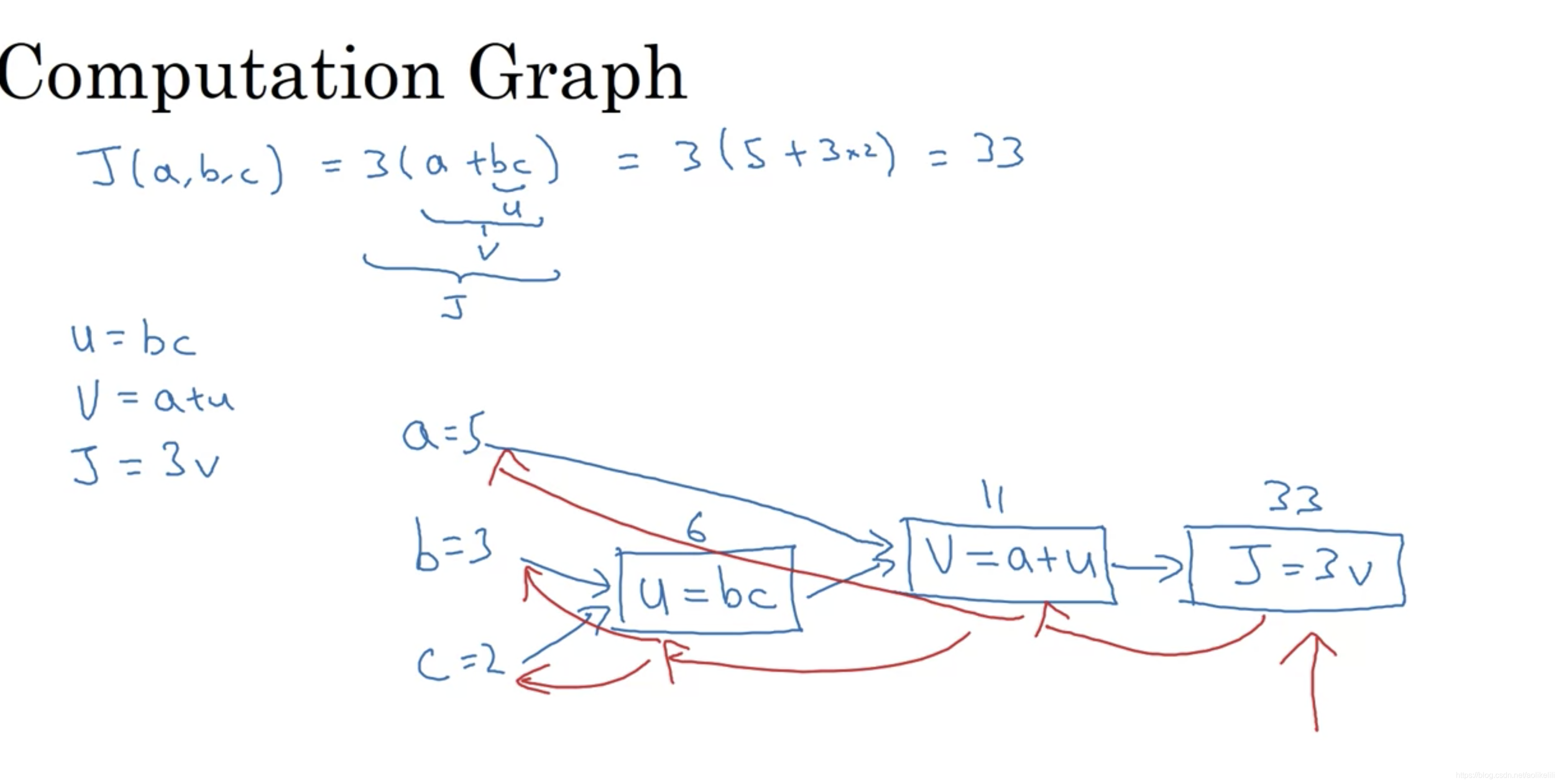

computation graph

蓝色的箭头是顺着的

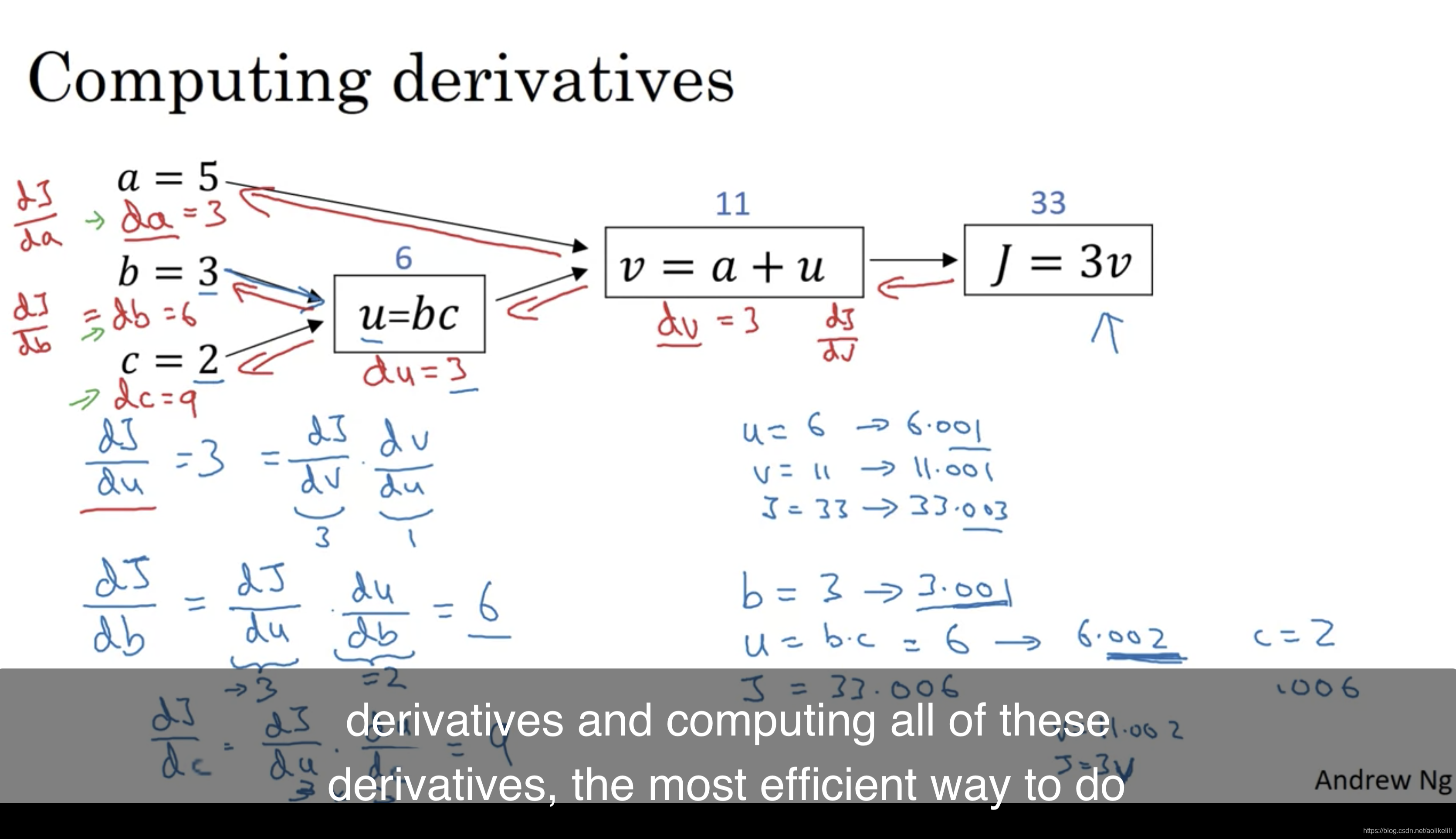

Derivatives with a computation graph

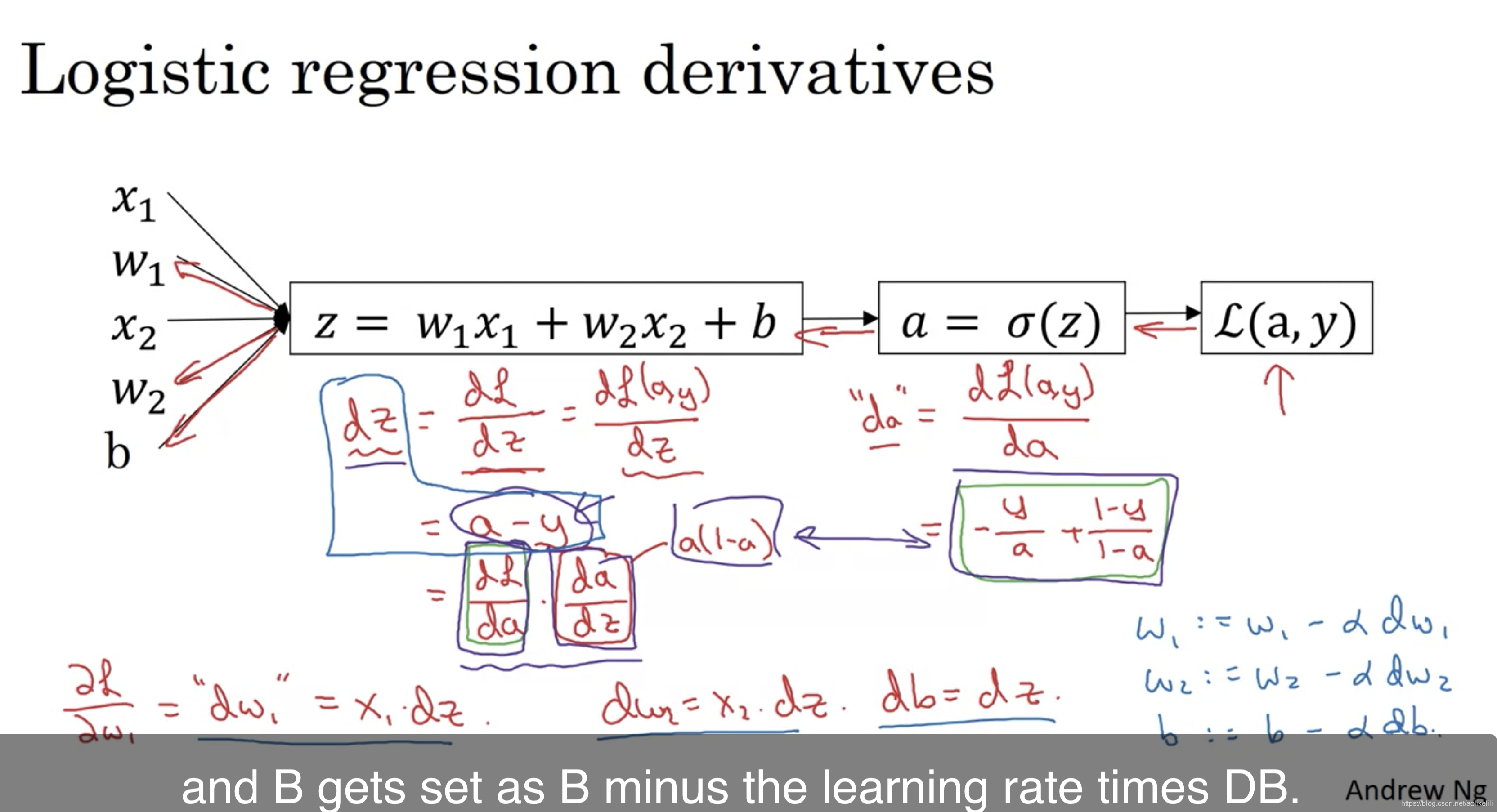

Logistic Regression Gradient Descent

//gradient descent :梯度下降

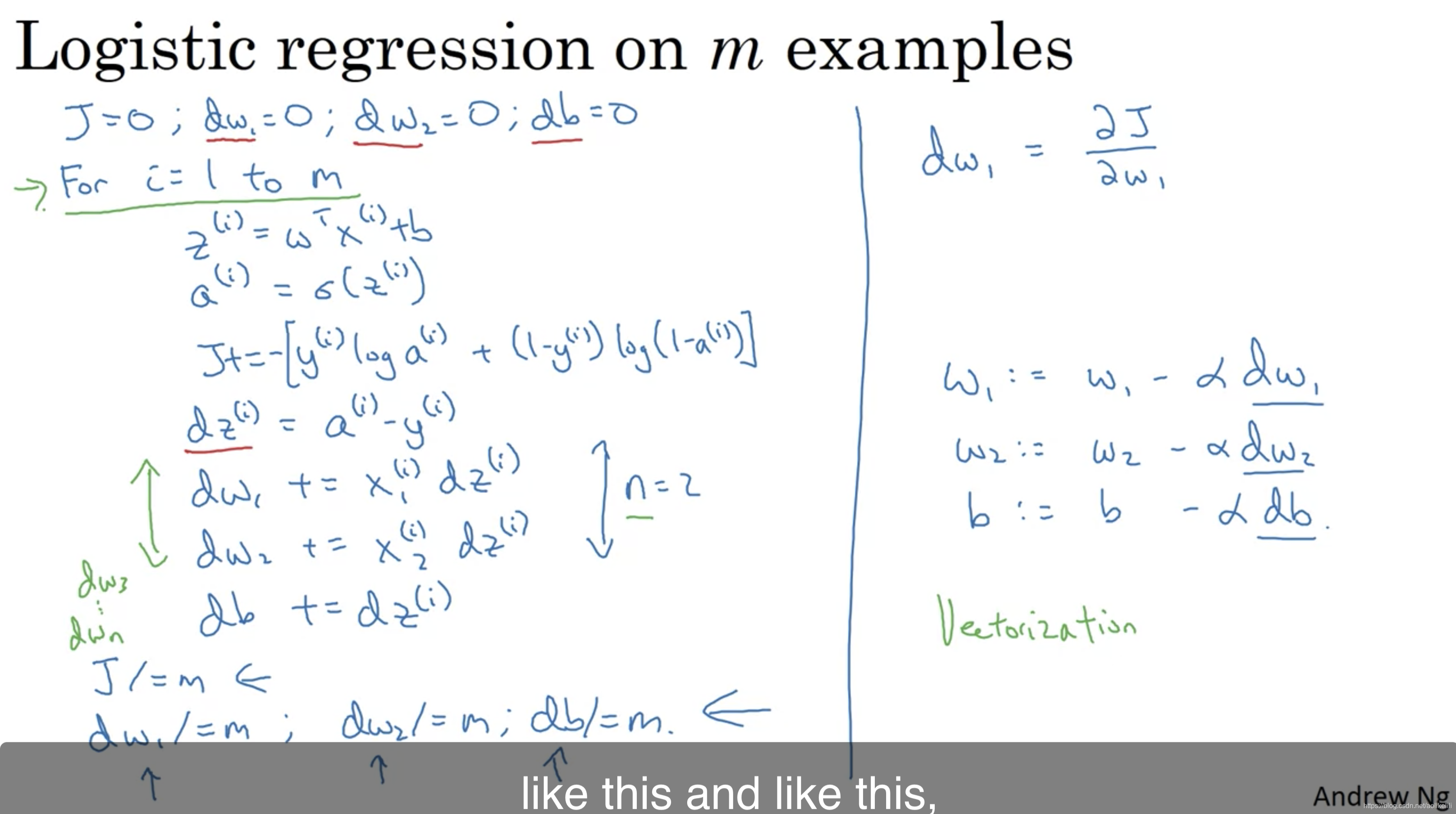

Gradient Descent on Examples

本文深入探讨了逻辑回归作为神经网络的一种形式,特别是在二元分类问题中的应用。讲解了逻辑回归的成本函数及其如何通过梯度下降算法进行优化,同时介绍了偏导数、计算图等关键概念。

本文深入探讨了逻辑回归作为神经网络的一种形式,特别是在二元分类问题中的应用。讲解了逻辑回归的成本函数及其如何通过梯度下降算法进行优化,同时介绍了偏导数、计算图等关键概念。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?