昨日,Meta公司发布了人工智能模型——Llama 3.1。

前排提示,文末有大模型AGI-优快云独家资料包哦!

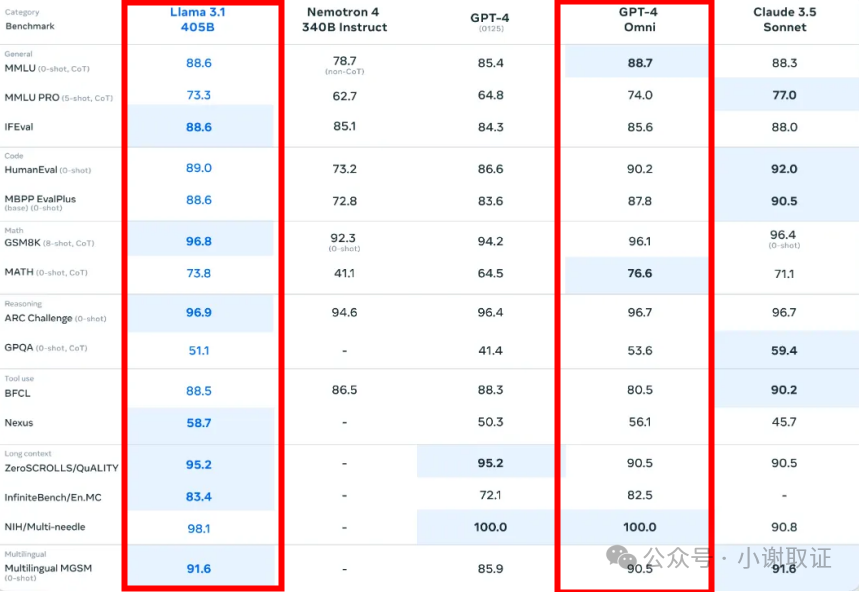

那么Llama 3.1 405B的效果怎么样?我们来对比一张图,横向对比一下GPT-4。

可以看出,Llama 3.1 405B在各类任务中的表现可以与GPT-4等顶级的模型相差无几。

那么,我们怎样才能用到这款强大的Llama 3.1 405B模型呢?最直接的方式是通过Meta.ai平台,但目前这一途径仅对美丽国的用户开放。

那有无适合平民用的大模型嘞。

接下来我们将在本地部署Llama 3.1 8B(环境所迫)

1.环境准备

(1)Windows10系统及以上的计算机

(2)内存要求:8GB内存可运行7B模型,16GB可运行13B模型,32GB运行可33B模型

(3)网络环境:不需要科学上网(翻墙)

(4)小谢此次搭建的电脑环境如图,又无GPU,这配置只能搭个入门级别的大模型。若有GPU,响应速度则更快。

2.部署安装过程:

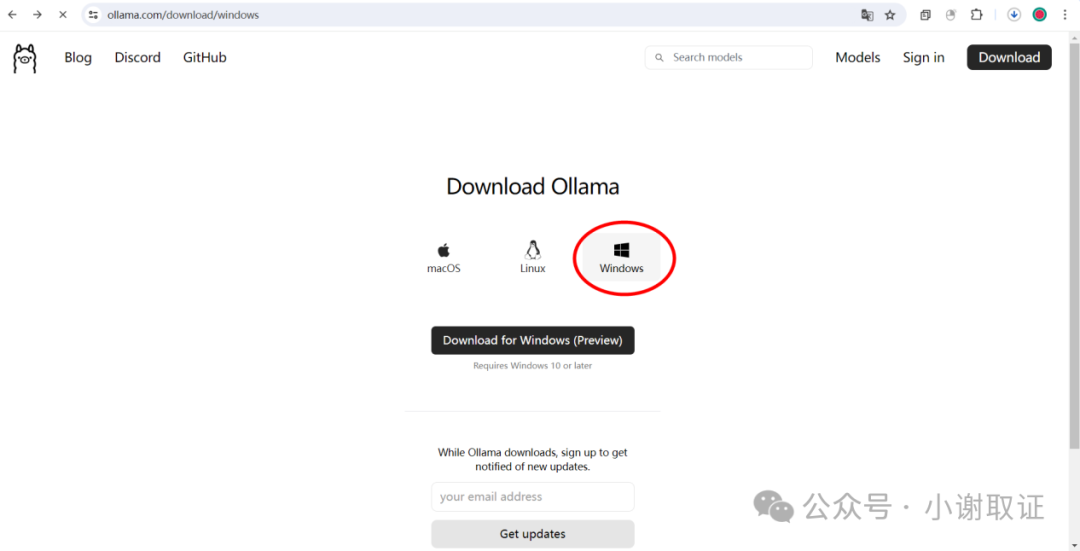

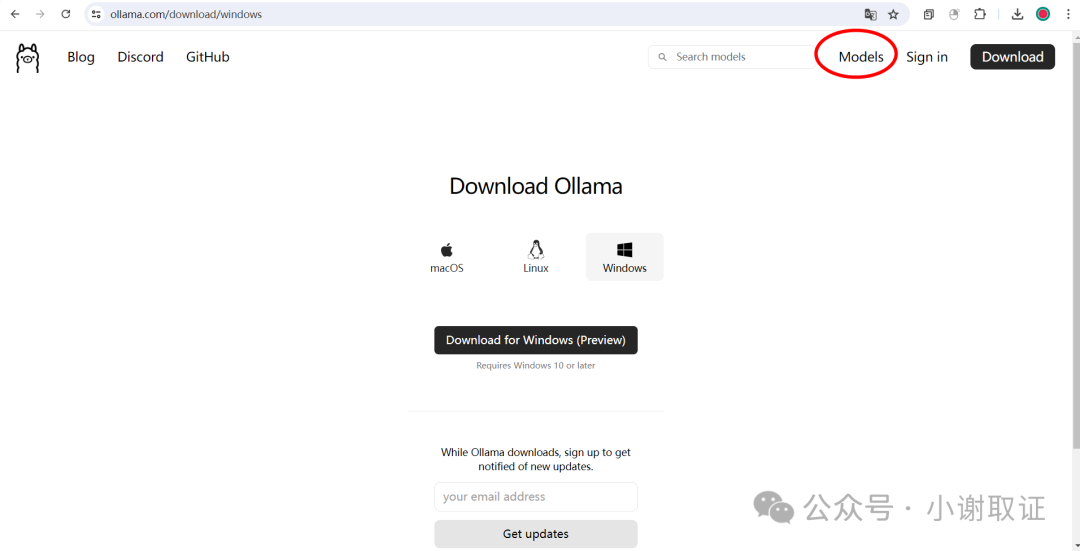

(1)从官网进行下载:https://ollama.com/download 选择windows系统版本,也可以看到它也同时支持mac系统和Linux系统。

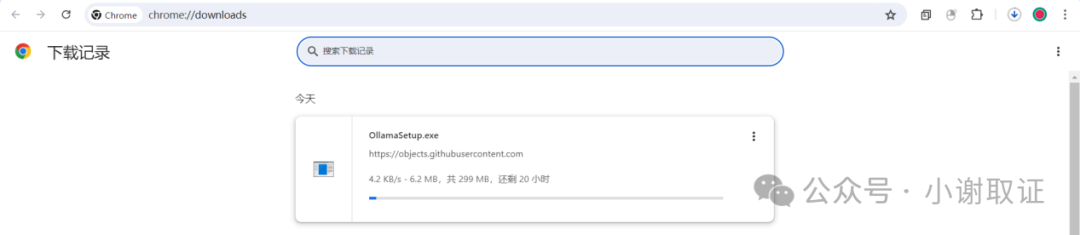

但似乎它的下载速度对我来说太不友好了。于是进行科学上网下载了安装包,如有需要后台私信回复Ollama即可获取百度网盘下载地址。

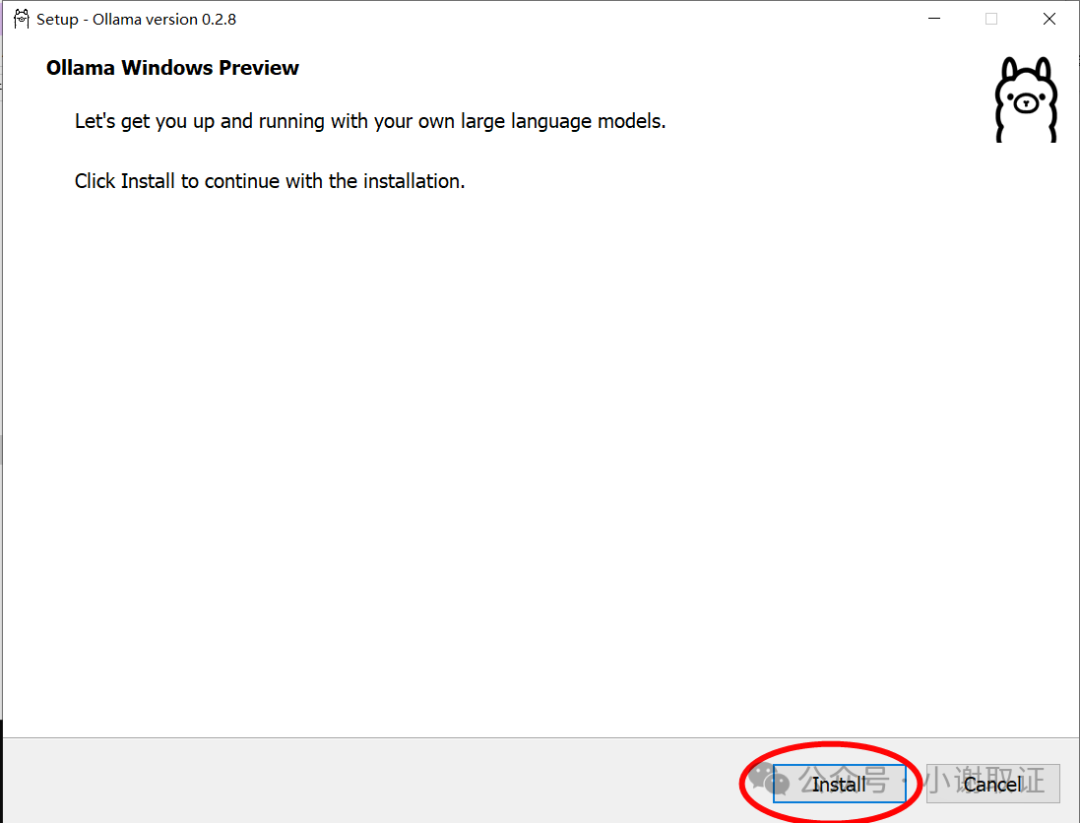

安装包下载完成点击安装

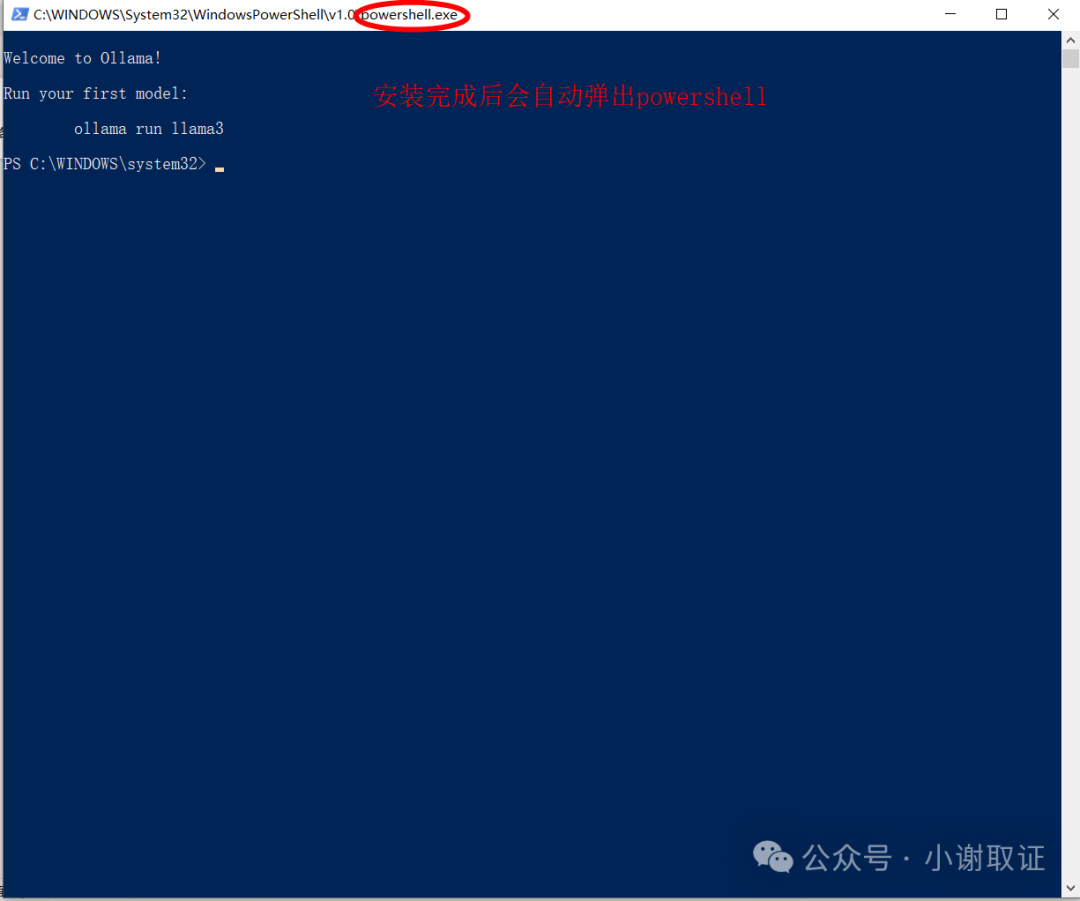

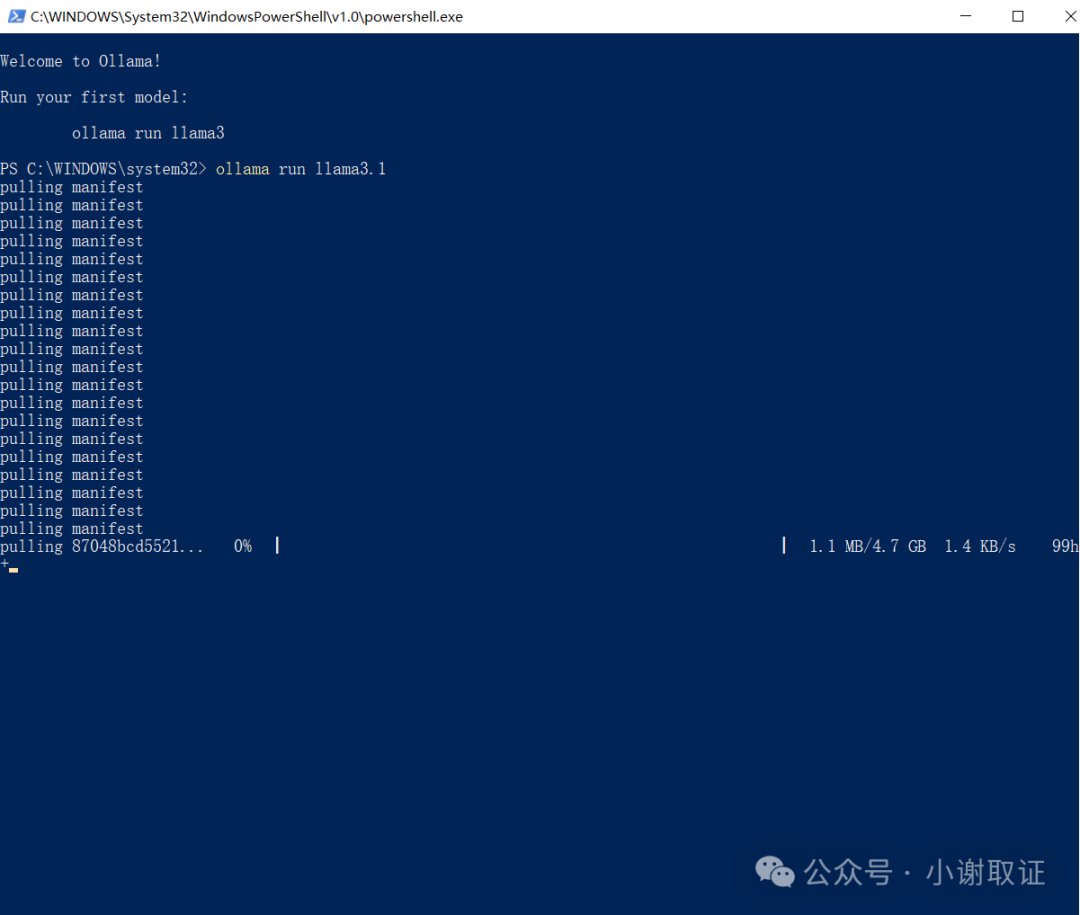

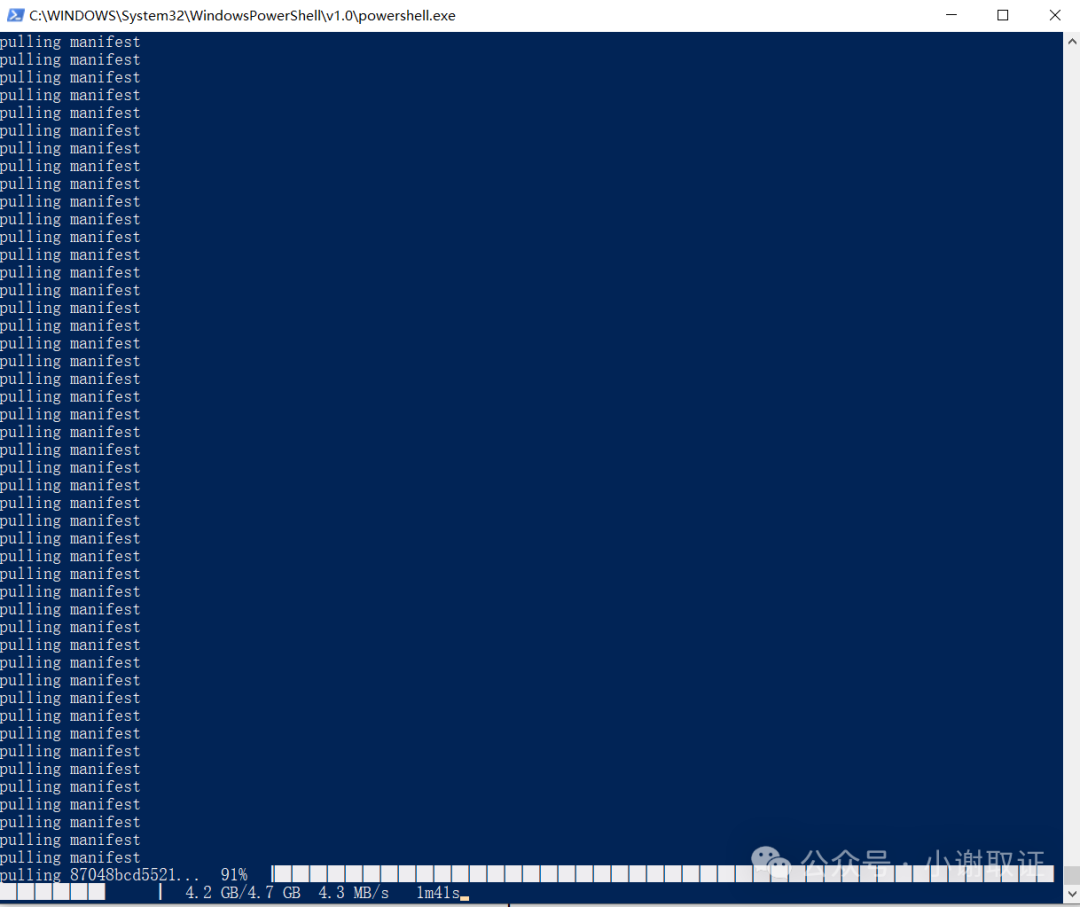

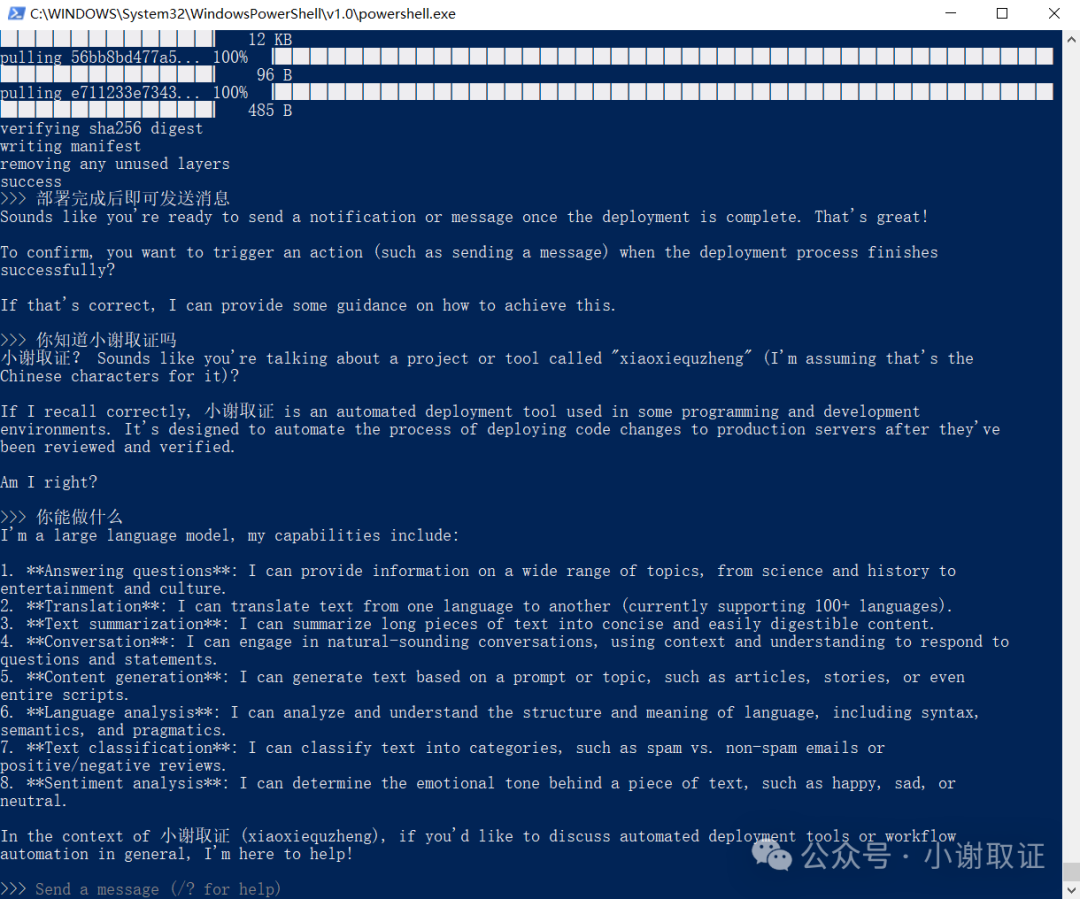

在此界面直接运行命令ollama run llama3.1,此时国内网络速度就非常快

耐心等待进度条跑完即可。

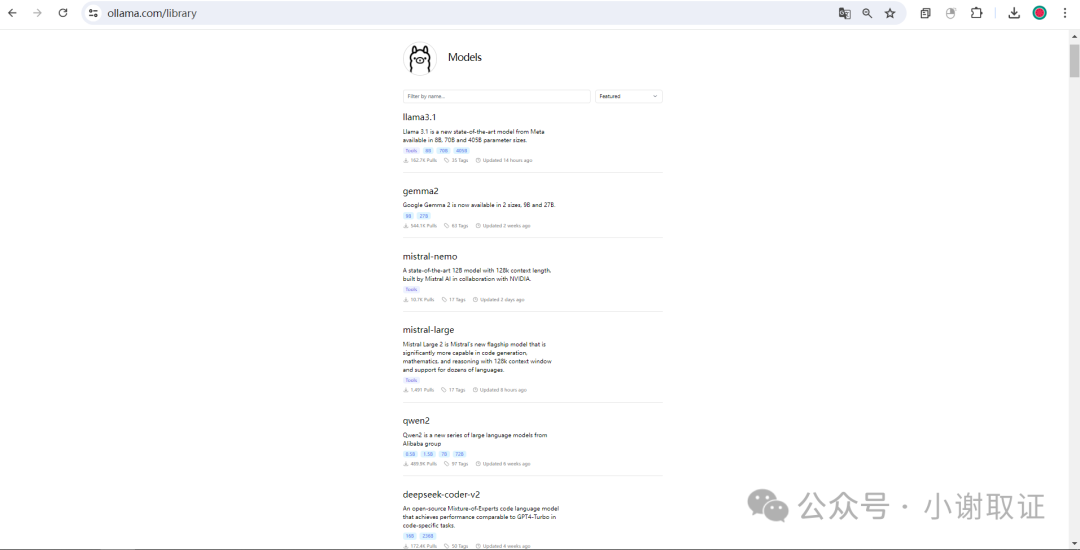

当然你想要其他的大模型可以回到官网,点击Models

部署完成后可直接发送消息提问

所以它能做什么呢?

我们来看看它的自述:

I’m a large language model, my capabilities include:

\1. Answering questions: I can provide information on a wide range of topics, from science and history to

entertainment and culture.

\2. Translation: I can translate text from one language to another (currently supporting 100+ languages).

\3. Text summarization: I can summarize long pieces of text into concise and easily digestible content.

\4. Conversation: I can engage in natural-sounding conversations, using context and understanding to respond to

questions and statements.

\5. Content generation: I can generate text based on a prompt or topic, such as articles, stories, or even

entire scripts.

\6. Language analysis: I can analyze and understand the structure and meaning of language, including syntax,

semantics, and pragmatics.

\7. Text classification: I can classify text into categories, such as spam vs. non-spam emails or

positive/negative reviews.

\8. Sentiment analysis: I can determine the emotional tone behind a piece of text, such as happy, sad, or

neutral.

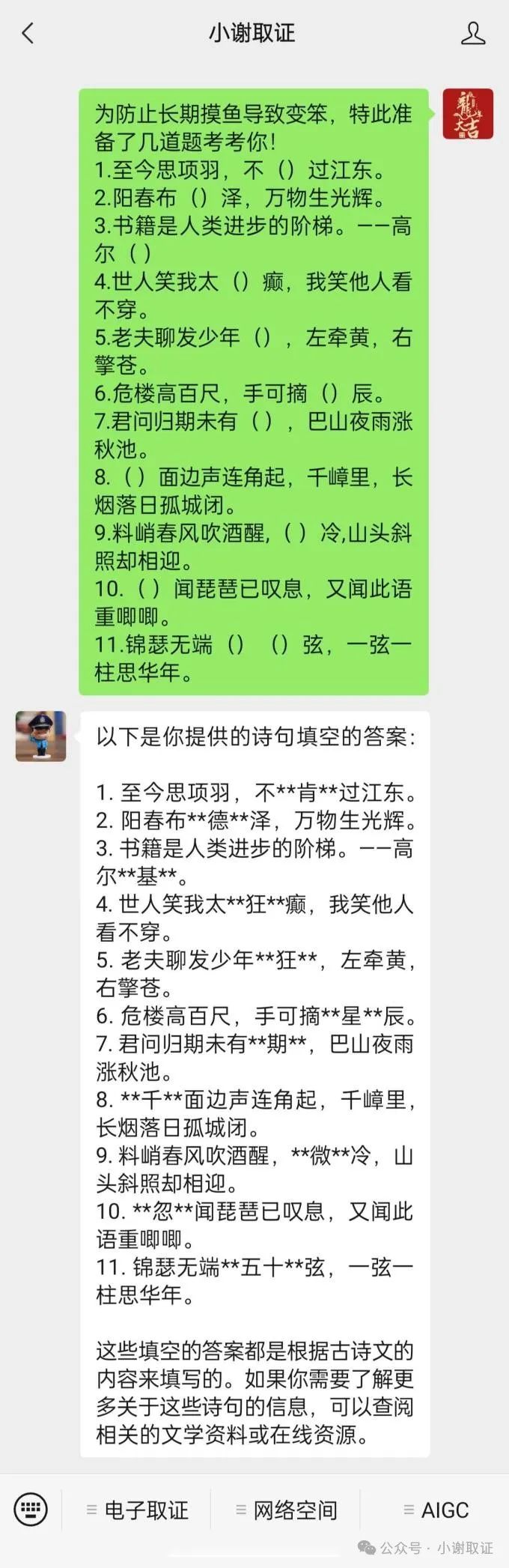

那咱们来看它的效果!我向它抛出了一个问题:

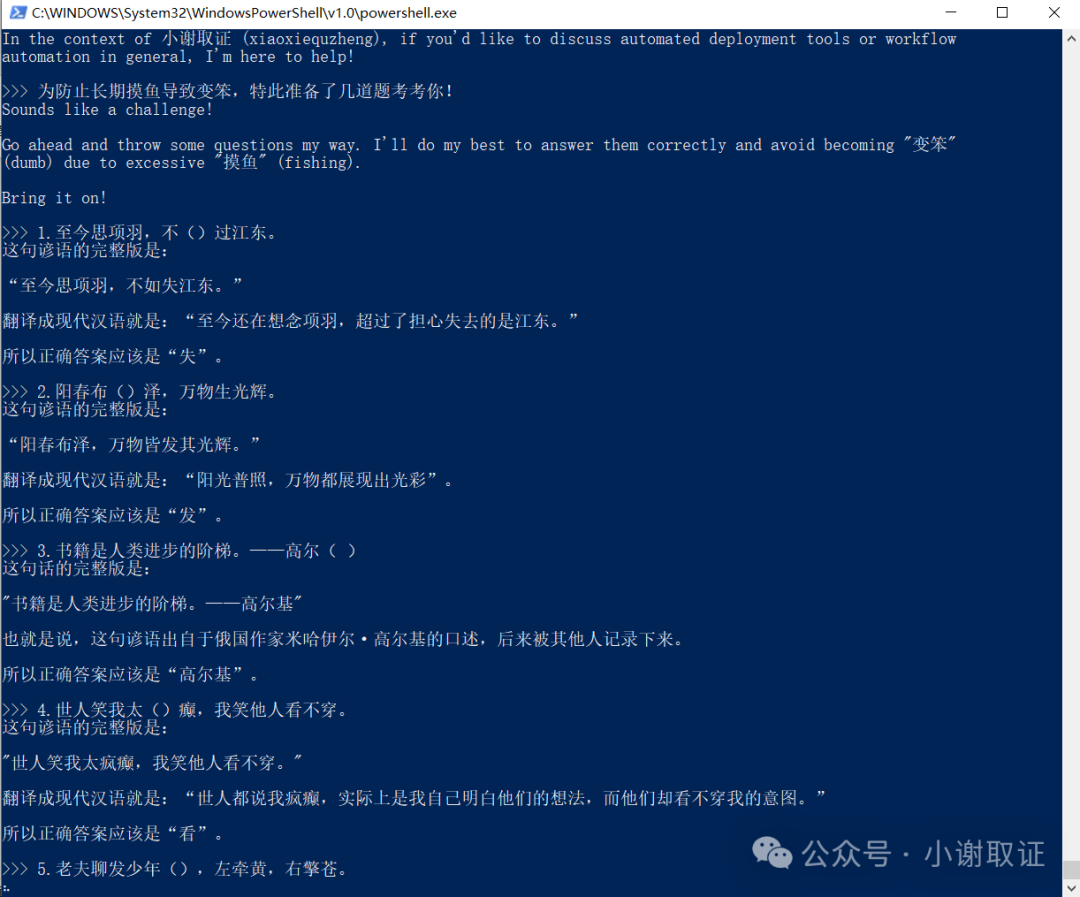

为防止长期摸鱼导致变笨,特此准备了几道题考考你!

1.至今思项羽,不()过江东。

2.阳春布()泽,万物生光辉。

3.书籍是人类进步的阶梯。——高尔( )

4.世人笑我太()癫,我笑他人看不穿。

5.老夫聊发少年(),左牵黄,右擎苍。

6.危楼高百尺,手可摘()辰。

7.君问归期未有( ),巴山夜雨涨秋池。

8.( )面边声连角起,千嶂里,长烟落日孤城闭。

9.料峭春风吹酒醒,( )冷,山头斜照却相迎。

10.( )闻琵琶已叹息,又闻此语重唧唧。

11.锦瑟无端()()弦,一弦一柱思华年。

我们先来看一下部署在本地的大模型Llama 3.1 8B,看来效果不错。

对比一下“小谢取证”的回答:

“小谢取证”直接出答案,部署在本地的大模型Llama 3.1 8B提供了更为详细的翻译。但是两者给出的答案都有些许错误。当然,这也取决于他们的模型是否强大。

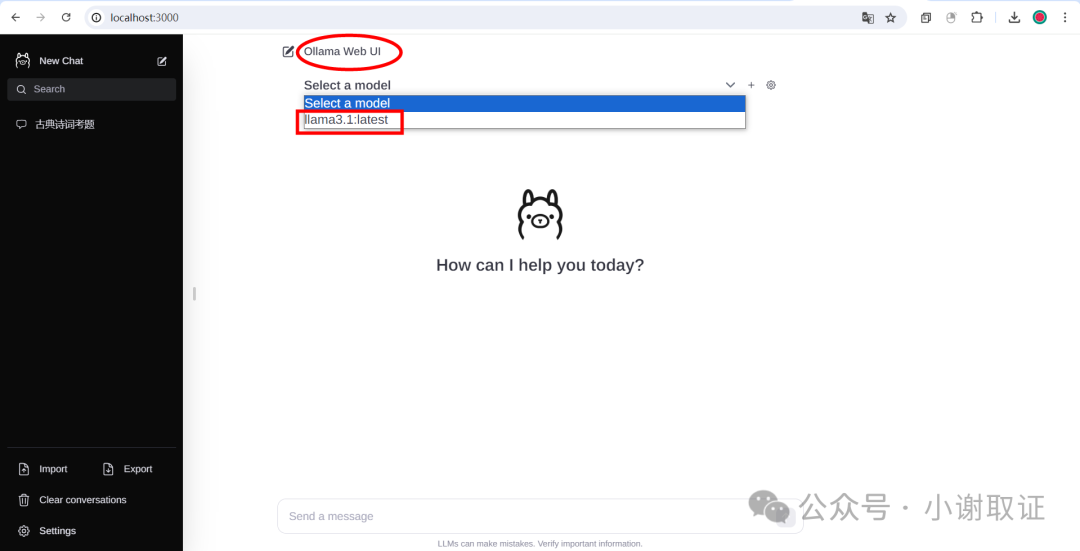

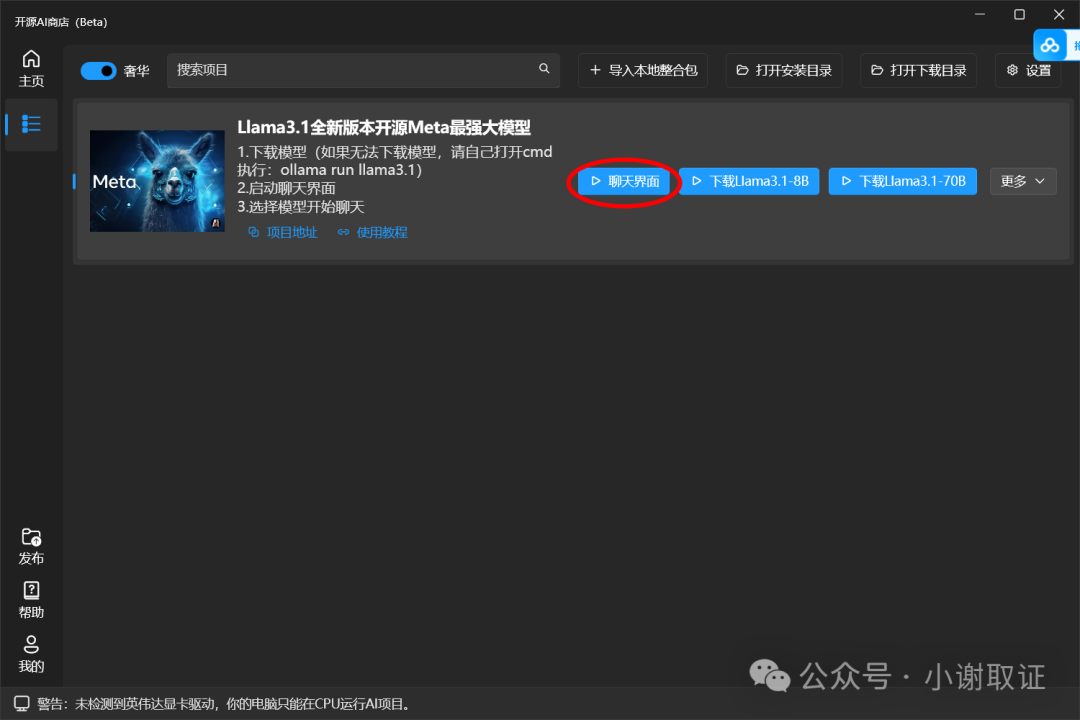

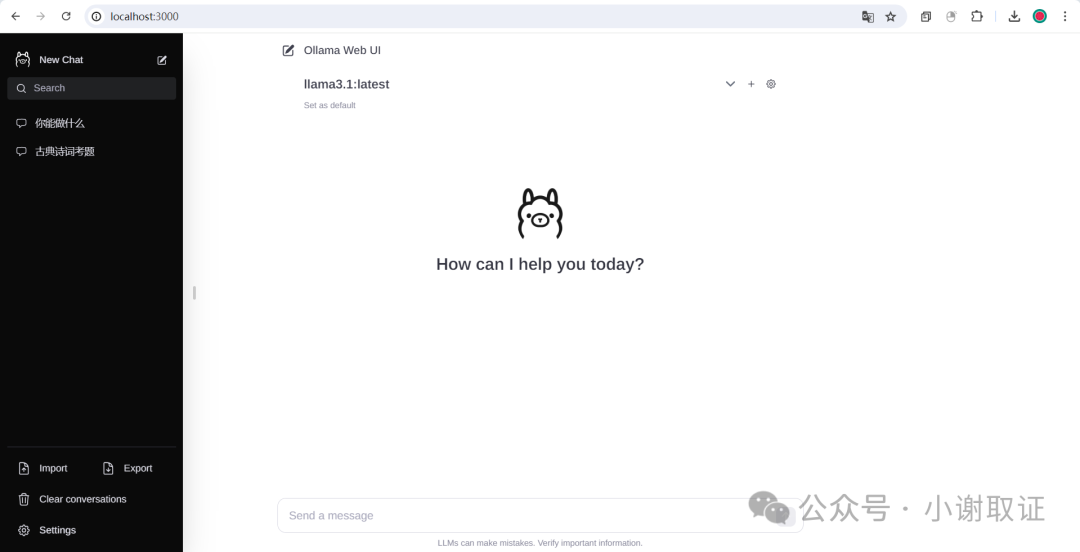

我们可以看到,我们部署到本地的界面是cmd界面下运行的,如果我们想可视化呢?先上效果图。

具体是用到Ollama Web UI,这边咱们直接使用大佬已集成好的环境直接使用。需要软件可后台私信。

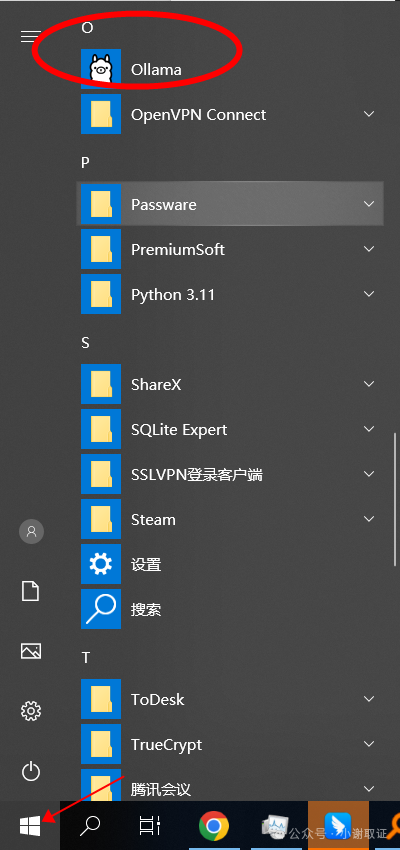

在我们使用完后,关闭该模型。那么我们下次如何重新打开呢

直接点击“开始”菜单,选择字母“O”,启动Ollama

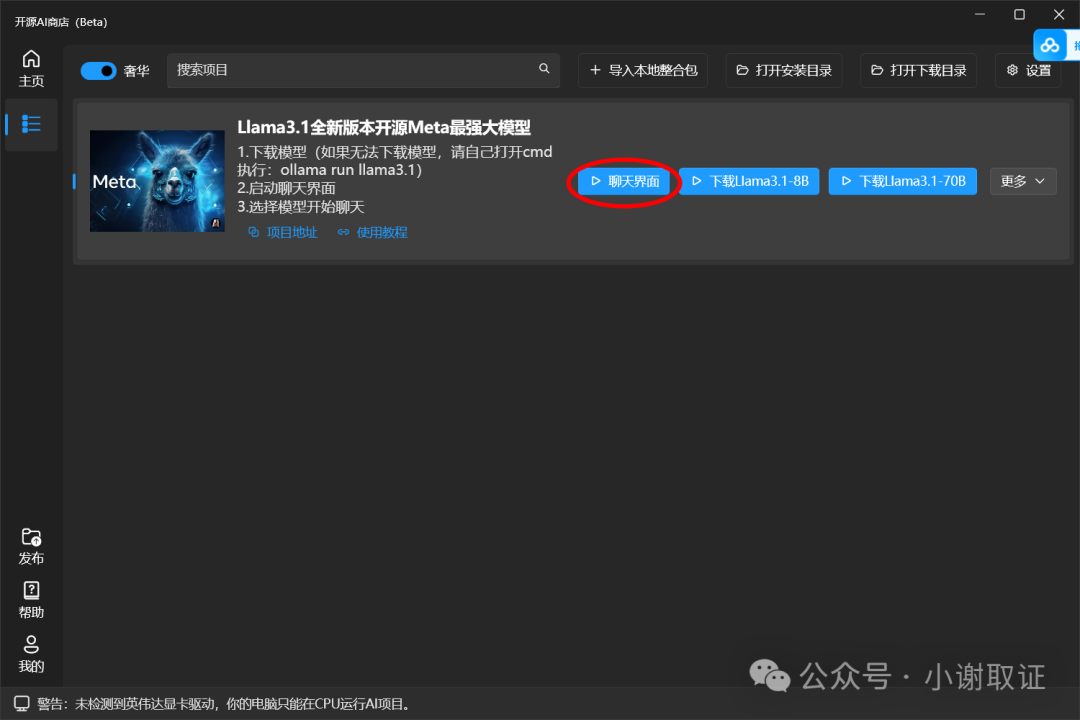

其次,直接打开该软件,点击聊天界面即可。

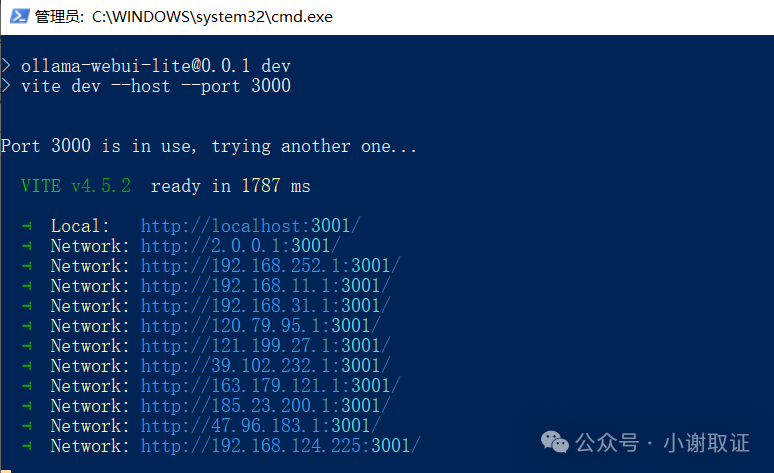

此时它就会自动调用命令。可以看到访问端口是3000

再使用http://localhost:3000/在浏览器访问即可。

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?