一、代码实现

import torch

from torch import nn

from d2l import torch as d2l

net = nn.Sequential(

nn.Conv2d(1, 96, kernel_size=11, stride=4, padding=1), nn.ReLU(),

nn.MaxPool2d(kernel_size=3, stride=2),

nn.Conv2d(96, 256, kernel_size=5, padding=2), nn.ReLU(),

nn.MaxPool2d(kernel_size=3, stride=2),

nn.Conv2d(256, 384, kernel_size=3, padding=1), nn.ReLU(),

nn.Conv2d(384, 384, kernel_size=3, padding=1), nn.ReLU(),

nn.Conv2d(384, 256, kernel_size=3, padding=1), nn.ReLU(),

nn.MaxPool2d(kernel_size=3, stride=2), nn.Flatten(),

nn.Linear(6400, 4096), nn.ReLU(), nn.Dropout(p=0.5),

nn.Linear(4096, 4096), nn.ReLU(), nn.Dropout(p=0.5),

nn.Linear(4096, 10))

X = torch.randn(1, 1, 224, 224)

for layer in net:

X = layer(X)

print(layer.__class__.__name__, 'Output shape:\t', X.shape)

batch_size = 128

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size, resize=224)

lr, num_epochs = 0.01, 10

d2l.train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())

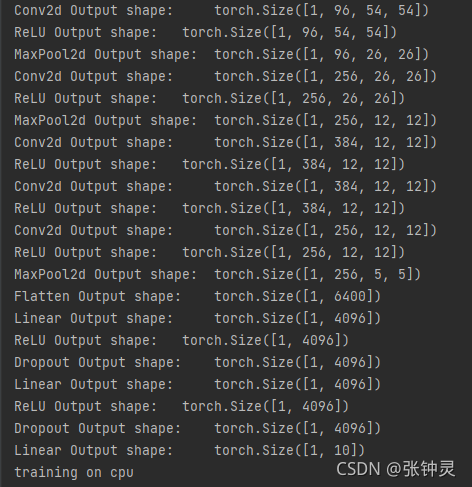

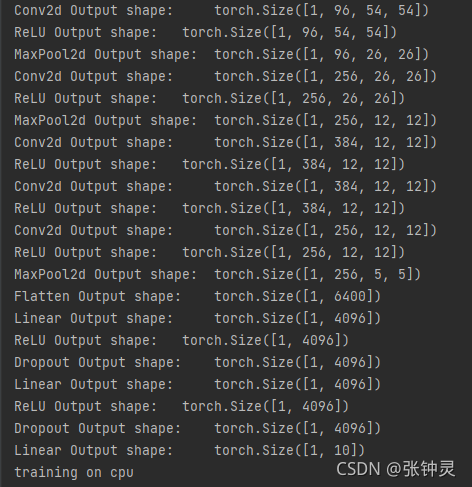

二、输出样式展示

该博客介绍了如何使用PyTorch实现AlexNet神经网络模型,并在Fashion-MNIST数据集上进行训练。代码展示了从卷积层到全连接层的网络结构,包括ReLU激活函数、最大池化层、Dropout正则化等组件。最后,通过加载数据、设置超参数并训练模型来完成任务。

该博客介绍了如何使用PyTorch实现AlexNet神经网络模型,并在Fashion-MNIST数据集上进行训练。代码展示了从卷积层到全连接层的网络结构,包括ReLU激活函数、最大池化层、Dropout正则化等组件。最后,通过加载数据、设置超参数并训练模型来完成任务。

1824

1824

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?