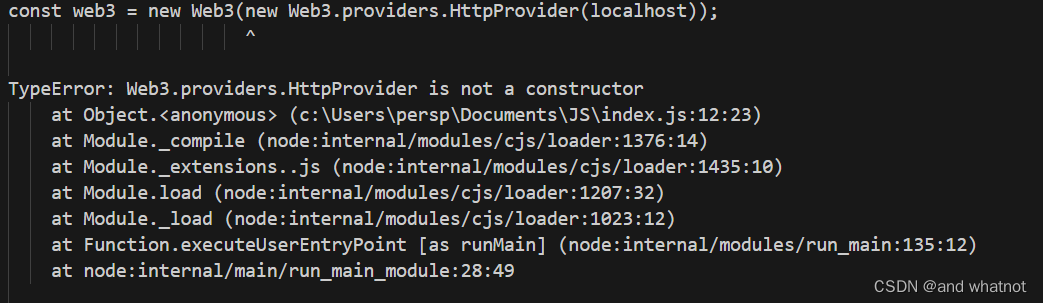

这个是网上给出的代码,但是一直报错

var localhost = "http://127.0.0.1:7545"

var Web3 = require("web3")

var web3 = new Web3(new Web3.providers.HttpProvider(localhost))

web3.eth.getAccounts(function (error, result) {

console.log("账户列表地址:");

console.log(result);

});

Web3.providers.HttpProvider is not a constructor

自己也花了很多时间,其实就是版本的原因!我的web版本是4.3.0。只需要修改一步就可以了。

将

var Web3 = require("web3")

改为

const {Web3} = require("web3");

完整代码如下图所示

const localhost = "http://127.0.0.1:8545";

const {Web3} = require("web3");

const web3 = new Web3(new Web3.providers.HttpProvider(localhost));

web3.eth.getAccounts().then(function (result) {

console.log("账户列表地址:");

console.log(result);

}).catch(function (error) {

console.error(error);

});

结果如图

博客讲述网上代码报错‘Web3.providers.HttpProvider is not a constructor’,经排查是Web3版本为4.3.0所致,只需修改一步即可解决问题,还给出了完整代码及结果图。

博客讲述网上代码报错‘Web3.providers.HttpProvider is not a constructor’,经排查是Web3版本为4.3.0所致,只需修改一步即可解决问题,还给出了完整代码及结果图。

1332

1332