一.集成学习

集成学习的一类方法是boosting,工作机制是首先从训练集用初始权重训练出一个弱学习器1,根据弱学习的学习误差率表现来更新训练样本的权重,使得之前弱学习器1学习误差率高的训练样本点的权重变高,使得这些误差率高的点在后面的弱学习器2中得到更多的重视。然后基于调整权重后的训练集来训练弱学习器2.,如此重复进行,直到弱学习器数达到事先指定的数目T,最终将这T个弱学习器通过集合策略进行整合,得到最终的强学习器。

第二个问题是弱分类器的组合,具体是加大分类错误率小的弱分类器的权值,减小分类错误率大的弱分类器的权值,

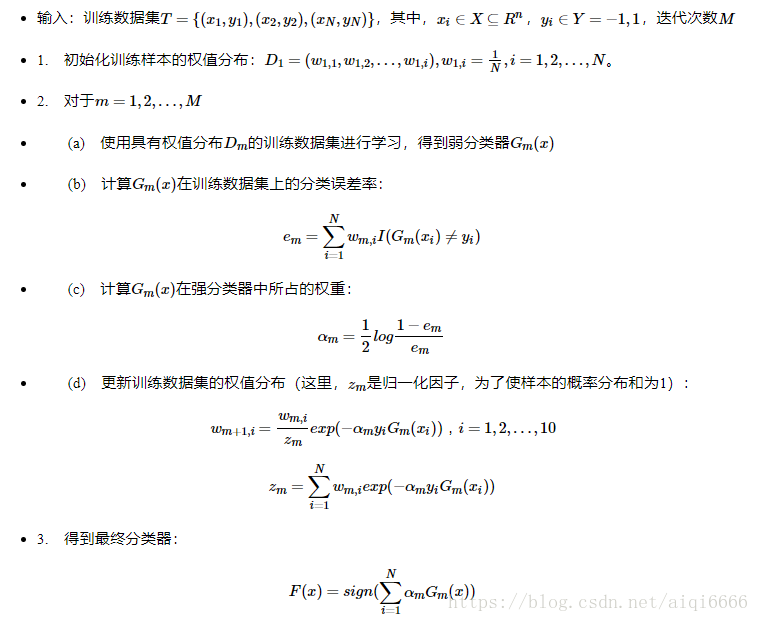

二.Adaboost的过程

有点小错误:最后一个公式的上限应该是M

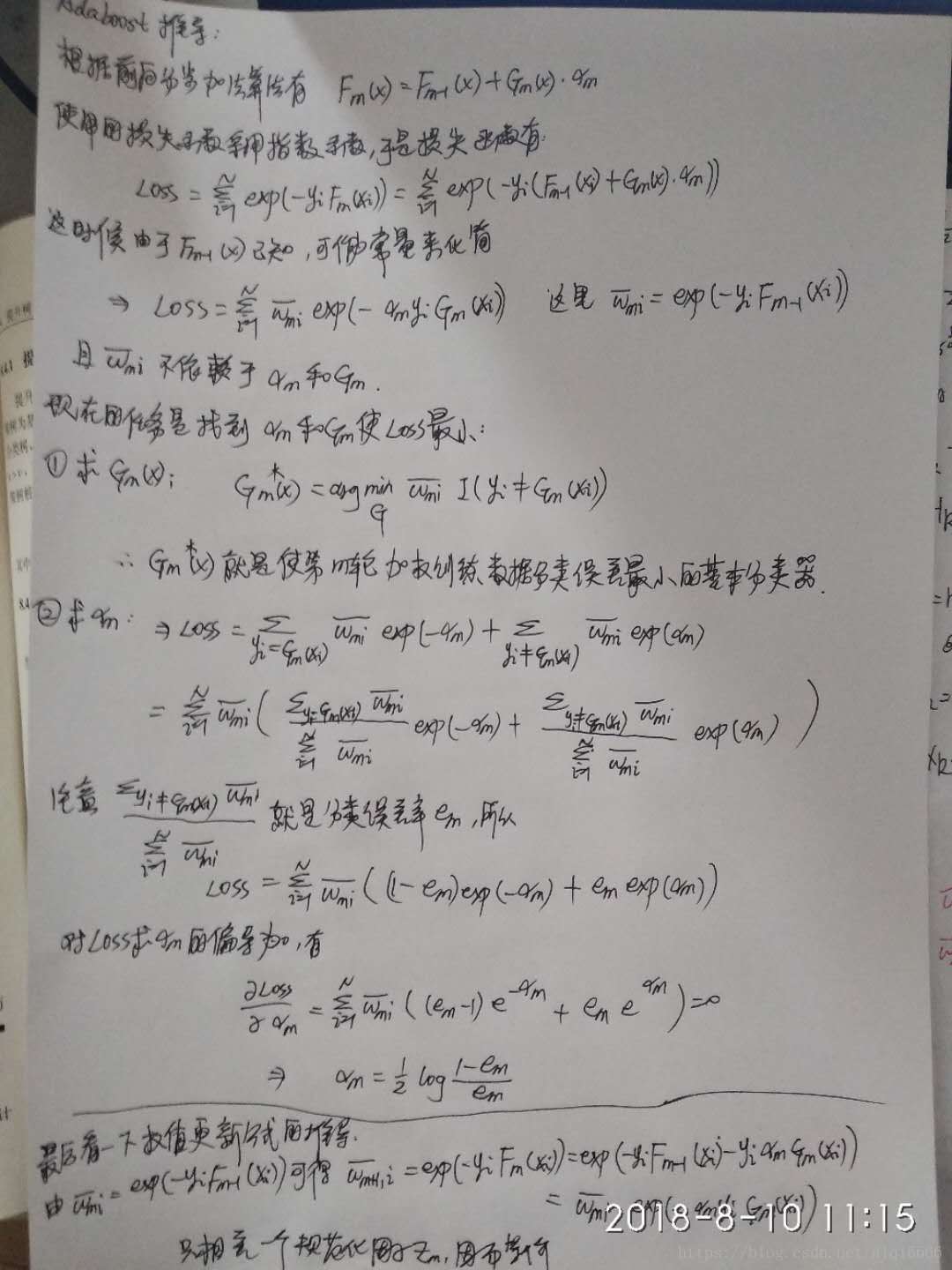

三.Adaboost的推导

最后插播一条新闻:

本文详细介绍了集成学习的基本概念及其代表性算法Adaboost的工作原理。解释了如何通过组合多个弱分类器来构建强大的分类器,并具体展示了Adaboost算法的实现过程。

本文详细介绍了集成学习的基本概念及其代表性算法Adaboost的工作原理。解释了如何通过组合多个弱分类器来构建强大的分类器,并具体展示了Adaboost算法的实现过程。

1164

1164

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?