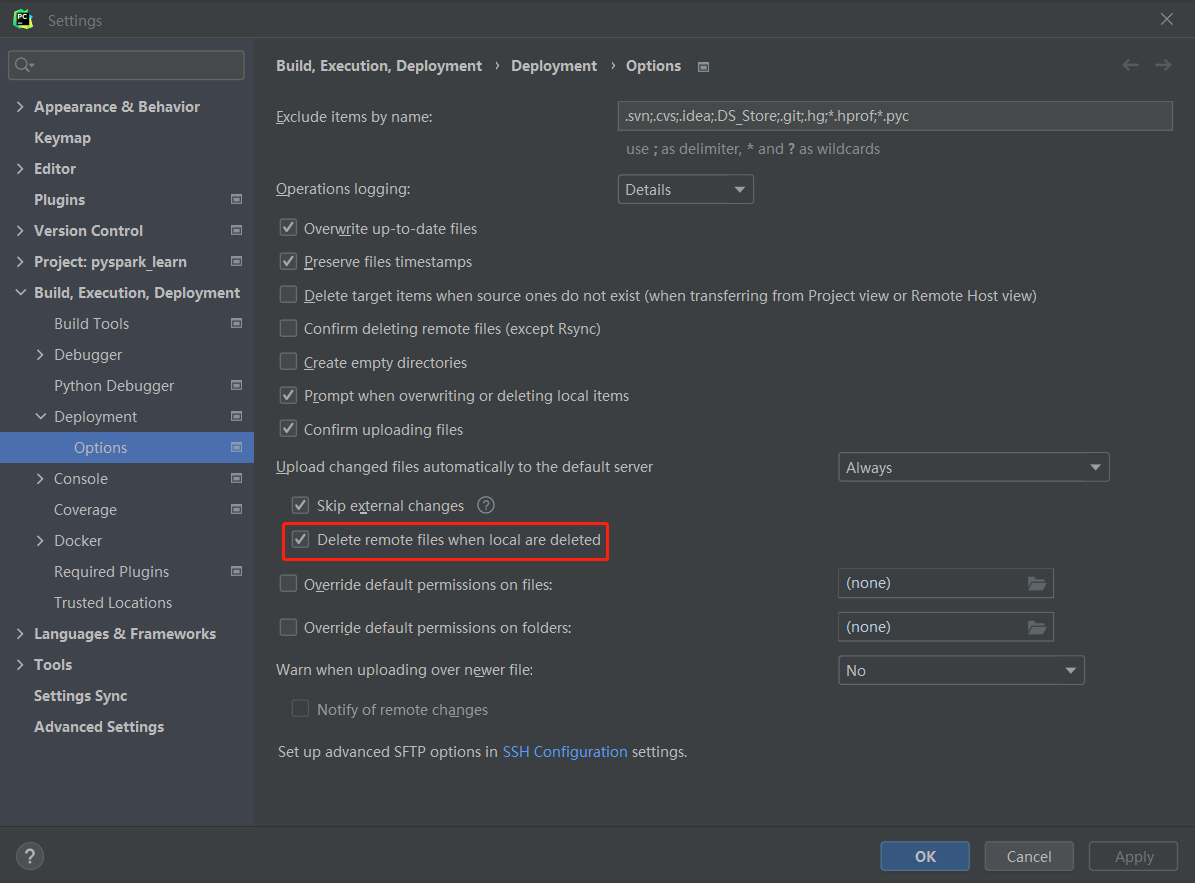

一、本地删除文件后,远程服务器不删除

二、PySpark环境添加数据库连接驱动

1. spark环境

/home/xxx/kdh/spark/jars

2. pyspark环境

cd /software/anaconda3/envs/pyspark_env/lib/python3.8/site-packages/pyspark/jars

3. yarn使用

hdfs:///tmp/zzdb/hadoop27/spark/jars/

可从/home/xxx/kdh/spark/conf/spark-defaults.conf查看spark.yarn.jars

文章讲述了在PySpark环境中如何添加数据库连接驱动,涉及的路径包括/home/xxx/kdh/spark/jars和pyspark_env的lib目录。同时,讨论了本地删除文件后远程服务器文件不受影响的情况以及在yarn模式下如何指定jar包位置,提示可通过查阅spark-defaults.conf获取更多配置信息。

文章讲述了在PySpark环境中如何添加数据库连接驱动,涉及的路径包括/home/xxx/kdh/spark/jars和pyspark_env的lib目录。同时,讨论了本地删除文件后远程服务器文件不受影响的情况以及在yarn模式下如何指定jar包位置,提示可通过查阅spark-defaults.conf获取更多配置信息。

1232

1232

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?