首先感谢https://zhuanlan.zhihu.com/p/52806730

搞了一下午终于在win10下的vs2015实现了简单的libtorch功能,接下来看看模型怎么部署。

说一下我实现的过程。

说一下我电脑的所有环境,win10 (64位)cud9.0 cudnn7.1

按上面配置去官网下载torch1.0和libtorch

torch不说

说一下libtorch的怎么在VS2015上配置实现

第一步复制这个哥们的python和cpp文件

https://zhuanlan.zhihu.com/p/52806730

感谢这个哥们 以下为他的py文件用于生成model.pt

import torch

import torchvision

# An instance of your model.

model = torchvision.models.resnet18()

# An example input you would normally provide to your model's forward() method.

example = torch.rand(1, 3, 224, 224)

# Use torch.jit.trace to generate a torch.jit.ScriptModule via tracing.

traced_script_module = torch.jit.trace(model, example)

traced_script_module.save("model.pt")

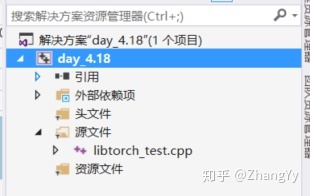

生成model.pt后在vs2015种新建C++控制台cpp 名字随意

然后把上面那个哥们代码复制过来

#include <torch/script.h> // One-stop header.

#include <iostream>

#include <memory>

int main() {

// Deserialize the ScriptModule from a file using torch::jit::load().

std::shared_ptr<torch::jit::script::Module> module = torch::jit::load("D:/Desktop/pytorch1_0/model.pt");

assert(module != nullptr);

std::cout << "ok\n";

// Create a vector of inputs.

std::vector<torch::jit::IValue> inputs;

inputs.push_back(torch::ones({ 1, 3, 224, 224 }));

// Execute the model and turn its output into a tensor.

at::Tensor output = module->forward(inputs).toTensor();

std::cout << output.slice(/*dim=*/1, /*start=*/0, /*end=*/5) << '\n';

while (1);

}

复制好后 把平台改成X64 release

编译 运行就可以看到结果了

本文详细介绍了如何在Windows 10和Visual Studio 2015环境下配置并使用PyTorch的C++前端LibTorch。作者分享了其在Cuda 9.0和Cudnn 7.1配置下,从下载LibTorch到在VS2015中实现模型加载和预测的全过程。

本文详细介绍了如何在Windows 10和Visual Studio 2015环境下配置并使用PyTorch的C++前端LibTorch。作者分享了其在Cuda 9.0和Cudnn 7.1配置下,从下载LibTorch到在VS2015中实现模型加载和预测的全过程。

3067

3067

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?