Spak2.3.4版本已经安装完成,介绍在集群中运行作业的方式。

- 首先是运行Spark自带的样例程序(进入到spark安装目录):

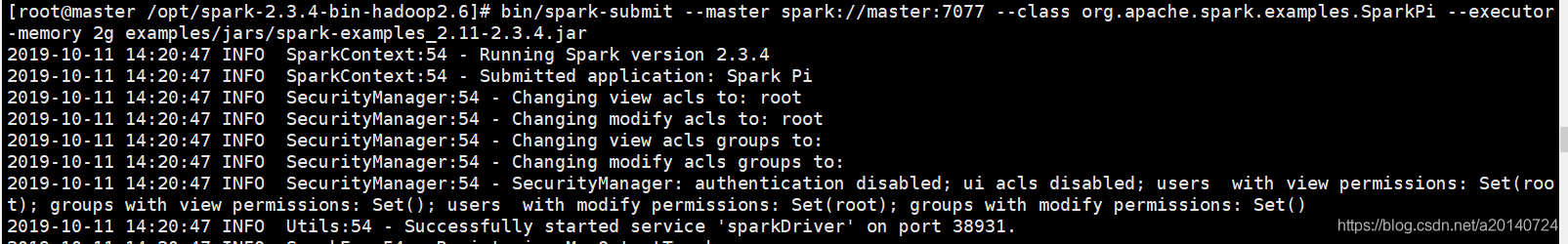

bin/spark-submit --master spark://master:7077 --class org.apache.spark.examples.SparkPi --executor-memory 2g examples/jars/spark-examples_2.11-2.3.4.jar下图是运行情况

其中--master表示运行模式,上图中采用的是standalone模式,//master指的是在conf目录下spark-env.xml中配置的export SPARK_MASTER_IP的地址。(我在我的机器中配置的是master,因为已经在/etc/hosts文件中配置了hosts列表),也可以使用192.168.101.71,就是master节点的IP。

另外还有local模式、yarn-cluster模式、yarn-client模式。

本文详细介绍如何在Spark 2.3.4版本中使用standalone模式运行集群作业,包括配置master节点和执行样例程序SparkPi的具体步骤。

本文详细介绍如何在Spark 2.3.4版本中使用standalone模式运行集群作业,包括配置master节点和执行样例程序SparkPi的具体步骤。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?