前言

嗨大家好!今天我要和大家分享一个超实用的教程——在本地服务器上无需高昂价格的GPU也能运行离线AI项目的开源神器:LocalAI,并结合cpolar内网穿透工具实现轻松远程使用的详细步骤。

随着AI大模型的发展,各大厂商纷纷推出了自己的线上AI服务。从写文章到生成图片或视频,这些服务确实给我们的生活和工作带来了便利。然而,使用这些在线AI软件时,数据需要传输到商家的服务器上,这让不少用户产生了担忧:我的数据会泄露吗?隐私保护情况如何?

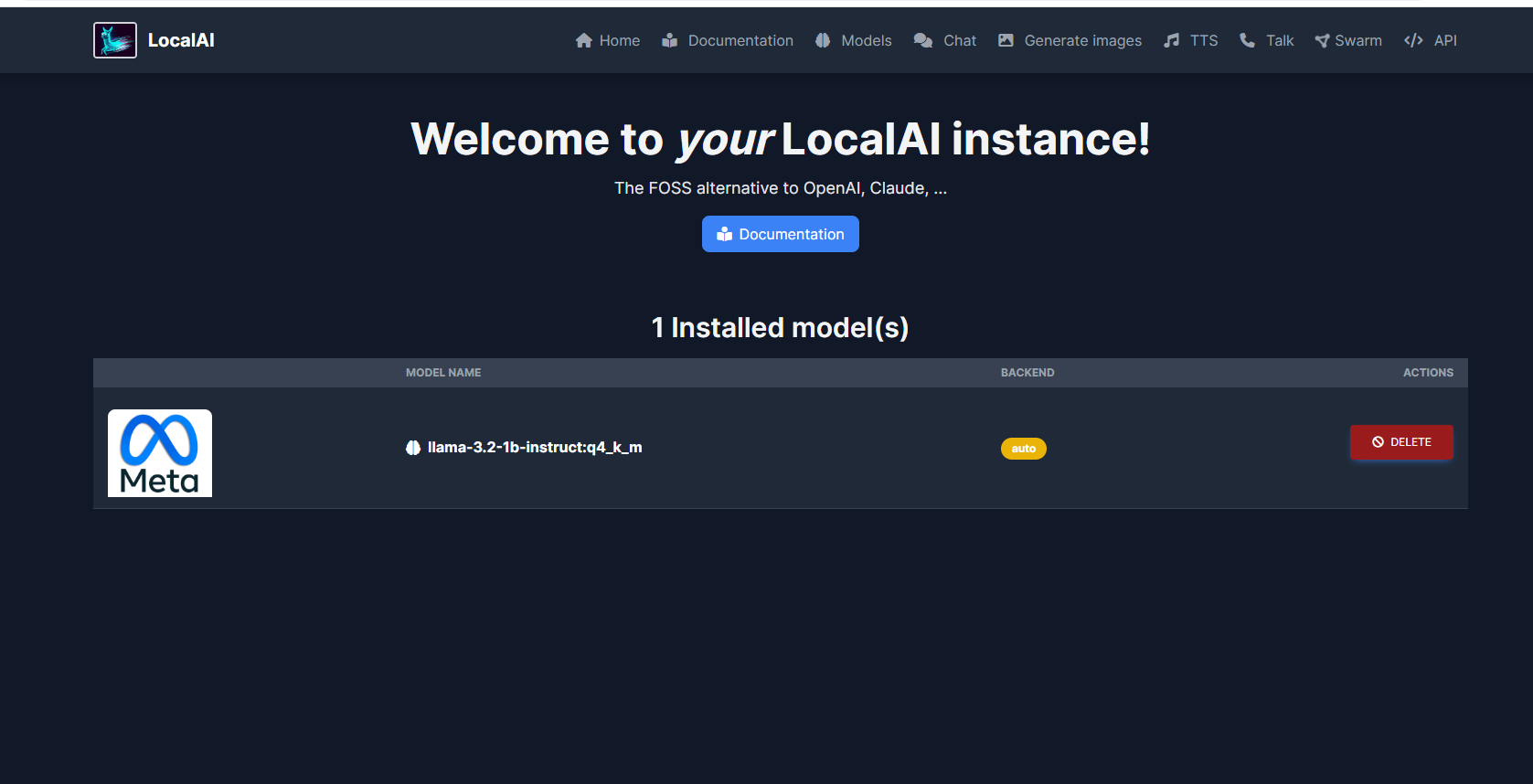

为了应对这些问题,今天给大家推荐一款很不错的AI项目:LocalAI!这款开源工具可以在本地直接运行大语言模型(LLM)、生成图像和音频等。最棒的是,你不需要高端昂贵的GPU,消费级硬件通过CPU就能轻松完成推理任务,真正降低了AI使用的门槛。

在本文中,我将详细介绍如何使用Docker快速部署LocalAI,并结合cpolar内网穿透工具实现远程访问。无论你是技术新手还是有经验的老手,都能从中学到实用的知识和技巧!

【视频教程】

支持CPU推理运行的开源AI神器LocalAI本地安装与远程使用教程

1. Docker部署

本例使用Ubuntu 22.04进行演示,使用Docker进行部署,如果没有安装Docker,可以查看这篇教程进行安装:《Docker安装教程——Linux、Windows、MacOS》

安装好Docker后,打开终端执行这行命令启动容器即可:

sudo docker run -ti --name local-ai -p

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?