大数据产业创新服务媒体

——聚焦数据 · 改变商业

2024年逐渐远去,新的一年悄然而至,回顾这一年,科技界和风险投资圈的目光无疑聚焦在了人工智能。层出不穷的新产品,巨额的融资,独角兽创始人不断刷新人们的观念,如同走马灯般,你方唱罢我登场,而看客每天都在期待下一个大新闻。

诚然,2024年可以说是生成式人工智能大模型领域承前启后之年,虽然未再现GPT-3和ChatGPT横空出世的震撼,但在延续前几年技术积淀的基础上,开启了广泛应用的时代。从AI技术首次涉足诺贝尔奖评选,到Cursor作为AI辅助编程的标杆工具彻底改变开发者的工作方式,再到Perplexity、Talkie等现象级AI应用打入大众市场,以及Sora在多模态生成领域进一步接近自然和人类规律,生成式AI展示了从技术探索迈向实际应用的巨大势能。

与此同时,算力仍然是推动技术进步的关键瓶颈,高昂的研发成本也随之攀升。此外,技术幻觉问题以及隐私与伦理方面的挑战依旧悬而未决。尽管大模型在技术上不断取得进展,吊足了胃口的人类,已不再满足于GPT o1的能力,而是期待通用人工智能(AGI)的世界马上到来。与这一宏大愿景形成对比的是,生成式AI的焦点正在逐步转向小模型的高效化以及低能耗解决方案,以便更加深入广泛的行业应用。另外,日益强化的行业监管和愈加激烈的市场竞争,也为这一领域的发展增添了更多变数与挑战。

接下来,让我们回到2024年,共同回顾生成式AI在这一年中波澜起伏的发展历程。

技术持续突破永不停歇

在这一年中,生成式AI技术的前行步伐虽不如前几年那般势如破竹,但从深度到广度的突破依然令人瞩目。

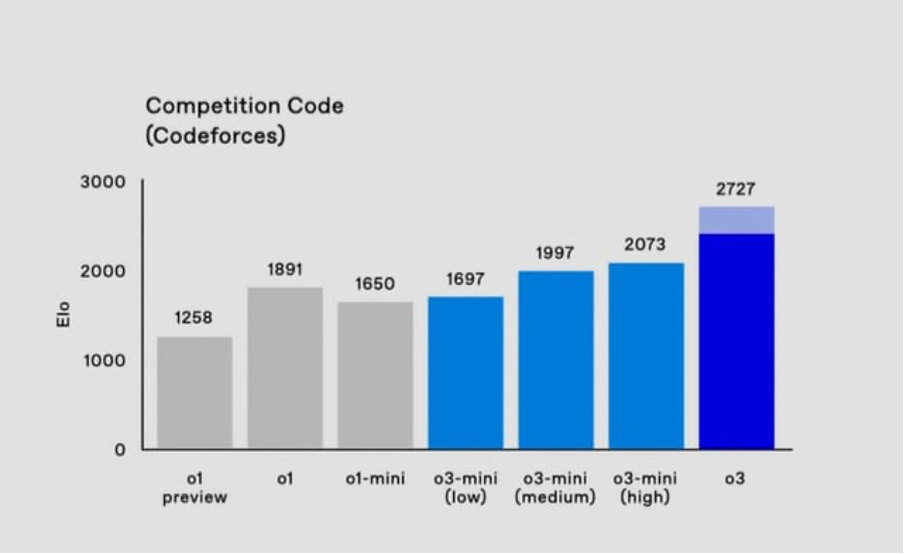

接近年底时刻,2024年12月5日 - 21日,人工智能的头号玩家OpenAI马不停蹄地做了为期12天的直播。最后1天,OpenAI重磅发布新一代推理模型系列o3,其在极其困难的数学和逻辑问题能力基准测试ARC-AGI中,最佳状态下取得了87.5%的分数,达到85%的分数即被认为是“人类水平”,而在Codeforces竞赛编程上的评分达到2727,也超越了大部分人类程序员。

2024年从o1preview到o3在Codeforces的评分进化,来源:ibb.co

去年,OpenAI还有两个里程碑式的大模型发布。一是最早于9月发布的o1模型,代号“草莓”,尽管它的性能要低于后来发布的o3模型,但其里程碑意义不容忽视。o1模型首次实现了在回答用户提问时,形成类似人类思维方式的内部思维链CoT(Chain of Thought),这一突破显著提升了模型在处理复杂和专业性问题时的表现,尤其是在研究、策略制定、编码、数学和科学等领域的高难度任务中,回答的准确性和逻辑性得到了明显改善。“思维链”这一概念也迅速走红,成为2024年大模型领域最常被提及的技术关键词之一。

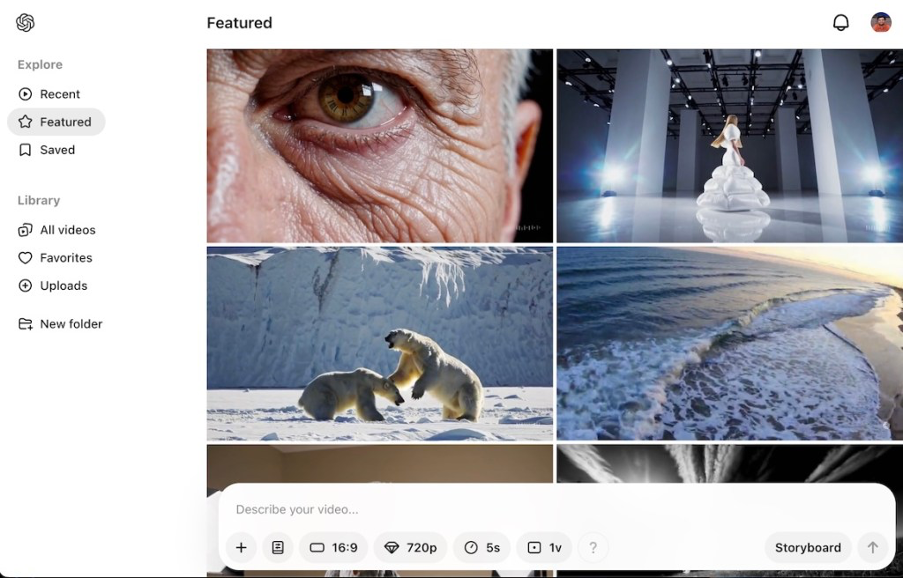

二是早在2月份就预先发布的Sora,十个月后正式发布。它支持多种输入方式,如文本、语音、图片或视频,据OpenAI介绍,Sora支持用户生成最高1080p、最长20秒、多种尺寸比例的视频,同时Sora能够理解和模拟物理世界的运动规律,使得模型的生成效果更加逼真。此外,Sora还配备了故事板、混剪等编辑功能,相当于给视频加分镜、剪辑、特效,更能满足创作者自我表达创意的需求。

OpenAI Sora,来源:OpenAI、beebom.com

随着年初Sora的推出,多家科技公司争相发布新的多模态大模型,整个2024年让我们见证了多模态大语言模型(MLLMs)的快速崛起。

2024年的多模态模型能够更加自然地融合文本、图像、音频、视频等多种模态的数据,生成高度准确的视觉内容。人们还把多模态延展到三维空间世界,李飞飞创办的World Labs用一张图、一句话就能生成3D世界的AI系统,堪称“虚拟世界生成器”,该技术将降低3D内容制作的成本、激发更多的沉浸式体验。

在运算效率方面,2024年的新一代多模态模型通过引入稀疏激活机制、模型压缩和分布式算力架构,大幅提升了处理速度和响应效率,与以往需要离线计算或长时间生成的模型相比,性能更为出色。此外,这些模型突破了早期多模态技术对单一任务的限制,具备更强的上下文理解能力和任务适配性,能够胜任更复杂的任务,例如根据一张照片生成完整的故事情节,或通过语音输入实现图像增强和视频制作。这些进步让多模态模型在影视及广告行业的应用更为广泛,使其大幅提升内容创作效率、显著降低制作成本成为可能。

2024年,当AI各类大模型的不断升级,巨量算力需求持续攀升。为了满足日益复杂的任务需求,进一步增强算力成为推动大模型技术进步的核心动力。

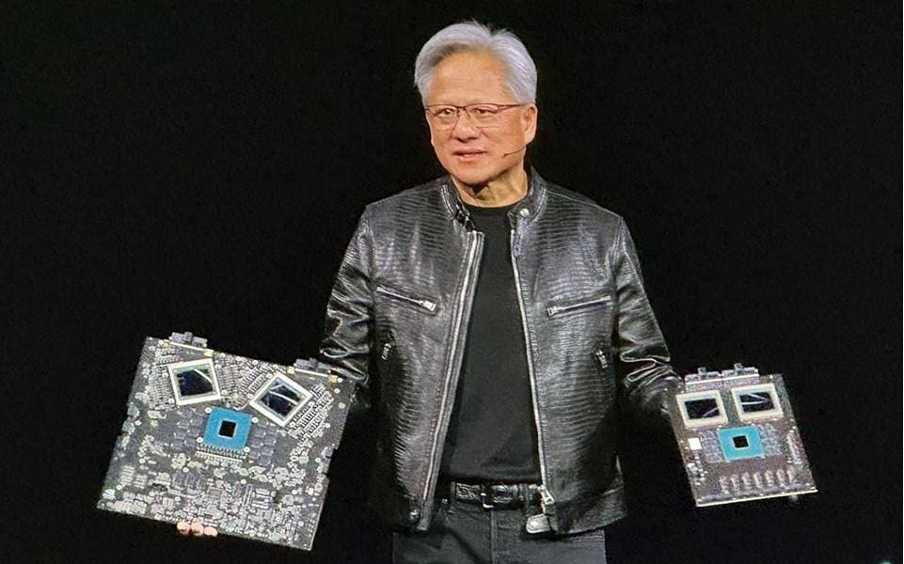

提及算力必须要提到英伟达,去年其H100 GPU凭借卓越的并行计算能力和显著优化的AI训练与推理速度,成为生成式AI的核心处理器。去年3月,英伟达发布了新一代GPU架构——Blackwell,该架构在训练与推理方面展现出卓越性能,进一步巩固了其行业领导地位。同时,谷歌的TPU和亚马逊的Inferentia等专为AI任务设计的定制芯片也在2024年加速普及,这些AI芯片亦推动了算力效率的持续提升,为人工智能的深度应用提供了强大支持。

英

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?